Давайте поговорим о BrickSeek Scraper.

Вы могли наткнуться на эту жемчужину, если когда-либо искали выгодные предложения в Интернете. BrickSeek - это как ваш личный детектив, который ищет в Интернете лучшие цены на товары в различных магазинах. Изначально созданный для того, чтобы помочь покупателям найти лучшие цены на товары в местных магазинах, он превратился в мощный инструмент для всех, кто хочет сэкономить пару баксов или даже больше.

Магия BrickSeek заключается в возможности отслеживать цены и запасы в режиме реального времени. Если вы охотник за выгодными покупками, перекупщик, желающий оптимизировать запасы, или просто любитель выгодных сделок, BrickSeek есть что вам предложить. Представьте себе, что вы точно знаете, где на складе находится тот самый неуловимый телевизор со скидкой, или узнаете, что игрушка, о которой так просил ваш ребенок, продается с половинной скидкой в магазине, расположенном всего в нескольких милях от вас. Такова сила отслеживания цен и управления запасами.

Введение в веб-скраппинг

Теперь перейдем к веб-скреппингу. Звучит технично и вроде как так и есть, но пусть вас это не отпугивает. По своей сути, веб-скрепинг - это автоматизация процесса сбора данных с веб-сайтов. Вместо того чтобы вручную проверять дюжину сайтов на предмет падения цен или обновления акций, веб-скрепер делает всю работу за вас, собирая данные в аккуратный, удобный для использования формат.

Думайте об этом как о супер старательном помощнике, который никогда не спит, постоянно проверяя обновления и возвращая нужную вам информацию. Цель веб-скреппинга - сделать сбор данных более быстрым, эффективным и менее утомительным.

Но с большой властью приходит и большая ответственность. Не стоит забывать и об этических соображениях. Не каждый сайт хочет, чтобы его данные соскабливались, а некоторые имеют условия предоставления услуг, которые прямо запрещают это делать. Есть и юридический аспект - неправильное использование данных может навлечь на вас неприятности. Поэтому важно знать правила и играть честно. Этичный скрапинг означает соблюдение политики сайта, не перегружать серверы большим количеством запросов и, самое главное, не использовать данные в неблаговидных целях.

Так что, если вы ботаник, любитель покупок или просто любите быть впереди всех, понимание сути и особенностей BrickSeek и веб-скреппинга откроет перед вами мир возможностей. И, как мы увидим, речь идет не только об экономии денег, но и о более разумном использовании своего времени и ресурсов.

Раздел 1: Понимание BrickSeek

Что такое BrickSeek?

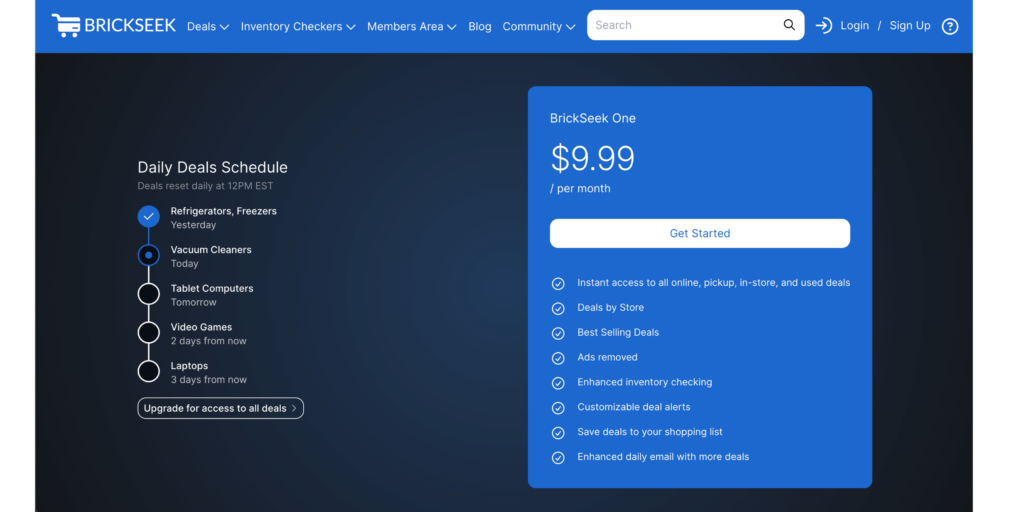

BrickSeek - это инструмент для отслеживания цен и инвентаризации, получивший известность среди охотников за выгодными покупками. Запущенный с целью помочь людям найти лучшие предложения в местных магазинах, он превратился в надежную платформу, предлагающую множество функций, рассчитанных на широкую аудиторию.

История и развитие:

Компания BrickSeek начинала свою деятельность как простой трекер товарных запасов для Walmart, а затем расширила свою деятельность, включив в нее такие крупные розничные сети, как Target, Lowe's, Office Depot и другие. Его развитие было обусловлено растущей потребностью потребителей в принятии обоснованных решений о покупке без необходимости посещать множество магазинов или веб-сайтов. Сегодня BrickSeek может похвастаться удобным интерфейсом и мощным бэкэндом, который собирает и обновляет данные в режиме реального времени.

Ключевые особенности и преимущества:

- Оповещения о ценах: Пользователи могут устанавливать оповещения для конкретных товаров, чтобы никогда не пропустить снижение цен или уведомление об отсутствии товара на складе.

- Отслеживание товарных запасов: Обновление информации о наличии товара у нескольких розничных продавцов в режиме реального времени.

- Поиск сделок: Составленный список актуальных предложений и распродаж.

- Местная лента уценок: Информация об уценках и распродажах в местных магазинах.

- Онлайн-сделки: Раздел, посвященный эксклюзивным онлайн-предложениям и скидкам.

Эти функции помогают пользователям экономить деньги и время, консолидируя информацию, которая в противном случае потребовала бы многочасового ручного поиска.

Примеры использования BrickSeek

Поиск сделок и скидок: Одно из основных назначений BrickSeek - поиск лучших предложений и скидок. Будь то новые технологические гаджеты, предметы домашнего обихода или детские игрушки, BrickSeek поможет вам найти лучшие цены в интернете и в магазине. Благодаря функциям оповещения о ценах и поиска сделок вы можете быть в курсе распродаж и акций, не проверяя постоянно несколько сайтов.

Отслеживание товарных запасов для торговых посредников: Учет товарных запасов в разных магазинах может стать логистическим кошмаром для продавцов. BrickSeek упрощает этот процесс, предоставляя данные о запасах в режиме реального времени. Это особенно полезно для тех, кто покупает товары оптом, чтобы перепродать их с прибылью. Зная, где и когда товары доступны, посредники могут более эффективно планировать свои закупки и избегать дефицита товара.

Сравнение цен для опытных покупателей: Для тех, кто хочет быть уверенным в том, что получает максимальную выгоду, функция сравнения цен BrickSeek просто неоценима. Сравнивая цены в нескольких магазинах, покупатели могут быть уверены, что не переплачивают. Это особенно полезно во время крупных торговых событий, таких как "черная пятница", "киберпонедельник" или распродажи, когда цены быстро колеблются.

BrickSeek - это универсальный инструмент, который удовлетворяет самые разные потребности - от случайных охотников за сделками до профессиональных перекупщиков. Его способность предоставлять точные данные в режиме реального времени делает его незаменимым помощником для тех, кто хочет сэкономить деньги и время.

Раздел 2: Основы веб-скрапинга

Что такое Веб-скрапинг?

Веб-скреппинг - это процесс автоматического извлечения данных с веб-сайтов. Эта техника обычно используется для сбора больших объемов данных, которые было бы сложно или долго собирать вручную. С помощью программного обеспечения или скриптов веб-скрепинг позволяет автоматизировать поиск информации, что делает возможным сбор и анализ данных в больших масштабах.

Определение и общие области применения

Веб-скреппинг подразумевает использование автоматизированных ботов для посещения веб-сайтов, анализа HTML и извлечения полезной информации. Это могут быть цены на продукцию, наличие товара на складе, отзывы покупателей и многое другое. Извлеченные данные можно хранить и анализировать для различных целей.

К распространенным способам применения веб-скреппинга относятся

- Мониторинг цен: Отслеживание цен на нескольких сайтах для поиска лучших предложений.

- Исследование рынка: Сбор данных о продукции конкурентов, ценах и отзывах клиентов.

- Агрегация контента: Сбор статей, блогов или новостей из различных источников для получения всеобъемлющего обзора.

- Добыча данных: Извлечение больших массивов данных для анализа в области финансов, здравоохранения и электронной коммерции.

Преимущества и проблемы

- Преимущества: Веб-скреппинг позволяет сэкономить время и ресурсы за счет автоматизации сбора данных. Он предоставляет актуальные и полные наборы данных, позволяя принимать более эффективные решения и осуществлять стратегическое планирование. Для бизнеса это означает сохранение конкурентоспособности за счет отслеживания тенденций рынка и поведения потребителей.

- Проблемы: Несмотря на свои преимущества, веб-скрепинг сопряжен с техническими и этическими проблемами. Веб-сайты часто меняют свою структуру, что может привести к поломке скриптов. Кроме того, работа с большими объемами данных требует надежной инфраструктуры и управления. Кроме того, очень важно обеспечить, чтобы деятельность по сбору данных не нарушала условия предоставления услуг или этические нормы.

Юридические и этические соображения

Когда речь идет о веб-скреппинге, важно понимать правовые и этические аспекты. Хотя сам по себе скраппинг не является незаконным, то, как он осуществляется, может вызвать юридические проблемы.

Понимание условий предоставления услуг

Большинство веб-сайтов имеют условия обслуживания (ToS), в которых изложены правила приемлемого использования. Скраппинг веб-сайта, нарушающего его ToS, может привести к судебному разбирательству, особенно если скраппинг будет обнаружен и нанесет ущерб работе веб-сайта. Поэтому важно изучить и соблюдать ToS любого сайта, который вы собираетесь скрапировать.

Этичные методы скрапинга

Этичный скраппинг включает в себя несколько лучших практик, обеспечивающих уважительное и законное отношение к процессу:

- Соблюдение Robots.txt: Этот файл на сайтах указывает, какие части сайта можно и нельзя соскабливать. Соблюдение этих правил является базовой этической практикой.

- Избегайте чрезмерной нагрузки: скраппинг может нагрузить сервер сайта. Ограничение частоты и объема запросов поможет избежать перегрузки сайта.

- Атрибуция и использование: если данные берутся для публикации или анализа, важно правильно указать источник. Кроме того, очень важно использовать данные так, чтобы не навредить оригинальному сайту или его пользователям.

- Защита персональных данных: При скрапинге следует избегать сбора личных данных, если на это нет прямого разрешения и соблюдаются правила защиты персональных данных.

В целом, несмотря на то, что веб-скреппинг предоставляет мощные возможности для сбора и анализа данных, к его использованию следует подходить ответственно. Понимание правовых последствий и соблюдение этических норм - ключевые факторы эффективного и устойчивого использования этой технологии.

Раздел 3: Начало работы со скраппингом BrickSeek

Инструменты и технологии

Для того чтобы отправиться в путешествие по скрапбукингу BrickSeek, необходимы правильные инструменты и технологии. Вот обзор основных языков программирования и библиотек, которые помогут вам добиться успеха.

Рекомендуемые языки программирования

- Python: Широко распространенный язык для веб-скреппинга благодаря своей простоте и огромному количеству доступных библиотек. Читабельность Python и поддержка сообщества делают его идеальным как для начинающих, так и для опытных разработчиков.

Библиотеки первой необходимости

- BeautifulSoup: Библиотека Python для разбора HTML- и XML-документов. Она создает дерево разбора для разобранных страниц, которое можно использовать для извлечения данных.

- Scrapy: Фреймворк для совместной работы над веб-страницами на Python с открытым исходным кодом. Scrapy - мощный и гибкий инструмент, позволяющий эффективно собирать и извлекать данные.

- Selenium: Библиотека для веб-тестирования, автоматизирующая работу браузеров. Она особенно полезна для сбора динамического контента, отображаемого с помощью JavaScript, который традиционные библиотеки могут пропустить.

Настройка среды

Прежде чем приступить к скраппингу, необходимо настроить среду. Вот пошаговое руководство, которое поможет вам начать.

Установка необходимого программного обеспечения и библиотек

- Install Python: Ensure Python is installed on your system. You can download it from python.org.

- Создайте виртуальную среду: Хорошей практикой является создание виртуальной среды для вашего проекта, чтобы управлять зависимостями. Это можно сделать с помощью venv.

python -m venv brickseek_scraper

source brickseek_scraper/bin/activate # On Windows, use `brickseek_scraper\Scripts\activate`- Установите библиотеки: Активировав виртуальную среду, установите необходимые библиотеки с помощью pip.

pip install beautifulsoup4 scrapy selenium requestsБазовая установка для проекта BrickSeek Scraper

- Создайте каталог проекта:

mkdir brickseek_scraper

cd brickseek_scraper- Инициализируйте проект Scrapy: Если вы используете Scrapy, инициализируйте новый проект.

scrapy startproject brickseek

cd brickseek- Настройка Selenium: Для работы с Selenium вам потребуется загрузить соответствующий WebDriver для вашего браузера (например, ChromeDriver для Google Chrome).

# Example for installing ChromeDriver

wget https://chromedriver.storage.googleapis.com/91.0.4472.101/chromedriver_linux64.zip

unzip chromedriver_linux64.zip

mv chromedriver /usr/local/bin/- Базовый паук Scrapy: Создайте простой паук Scrapy, чтобы начать скраппинг BrickSeek.

# brickseek/brickseek/spiders/brickseek_spider.py

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ["https://brickseek.com/"]

def parse(self, response):

self.log('Visited %s' % response.url)- Запуск паука: Запустите паука, чтобы проверить, все ли правильно настроено.

scrapy crawl brickseekНастроив свою среду с помощью этих инструментов и технологий, вы будете готовы приступить к сбору данных из BrickSeek. Такая подготовка обеспечит вам прочную основу для создания более сложных задач по сбору данных и эффективной работы с ними.

Раздел 4: Создание вашего скребка BrickSeek

Пошаговое руководство по скребку BrickSeek

Создание скрепера BrickSeek включает в себя несколько этапов, начиная с определения целевых данных и заканчивая написанием кода, который извлекает эту информацию. Давайте разделим их на части.

Определение целевых данных (URL, HTML-элементы):

- Начните с изучения BrickSeek: Зайдите на сайт BrickSeek и перейдите на страницы, которые вы хотите соскоблить. Посмотрите на шаблоны URL, страницы товаров и структуру HTML.

- Используйте инструменты разработчика: Откройте инструменты разработчика вашего браузера (обычно с помощью F12 или щелкните правой кнопкой мыши и выберите "Inspect"). Просмотрите HTML-элементы, содержащие интересующие вас данные (например, цены, состояние запасов и сведения о товаре).

Написание базового скребка с помощью BeautifulSoup/Scrapy

- Использование BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Define the URL of the page to scrape

url = 'https://brickseek.com/deal/'

# Send a GET request to the URL

response = requests.get(url)

# Parse the HTML content using BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

# Extract data (e.g., prices, inventory, product details)

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- Использование Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Работа с динамическим содержимым

Иногда нужный вам контент загружается динамически с помощью JavaScript. Вот как с этим справиться.

Использование Selenium для работы с JavaScript-рендерингом:

- Настройте Selenium:

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from selenium.webdriver.chrome.options import Options

chrome_options = Options()

chrome_options.add_argument("--headless")

service = Service('path/to/chromedriver')

driver = webdriver.Chrome(service=service, options=chrome_options)

driver.get('https://brickseek.com/deal/')

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')

driver.quit()Техники работы с AJAX и другими динамическими элементами

Дождитесь загрузки элементов: Используйте явное ожидание, чтобы убедиться, что элементы загрузились, прежде чем пытаться извлечь данные.

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

driver.get('https://brickseek.com/deal/')

WebDriverWait(driver, 10).until(

EC.presence_of_element_located((By.CLASS_NAME, 'item'))

)

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')Работа с бесконечной прокруткой: На страницах с бесконечной прокруткой может потребоваться прокрутка вниз, чтобы загрузить больше контента.

import time

driver.get('https://brickseek.com/deal/')

last_height = driver.execute_script("return document.body.scrollHeight")

while True:

driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(2)

new_height = driver.execute_script("return document.body.scrollHeight")

if new_height == last_height:

break

last_height = new_height

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')Следуя этим шагам, вы сможете создать надежный скрепер BrickSeek, который будет эффективно работать со статическим и динамическим контентом и беспрепятственно извлекать ценные данные.

Раздел 5: Усовершенствование вашего скребка

Чтобы улучшить свой скрапер BrickSeek, вы должны использовать передовые методы, которые обеспечат его эффективность и долговечность. В этом разделе мы расскажем о прокси-серверах для маскировки вашей личности и избежания запретов, а также о методах имитации человеческого поведения, чтобы оставаться незамеченным.

Реализация прокси-серверов

Зачем использовать прокси-серверы?

Прокси-серверы необходимы для веб-скрапинга, особенно если речь идет о сайтах со строгими мерами по борьбе со скрапингом. Вот почему вам стоит обратить внимание на использование прокси:

- Анонимность: Прокси-серверы скрывают ваш IP-адрес, благодаря чему ваши запросы отображаются из разных мест.

- Избегайте запретов: Использование нескольких прокси-серверов позволяет распределять запросы, снижая вероятность блокировки за чрезмерный трафик.

- Доступ к контенту с географическими ограничениями: Прокси-серверы могут создавать видимость того, что ваши запросы поступают из определенной страны, позволяя вам получать доступ к данным, ограниченным по региону.

Настройка прокси-серверов IPBurger для вашего скрепера

Using IPBurger proxies is straightforward. Here’s how to integrate them into your BrickSeek scraper:

- Подпишитесь на IPBurger:

- Visit IPBurger’s website and sign up for a proxy plan that fits your needs.

- Получите данные о вашем прокси-сервере, включая IP-адрес, порт, имя пользователя и пароль.

- Настройте прокси в своем коде:

с помощью Requests и BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Proxy details

proxies = {

'http': 'http://username:password@proxy_ip:proxy_port',

'https': 'https://username:password@proxy_ip:proxy_port'

}

url = 'https://brickseek.com/deal/'

response = requests.get(url, proxies=proxies)

soup = BeautifulSoup(response.text, 'html.parser')

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- С помощью Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def start_requests(self):

for url in self.start_urls:

yield scrapy.Request(url=url, callback=self.parse, meta={

'proxy': 'http://username:password@proxy_ip:proxy_port'

})

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Избегайте запретов и ограничений на тарифы

Чтобы ваш скрепер не был обнаружен и заблокирован, необходимо использовать методы, имитирующие поведение человека при просмотре веб-страниц.

Техники имитации человеческого поведения

- Рандомизация пользовательских агентов:

- Чередуйте строки user-agent, чтобы создать впечатление, что запросы поступают из разных браузеров.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (X11; Ubuntu; Linux x86_64; rv:89.0) Gecko/20100101 Firefox/89.0',

# Add more user agents as needed

]

headers = {

'User-Agent': random.choice(user_agents)

}response = requests.get(url, headers=headers, proxies=proxies)

- Реализация задержек и случайных интервалов:

- Вводите задержки между запросами, чтобы имитировать естественные шаблоны просмотра веб-страниц.

- Используйте случайные интервалы, чтобы избежать создания предсказуемого шаблона.

import time

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')

# Random delay between requests

time.sleep(random.uniform(1, 3))Интегрируя прокси и имитируя поведение человека, вы можете значительно повысить эффективность и долговечность вашего скрепера BrickSeek, обеспечив его бесперебойную и незамеченную работу в течение длительного времени.

Раздел 6: Управление данными и их хранение

После того как вы успешно собрали данные с BrickSeek, следующий важный шаг - эффективное управление и хранение этих данных. В этом разделе мы расскажем вам о различных способах хранения собранных данных, а также о том, как очистить и отформатировать их для дальнейшего анализа.

Хранение собранных данных

Варианты хранения данных

В зависимости от объема и сложности данных у вас есть несколько вариантов хранения собранных данных:

- Файлы CSV:

- Простота и удобство использования для небольших наборов данных.

- Совместим с большинством инструментов и программ для анализа данных.

- Идеально подходит для быстрого анализа и визуализации.

- Базы данных:

- Больше подходит для больших наборов данных и более сложных запросов.

- В качестве вариантов можно выбрать SQLite для локального хранения данных и MySQL или PostgreSQL для более надежных и масштабируемых решений.

- Обеспечивает лучшую целостность данных и облегчает доступ к ним для анализа.

- Облачное хранилище:

- Для масштабных проектов по скрапбукингу, требующих распределенных решений для хранения данных.

- В качестве вариантов можно использовать AWS S3, Google Cloud Storage или Azure Blob Storage.

- Обеспечивает высокую доступность и масштабируемость.

Запись данных в файлы

Вот как можно записать собранные данные в CSV-файл или базу данных:

Запись в файл CSV:

import csv

data = [

{'title': 'Deal 1', 'price': '$10'},

{'title': 'Deal 2', 'price': '$15'},

# Add more data as needed

]

with open('deals.csv', mode='w', newline='') as file:

writer = csv.DictWriter(file, fieldnames=['title', 'price'])

writer.writeheader()

for item in data:

writer.writerow(item)Запись в базу данных SQLite:

import sqlite3

# Connect to the SQLite database (or create it if it doesn't exist)

conn = sqlite3.connect('deals.db')

cursor = conn.cursor()

# Create a table

cursor.execute('''

CREATE TABLE IF NOT EXISTS deals (

id INTEGER PRIMARY KEY,

title TEXT,

price TEXT

)

''')

# Insert data into the table

data = [

('Deal 1', '$10'),

('Deal 2', '$15'),

# Add more data as needed

]

cursor.executemany('INSERT INTO deals (title, price) VALUES (?, ?)', data)

conn.commit()

# Close the connection

conn.close()Очистка и форматирование данных

Сырые данные, собранные с веб-сайтов, часто нуждаются в очистке и форматировании перед анализом. Вот несколько основных приемов подготовки данных.

Основные методы очистки данных

Удаление дубликатов:

- Убедитесь, что каждая запись в вашем наборе данных уникальна.

import pandas as pd

df = pd.read_csv('deals.csv')

df.drop_duplicates(inplace=True)

df.to_csv('deals_cleaned.csv', index=False)Работа с пропущенными значениями:

- Заполните недостающие значения или удалите записи с отсутствующими данными.

df = pd.read_csv('deals.csv')

df.dropna(inplace=True) # Remove rows with missing values

df.fillna('N/A', inplace=True) # Fill missing values with 'N/A'

df.to_csv('deals_cleaned.csv', index=False)Нормализация форматов данных:

- Обеспечьте согласованность форматов данных (например, форматов цен, дат).

df['price'] = df['price'].str.replace('$', '').astype(float)

df.to_csv('deals_cleaned.csv', index=False)Структурирование данных для анализа

Организация данных в таблицы:

- Структурируйте данные в таблицы с четкими заголовками и согласованными типами данных.

- Для реляционных баз данных обеспечьте надлежащую нормализацию и взаимосвязи между таблицами.

Использование рамок данных:

- DataFrames, подобные тем, что предоставляет Pandas в Python, предлагают мощные инструменты для манипулирования данными и их анализа.

import pandas as pd

df = pd.read_csv('deals_cleaned.csv')

# Perform analysis and manipulationsЭффективное управление и хранение собранных данных позволяет обеспечить их готовность к анализу и дальнейшему использованию. Правильная обработка данных позволит вам сэкономить время и силы, сделав процесс анализа данных более плавным и эффективным.

Раздел 7: Анализ и использование данных

После того как вы успешно собрали и сохранили данные с BrickSeek, следующим шагом будет их анализ для извлечения ценных сведений. В этом разделе мы расскажем вам о базовых и продвинутых методах анализа данных, которые помогут вам извлечь максимум пользы из собранных данных.

Анализ основных данных

Инструменты и техники для анализа данных, полученных с помощью скрапа

Excel/Google Sheets:

- Применение: Идеально подходит для быстрого и простого анализа данных.

- Техники:

- Сортировка и фильтрация данных.

- Использование таблиц pivot для обобщения и изучения данных.

- Применение формул и функций для вычислений и преобразований.

Pandas (библиотека Python):

- Использование: Мощный инструмент для манипулирования данными и их анализа.

- Техники:

- Чтение данных в DataFrames для структурированного анализа.

- Выполнение описательной статистики (среднее значение, медиана, стандартное отклонение).

- Группировка и агрегирование данных для поиска закономерностей.

import pandas as pd

# Load data into a DataFrame

df = pd.read_csv('deals_cleaned.csv')

# Basic statistics

print(df.describe())

# Group by a specific column and aggregate

grouped = df.groupby('category').mean()

print(grouped)Инструменты визуализации (Matplotlib, Seaborn, Tableau):

- Использование: Визуализация данных для выявления тенденций и закономерностей.

- Техники:

- Создание линейных графиков, гистограмм, гистограмм и диаграмм рассеяния.

- Использование тепловых карт для корреляционного анализа.

import matplotlib.pyplot as plt

import seaborn as sns

# Plot a histogram of prices

sns.histplot(df['price'], bins=20, kde=True)

plt.show()

# Create a bar chart

df['category'].value_counts().plot(kind='bar')

plt.show()Нахождение закономерностей и понимания

- Анализ тенденций:

- Обратите внимание на тенденции, наблюдаемые в течение времени, например, колебания цен, сезонные скидки или изменения в уровне запасов.

- Пример: Определение периодов с наибольшими скидками на определенные категории товаров.

- Сравнительный анализ:

- Сравните цены в разных магазинах, чтобы найти лучшие предложения.

- Пример: Сравнение средней цены продукта на разных платформах.

- Корреляционный анализ:

- Определите взаимосвязь между различными переменными.

- Пример: Корреляция цен на продукцию с уровнем запасов для понимания динамики спроса и предложения.

Расширенный анализ

Использование машинного обучения для прогнозирования

Предсказательное моделирование:

- Применяйте алгоритмы машинного обучения для прогнозирования будущих тенденций на основе исторических данных.

- Пример: Прогнозирование будущих цен на товары на основе прошлых данных с помощью регрессионных моделей.

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

# Prepare data for modeling

X = df[['feature1', 'feature2']] # Replace with relevant features

y = df['price']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Train a regression model

model = LinearRegression()

model.fit(X_train, y_train)

# Make predictions

predictions = model.predict(X_test)Кластеризация:

- Используйте алгоритмы кластеризации для разделения товаров на категории на основе сходства.

- Пример: Группировка товаров по ценовому диапазону, категории и популярности для выявления отдельных кластеров.

from sklearn.cluster import KMeans

# Prepare data for clustering

features = df[['feature1', 'feature2']] # Replace with relevant features

# Perform K-means clustering

kmeans = KMeans(n_clusters=3, random_state=42)

df['cluster'] = kmeans.fit_predict(features)Интеграция с другими источниками данных для более глубокого анализа

- Объединение наборов данных:

- Интегрируйте данные BrickSeek с другими источниками информации, такими как данные о продажах, отзывы покупателей или цены конкурентов, чтобы получить всесторонний анализ.

- Пример: Объединение данных о ценах BrickSeek с данными о результатах продаж для анализа влияния ценовых стратегий на продажи.

- API и базы данных:

- Используйте API для получения дополнительных данных или подключения к внешним базам данных для более глубокого анализа.

- Пример: Использование API-интерфейсов электронной коммерции для получения данных о наличии товара и отзывов о нем в режиме реального времени.

- Визуализация данных Приборные панели:

- Создавайте интерактивные информационные панели с помощью таких инструментов, как Tableau, Power BI или Plotly Dash, для визуализации интегрированных данных и мониторинга ключевых показателей.

- Пример: Создание приборной панели в режиме реального времени для отслеживания тенденций изменения цен, товарных запасов и цен конкурентов.

Эти базовые и расширенные методы анализа данных помогут вам извлечь ценную информацию из данных BrickSeek, что позволит вам принимать обоснованные решения, оптимизировать свои стратегии и оставаться впереди на конкурентном рынке.

Раздел 8: Устранение неполадок и оптимизация

Создание скрепера BrickSeek может быть полезным, но, как и любая сложная задача, оно сопряжено с определенными трудностями. Этот раздел поможет вам устранить общие неполадки и оптимизировать работу скрепера для достижения наилучшей производительности, гарантируя, что вы получите максимальную отдачу от своих усилий по извлечению данных.

Общие проблемы и решения

Работа с распространенными ошибками и проблемами

- Ошибки HTTP (404, 500 и т. д.):

- Проблема: Во время поиска вы можете столкнуться с ошибками HTTP, такими как 404 (Not Found) или 500 (Internal Server Error).

- Решение: Реализуйте обработку ошибок в скрепере, чтобы изящно справляться с ними. Используйте блоки try-except для перехвата исключений и повторного выполнения запроса после небольшой задержки.

import requests

from time import sleep

url = 'http://example.com'

for attempt in range(5):

try:

response = requests.get(url)

response.raise_for_status() # Raises an HTTPError for bad responses

break # Exit loop if request is successful

except requests.exceptions.RequestException as e:

print(f'Error: {e}, retrying...')

sleep(5)- CAPTCHA и меры по борьбе с ботами:

- Проблема: На сайтах часто используются CAPTCHA и другие механизмы защиты от ботов, чтобы предотвратить скраппинг.

- Solution: Use IP rotation with proxies, and consider integrating CAPTCHA-solving services if necessary. Implement delays and random intervals between requests to mimic human behavior.

import random

from time import sleep

delay = random.uniform(2, 5) # Random delay between 2 and 5 seconds

sleep(delay)- JavaScript-рендеринг содержимого:

- Проблема: Некоторый контент на BrickSeek может быть отображен с помощью JavaScript, с которым статические скреперы вроде BeautifulSoup не справляются.

- Решение: Используйте Selenium для работы с содержимым, отображаемым на JavaScript.

from selenium import webdriver

driver = webdriver.Chrome()

driver.get('http://example.com')

content = driver.page_source- Заблокированные IP-адреса:

- Проблема: ваш IP-адрес может быть заблокирован из-за частых запросов.

- Solution: Use IPBurger proxies to rotate IP addresses and avoid detection.

proxy = "http://proxyserver:port"

proxies = {

"http": proxy,

"https": proxy,

}

response = requests.get(url, proxies=proxies)Оптимизация производительности вашего скребка

- Эффективное извлечение данных:

- Минимизируйте количество запрашиваемых данных, нацеливаясь на определенные элементы и атрибуты HTML.

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

price = soup.find('span', {'class': 'price'}).text- Параллельные запросы:

- Используйте асинхронные библиотеки, такие как aiohttp, или многопоточность для выполнения параллельных запросов и ускорения извлечения данных.

import asyncio

import aiohttp

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main(urls):

async with aiohttp.ClientSession() as session:

tasks = [fetch(session, url) for url in urls]

return await asyncio.gather(*tasks)

urls = ['http://example.com/page1', 'http://example.com/page2']

loop = asyncio.get_event_loop()

pages = loop.run_until_complete(main(urls))- Кэширование и дросселирование:

- Внедрите кэширование, чтобы избежать избыточных запросов на одни и те же данные, и дросселируйте запросы, чтобы предотвратить перегрузку сервера.

from cachetools import TTLCache

cache = TTLCache(maxsize=100, ttl=300)

def get_page(url):

if url in cache:

return cache[url]

response = requests.get(url)

cache[url] = response.text

return response.textДополнительные советы и рекомендации

Советы экспертов по использованию скребка BrickSeek

- Динамические пользовательские агенты:

- Чередуйте агенты пользователя, чтобы имитировать разные браузеры и снизить вероятность блокировки.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_11_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36',

# Add more user agents

]

headers = {'User-Agent': random.choice(user_agents)}

response = requests.get(url, headers=headers)- Постоянство сеанса:

- Используйте объекты сеанса для сохранения файлов cookie и заголовков при нескольких запросах, что помогает поддерживать сеансы входа в систему и уменьшает количество обнаружений.

session = requests.Session()

session.headers.update({'User-Agent': random.choice(user_agents)})

response = session.get(url)Стратегии непрерывного совершенствования

- Регулярное обслуживание:

- Регулярно обновляйте свой скрепер, чтобы адаптировать его к изменениям в структуре сайта BrickSeek. Автоматический мониторинг может предупредить вас о необходимых обновлениях.

import requests

def monitor_changes(url, current_structure):

response = requests.get(url)

new_structure = response.text

if new_structure != current_structure:

print("Website structure has changed!")

# Update scraper logic here- Петля обратной связи:

- Внедрите петлю обратной связи, чтобы учиться на ошибках и показателях производительности, постоянно совершенствуя свой скребок для повышения эффективности и точности.

import logging

logging.basicConfig(filename='scraper.log', level=logging.INFO)

def log_error(error):

logging.error(f"Error occurred: {error}")

try:

response = requests.get(url)

response.raise_for_status()

except requests.exceptions.RequestException as e:

log_error(e)Следование этим методам устранения неполадок и оптимизации гарантирует, что ваш скрепер BrickSeek будет работать бесперебойно, качественно и эффективно, предоставляя ценные данные для ваших различных нужд.

Заключение

Обзор ключевых моментов

Создание скрепера BrickSeek открывает мир возможностей для отслеживания цен, поиска сделок и управления запасами. В этом руководстве мы рассмотрели:

- Понимание BrickSeek: От истории и разработки до ключевых особенностей и вариантов использования.

- Основы веб-скрапинга: Определение веб-скрапинга, его преимущества и проблемы, а также важность этических аспектов.

- Начало работы: Инструменты, технологии и настройка среды для веб-скрепинга.

- Создайте свой скрепер: Пошаговое руководство по созданию базового скрепера, работе с динамическим контентом и извлечению релевантных данных.

- Улучшение вашего скрепера: Использованиепрокси-серверов, обход запретов и имитация человеческого поведения для обеспечения бесперебойной работы.

- Управление данными: Хранение, очистка и форматирование собранных данных для анализа.

- Анализ и использование данных: Инструменты и методы для интеграции базового и расширенного анализа данных с другими источниками данных.

- Устранение неполадок и оптимизация: Решение распространенных проблем, оптимизация производительности и дополнительные советы по улучшению вашего скрепера.

Тенденции будущего

С развитием технологий меняется и ландшафт веб-скреппинга и анализа данных. Вот некоторые тенденции, за которыми стоит следить:

- Новые технологии в веб-скрапинге: Использование искусственного интеллекта и машинного обучения для создания более сложных и эффективных скреперов, способных адаптироваться к изменяющимся структурам сайтов и извлекать более богатые данные.

- Будущее отслеживания цен и управления запасами: Появятся более совершенные инструменты и платформы, которые будут предоставлять данные в режиме реального времени и позволят разрабатывать динамические стратегии ценообразования, улучшать управление запасами и повышать качество обслуживания клиентов.

Повышение эффективности веб-скрапинга с помощью IPBurger

Реализация прокси-серверов имеет решающее значение для создания эффективного и надежного веб-скрапера. Прокси помогают избежать запрета IP-адресов, распределить запросы и сохранить анонимность при сборе данных. IPBurger предлагает ряд высококачественных прокси-сервисов, включая прокси-серверы для жилых домов, мобильных устройств и центров обработки данных, разработанные с учетом потребностей веб-скреперов.

- Безопасность и анонимность: прокси-серверы IPBurger обеспечивают анонимность и безопасность вашей деятельности по скраппингу, защищая ваши данные от отслеживания или перехвата.

- Avoiding Bans: By rotating IP addresses and mimicking human behavior, IPBurger’s proxies help you avoid detection and bans, ensuring uninterrupted scraping.

- Глобальный охват: Доступ к данным из разных географических точек с помощью глобальной прокси-сети IPBurger, что расширяет ваши возможности по локализованному скраппингу и анализу.

Теперь, когда вы всесторонне разобрались в создании скрепера BrickSeek, пришло время применить полученные знания на практике. Начните свой проект по скраппингу уже сегодня и оцените преимущества автоматизации отслеживания цен и управления запасами. Не забудьте воспользоваться прокси-сервисами IPBurger для повышения эффективности ваших усилий по скраппингу и обеспечения надежного и безопасного сбора данных.

Мы призываем вас делиться своим опытом, проблемами и советами в разделе комментариев. Ваши идеи могут помочь другим участникам сообщества и способствовать постоянному совершенствованию методов веб-скрепинга.

Счастливого скрапбукинга!