Parlons de BrickSeek Scraper.

Vous êtes peut-être tombé sur ce joyau si vous avez déjà cherché une bonne affaire en ligne. BrickSeek est en quelque sorte votre détective personnel, qui parcourt le web pour trouver les meilleurs prix de produits chez différents détaillants. Conçu à l'origine pour aider les acheteurs à trouver les meilleurs prix sur les articles des magasins locaux, il est devenu un outil puissant pour tous ceux qui cherchent à économiser un ou deux dollars, voire plus.

La magie de BrickSeek réside dans sa capacité à suivre les prix et les stocks en temps réel. Que vous soyez un chasseur de bonnes affaires, un revendeur cherchant à optimiser ses stocks ou un amateur de bonnes affaires, BrickSeek a quelque chose à vous offrir. Imaginez que vous sachiez exactement où se trouve en stock l'insaisissable téléviseur à prix réduit ou que vous découvriez que le jouet que votre enfant vous réclame est à moitié prix dans un magasin situé à quelques kilomètres de là. C'est la puissance du suivi des prix et de la gestion des stocks.

Introduction au Web Scraping

Passons maintenant au web scraping. Cela semble technique et l'est en quelque sorte, mais ne vous laissez pas effrayer. À la base, le web scraping consiste à automatiser le processus de collecte de données sur les sites web. Au lieu de vérifier manuellement sur une douzaine de sites les baisses de prix ou les mises à jour d'actions, un scraper web fait le gros du travail à votre place, en rassemblant les données dans un format propre et utilisable.

C'est un peu comme si vous aviez un assistant super diligent qui ne dort jamais, qui vérifie constamment les mises à jour et vous renvoie les informations dont vous avez besoin. Le web scraping vise à rendre la collecte de données plus rapide, plus efficace et moins fastidieuse.

Mais un grand pouvoir s'accompagne d'une grande responsabilité. Il y a des considérations éthiques à garder à l'esprit. Tous les sites web ne souhaitent pas que leurs données soient récupérées, et certains ont des conditions d'utilisation qui l'interdisent explicitement. Il y a aussi l'aspect juridique : une mauvaise utilisation du scraping peut vous mettre dans l'eau chaude. Il est donc essentiel de connaître les règles et de jouer franc jeu. Le scraping éthique consiste à respecter les politiques des sites web, à ne pas surcharger les serveurs avec un trop grand nombre de requêtes et, surtout, à ne pas utiliser les données à des fins malveillantes.

Ainsi, que vous soyez un passionné de données, un acheteur avisé ou simplement quelqu'un qui aime avoir une longueur d'avance, comprendre les tenants et les aboutissants de BrickSeek et du web scraping peut vous ouvrir un monde de possibilités. Et, comme nous le verrons, il ne s'agit pas seulement d'économiser de l'argent, mais aussi de faire un usage plus intelligent de votre temps et de vos ressources.

Section 1 : Comprendre BrickSeek

Qu'est-ce que BrickSeek ?

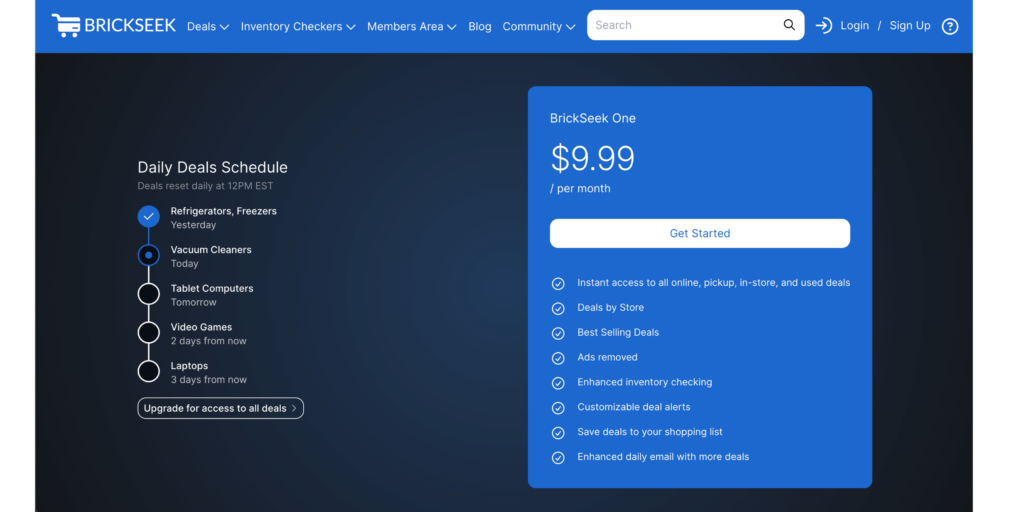

BrickSeek est un outil de suivi des prix et de vérification des stocks qui s'est fait un nom parmi les chasseurs de bonnes affaires et les acheteurs avertis. Lancé avec l'idée d'aider les gens à trouver les meilleures affaires dans les magasins locaux, il a évolué en une plateforme robuste offrant une variété de fonctionnalités qui s'adressent à un large public.

Histoire et développement :

BrickSeek a débuté comme un simple outil de suivi des stocks pour Walmart et s'est depuis étendu à de grands détaillants tels que Target, Lowe's, Office Depot et bien d'autres encore. Son développement a été motivé par le besoin croissant des consommateurs de prendre des décisions d'achat éclairées sans avoir à visiter plusieurs magasins ou sites web. Aujourd'hui, BrickSeek est doté d'une interface conviviale et d'un puissant backend qui collecte et met à jour les données en temps réel.

Principales caractéristiques et avantages :

- Alertes de prix : Les utilisateurs peuvent définir des alertes pour des produits spécifiques, ce qui leur permet de ne jamais manquer une baisse de prix ou une notification de rupture de stock.

- Suivi des stocks : Mise à jour en temps réel de la disponibilité des produits chez plusieurs détaillants.

- Recherche de bonnes affaires : Une liste de bonnes affaires et d'articles en déstockage.

- Fil de démarques locales : Informations sur les démarques et les articles en déstockage des magasins locaux.

- Offres en ligne : Une section dédiée aux offres et réductions exclusives en ligne.

Ces fonctionnalités permettent aux utilisateurs d'économiser de l'argent et du temps en consolidant des informations qui nécessiteraient autrement des heures de recherche manuelle.

Cas d'utilisation de BrickSeek

Recherche d'offres et de réductions: L'une des principales utilisations de BrickSeek est de trouver les meilleures offres et réductions disponibles. Qu'il s'agisse d'un nouveau gadget technologique, d'articles ménagers ou de jouets pour les enfants, BrickSeek peut vous aider à trouver les meilleurs prix en ligne et en magasin. Grâce à ses alertes de prix et à ses fonctions de recherche de bonnes affaires, vous pouvez rester à l'affût des ventes et des promotions sans avoir à consulter constamment plusieurs sites Web.

Suivi des stocks pour les revendeurs: La gestion des stocks dans différents magasins peut être un cauchemar logistique pour les revendeurs. BrickSeek simplifie ce processus en fournissant des données d'inventaire en temps réel. Ceci est particulièrement utile pour ceux qui achètent des produits en gros pour les revendre avec un bénéfice. Le fait de savoir où et quand les produits sont disponibles permet aux revendeurs de planifier leurs achats plus efficacement et d'éviter les ruptures de stock.

Comparaison des prix pour les acheteurs avertis: Pour ceux qui veulent s'assurer qu'ils en ont pour leur argent, la fonction de comparaison des prix de BrickSeek est inestimable. En comparant les prix de plusieurs détaillants, les acheteurs peuvent s'assurer qu'ils ne paient pas trop cher. Cette fonction est particulièrement utile lors des grands événements commerciaux tels que le Black Friday, le Cyber Monday ou les soldes de rentrée scolaire, lorsque les prix fluctuent rapidement.

BrickSeek est un outil polyvalent qui répond à différents besoins, qu'il s'agisse de chasseurs d'affaires occasionnels ou de revendeurs professionnels. Sa capacité à fournir des données précises en temps réel en fait une ressource essentielle pour tous ceux qui cherchent à économiser de l'argent et du temps.

Section 2 : Les bases du Web Scraping

Qu'est-ce que le "Web Scraping" ?

Le web scraping est le processus d'extraction automatique de données à partir de sites web. Cette technique est couramment utilisée pour collecter de grandes quantités de données qu'il serait long ou difficile de rassembler manuellement. À l'aide de logiciels ou de scripts, le web scraping permet d'automatiser la recherche d'informations, ce qui rend possible la collecte et l'analyse de données à grande échelle.

Définition et applications courantes

Le web scraping consiste à utiliser des robots automatisés pour visiter des sites web, analyser le code HTML et extraire des informations utiles. Il peut s'agir des prix des produits, de la disponibilité des stocks, des commentaires des clients, etc. Les données extraites peuvent ensuite être stockées et analysées à diverses fins.

Les applications courantes du web scraping sont les suivantes

- Surveillance des prix : Suivi des prix sur plusieurs sites web pour trouver les meilleures offres.

- L'étude de marché : Collecte de données sur les produits et les prix des concurrents, ainsi que sur les réactions des clients.

- Agrégation de contenu : Rassembler des articles, des blogs ou des nouvelles provenant de diverses sources pour obtenir une vue d'ensemble.

- Exploration de données : Extraction de grands ensembles de données à des fins d'analyse dans les domaines de la finance, de la santé et du commerce électronique.

Avantages et défis

- Avantages : Le web scraping permet de gagner du temps et d'économiser des ressources en automatisant la collecte de données. Il fournit des ensembles de données actualisés et complets, ce qui permet d'améliorer la prise de décision et la planification stratégique. Pour les entreprises, cela signifie rester compétitives en se tenant au courant des tendances du marché et du comportement des consommateurs.

- Défis : Malgré ses avantages, le web scraping pose des problèmes techniques et éthiques. Les sites web changent souvent de structure, ce qui peut casser les scripts de scraping. En outre, le traitement de grandes quantités de données nécessite une infrastructure et une gestion solides. En outre, il est essentiel de s'assurer que les activités de scraping ne violent pas les conditions de service ou les normes éthiques.

Considérations juridiques et éthiques

Lorsqu'il s'agit de "web scraping", il est essentiel de comprendre le paysage juridique et éthique. Si le scraping en lui-même n'est pas illégal, la manière dont il est effectué peut soulever des questions juridiques.

Comprendre les conditions d'utilisation

La plupart des sites web ont des conditions de service (ToS) qui décrivent les politiques d'utilisation acceptables. La récupération d'un site web qui enfreint ses CGS peut donner lieu à des poursuites judiciaires, en particulier si l'activité de récupération est détectée et nuit au fonctionnement du site web. Il est donc important d'examiner et de respecter les CGS de tout site que vous avez l'intention d'utiliser.

Pratiques éthiques de scraping

Le scraping éthique implique plusieurs bonnes pratiques pour garantir que le processus est respectueux et légal :

- Respecter Robots.txt : Ce fichier sur les sites web indique quelles parties du site peuvent ou ne peuvent pas être scrappées. Le respect de ces directives est une pratique éthique de base.

- Éviter une charge excessive : le scraping peut mettre à rude épreuve le serveur d'un site web. Limiter la fréquence et le volume des demandes permet d'éviter de surcharger le site.

- Attribution et utilisation : si des données sont récupérées à des fins de publication ou d'analyse, il est essentiel d'en créditer correctement la source. En outre, il est essentiel d'utiliser les données de manière à ne pas nuire au site d'origine ou à ses utilisateurs.

- Protection des données personnelles : Le scraping doit éviter de collecter des données à caractère personnel, sauf autorisation explicite et respect de la réglementation en matière de confidentialité des données.

En résumé, si le web scraping offre de puissantes capacités de collecte et d'analyse de données, il doit être mené de manière responsable. Il est essentiel de comprendre les implications juridiques et d'adhérer à des normes éthiques pour tirer parti de cette technologie de manière efficace et durable.

Section 3 : Démarrer avec BrickSeek Scraping

Outils et technologies

Pour se lancer dans le scraping sur BrickSeek, il faut disposer des bons outils et des bonnes technologies. Voici un aperçu des langages de programmation et des bibliothèques essentiels qui vous permettront de réussir.

Langages de programmation recommandés

- Python : Largement considéré comme le langage de référence pour le web scraping en raison de sa simplicité et de la vaste gamme de bibliothèques disponibles. La lisibilité de Python et le soutien de la communauté en font un langage idéal pour les débutants et les développeurs expérimentés.

Bibliothèques essentielles

- BeautifulSoup : Une bibliothèque Python pour l'analyse des documents HTML et XML. Elle crée un arbre d'analyse pour les pages analysées qui peut être utilisé pour extraire facilement des données.

- Scrapy : Un cadre d'exploration du web collaboratif et open-source pour Python. Scrapy est puissant et flexible, vous permettant de récupérer et d'extraire des données de manière efficace.

- Selenium : Une bibliothèque de test web qui automatise les navigateurs. Elle est particulièrement utile pour récupérer le contenu dynamique rendu par JavaScript, que les bibliothèques de récupération traditionnelles risquent de ne pas voir.

Configuration de l'environnement

Avant de commencer le scraping, vous devez configurer votre environnement. Voici un guide étape par étape pour vous aider à démarrer.

Installation des logiciels et des bibliothèques nécessaires

- Install Python: Ensure Python is installed on your system. You can download it from python.org.

- Mettre en place un environnement virtuel : Il est conseillé de créer un environnement virtuel pour votre projet afin de gérer les dépendances. Vous pouvez le faire en utilisant venv.

python -m venv brickseek_scraper

source brickseek_scraper/bin/activate # On Windows, use `brickseek_scraper\Scripts\activate`- Installer les bibliothèques : Une fois votre environnement virtuel activé, installez les bibliothèques nécessaires à l'aide de pip.

pip install beautifulsoup4 scrapy selenium requestsConfiguration de base pour un projet BrickSeek Scraper

- Créer un répertoire de projets :

mkdir brickseek_scraper

cd brickseek_scraper- Initialiser un projet Scrapy : Si vous utilisez Scrapy, initialisez un nouveau projet.

scrapy startproject brickseek

cd brickseek- Configuration de Selenium : Pour Selenium, vous devez télécharger le WebDriver correspondant à votre navigateur (par exemple, ChromeDriver pour Google Chrome).

# Example for installing ChromeDriver

wget https://chromedriver.storage.googleapis.com/91.0.4472.101/chromedriver_linux64.zip

unzip chromedriver_linux64.zip

mv chromedriver /usr/local/bin/- Spider Scrapy de base : Créer un simple spider Scrapy pour commencer à scraper BrickSeek.

# brickseek/brickseek/spiders/brickseek_spider.py

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ["https://brickseek.com/"]

def parse(self, response):

self.log('Visited %s' % response.url)- Exécution de l'araignée : Exécutez l'araignée pour vérifier que tout est correctement configuré.

scrapy crawl brickseekEn configurant votre environnement avec ces outils et technologies, vous êtes prêt à commencer à extraire des données de BrickSeek. Cette préparation vous permet de disposer d'une base solide pour élaborer des tâches de scraping plus complexes et traiter les données efficacement.

Section 4 : Construction de votre BrickSeek Scraper

Guide étape par étape de BrickSeek Scraper

La création d'un scraper BrickSeek comporte plusieurs étapes, depuis l'identification des données cibles jusqu'à l'écriture du code qui extrait ces informations. Décomposons ces étapes.

Identification des données cibles (URL, éléments HTML) :

- Commencez par explorer BrickSeek : Visitez BrickSeek et naviguez jusqu'aux pages que vous souhaitez récupérer. Examinez les modèles d'URL, les pages de produits et la structure du code HTML.

- Utilisez les outils de développement : Ouvrez les outils de développement de votre navigateur (généralement en appuyant sur la touche F12 ou en cliquant avec le bouton droit de la souris et en sélectionnant "Inspecter"). Inspectez les éléments HTML qui contiennent les données qui vous intéressent (comme les prix, l'état des stocks et les détails du produit).

Écrire un scraper de base avec BeautifulSoup/Scrapy

- Utilisation de BeautifulSoup :

import requests

from bs4 import BeautifulSoup

# Define the URL of the page to scrape

url = 'https://brickseek.com/deal/'

# Send a GET request to the URL

response = requests.get(url)

# Parse the HTML content using BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

# Extract data (e.g., prices, inventory, product details)

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- Utilisation de Scrapy :

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Gestion du contenu dynamique

Parfois, le contenu dont vous avez besoin est chargé dynamiquement à l'aide de JavaScript. Voici comment procéder.

Utilisation de Selenium pour le contenu rendu par JavaScript :

- Configurer Selenium :

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from selenium.webdriver.chrome.options import Options

chrome_options = Options()

chrome_options.add_argument("--headless")

service = Service('path/to/chromedriver')

driver = webdriver.Chrome(service=service, options=chrome_options)

driver.get('https://brickseek.com/deal/')

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')

driver.quit()Techniques pour gérer AJAX et d'autres éléments dynamiques

Attendre le chargement des éléments : Utilisez des attentes explicites pour vous assurer que les éléments ont été chargés avant d'essayer d'extraire des données.

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

driver.get('https://brickseek.com/deal/')

WebDriverWait(driver, 10).until(

EC.presence_of_element_located((By.CLASS_NAME, 'item'))

)

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')Gestion du défilement infini : Pour les pages à défilement infini, il peut être nécessaire de faire défiler la page vers le bas pour charger davantage de contenu.

import time

driver.get('https://brickseek.com/deal/')

last_height = driver.execute_script("return document.body.scrollHeight")

while True:

driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(2)

new_height = driver.execute_script("return document.body.scrollHeight")

if new_height == last_height:

break

last_height = new_height

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')En suivant ces étapes, vous pouvez construire un scraper BrickSeek robuste qui gère efficacement le contenu statique et dynamique et extrait des données précieuses de manière transparente.

Section 5 : Améliorer votre grattoir

Pour améliorer votre BrickSeek scraper, vous devez intégrer des techniques avancées qui garantissent son efficacité et sa longévité. Cette section traite des proxys permettant de masquer votre identité et d'éviter les interdictions, ainsi que des méthodes permettant d'imiter le comportement humain afin de rester sous le radar.

Mise en œuvre des mandataires

Pourquoi utiliser des mandataires ?

Les proxys sont essentiels pour le web scraping, en particulier lorsqu'il s'agit de cibler des sites dont les mesures anti-scraping sont strictes. Voici pourquoi vous devriez envisager d'utiliser des proxys :

- Anonymity: Proxies hide your IP address, making your requests appear from different locations.

- Éviter les interdictions : L'utilisation de plusieurs serveurs mandataires permet de répartir les demandes, réduisant ainsi le risque de blocage pour cause de trafic excessif.

- Accès à des contenus géo-restreints : Les serveurs mandataires peuvent donner l'impression que vos requêtes proviennent d'un pays spécifique, ce qui vous permet d'accéder à des données verrouillées au niveau régional.

Configuration des serveurs mandataires IPBurger pour votre scraper

Using IPBurger proxies is straightforward. Here’s how to integrate them into your BrickSeek scraper:

- S'inscrire à IPBurger :

- Visit IPBurger’s website and sign up for a proxy plan that fits your needs.

- Obtenez les détails de votre proxy, y compris l'adresse IP, le port, le nom d'utilisateur et le mot de passe.

- Configurer les proxys dans votre code :

avec Requests et BeautifulSoup :

import requests

from bs4 import BeautifulSoup

# Proxy details

proxies = {

'http': 'http://username:password@proxy_ip:proxy_port',

'https': 'https://username:password@proxy_ip:proxy_port'

}

url = 'https://brickseek.com/deal/'

response = requests.get(url, proxies=proxies)

soup = BeautifulSoup(response.text, 'html.parser')

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- Avec Scrapy :

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def start_requests(self):

for url in self.start_urls:

yield scrapy.Request(url=url, callback=self.parse, meta={

'proxy': 'http://username:password@proxy_ip:proxy_port'

})

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Éviter les interdictions et les limitations de taux

Vous devez mettre en œuvre des techniques qui imitent le comportement de navigation humain pour éviter que votre scraper ne soit détecté et interdit.

Techniques pour imiter le comportement humain

- Randomiser les agents utilisateurs :

- Faire pivoter les chaînes de l'agent utilisateur pour que les demandes semblent provenir de différents navigateurs.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (X11; Ubuntu; Linux x86_64; rv:89.0) Gecko/20100101 Firefox/89.0',

# Add more user agents as needed

]

headers = {

'User-Agent': random.choice(user_agents)

}response = requests.get(url, headers=headers, proxies=proxies)

- Mise en œuvre de délais et d'intervalles aléatoires :

- Introduire des délais entre les demandes pour imiter les schémas de navigation naturels.

- Utilisez des intervalles aléatoires pour éviter de créer un modèle prévisible.

import time

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')

# Random delay between requests

time.sleep(random.uniform(1, 3))En intégrant des proxies et en simulant le comportement humain, vous pouvez améliorer considérablement l'efficacité et la longévité de votre scraper BrickSeek, en veillant à ce qu'il fonctionne sans problème et sans être détecté pendant de longues périodes.

Section 6 : Gestion et stockage des données

Une fois que vous avez réussi à extraire des données de BrickSeek, l'étape suivante consiste à gérer et à stocker ces données de manière efficace. Cette section vous guidera à travers les différentes méthodes de stockage de vos données récupérées et comment les nettoyer et les formater pour une analyse plus approfondie.

Stockage des données extraites

Options de stockage des données

En fonction du volume et de la complexité des données, plusieurs options s'offrent à vous pour stocker vos données extraites :

- Fichiers CSV :

- Simple et facile à utiliser pour les petits ensembles de données.

- Compatible avec la plupart des outils et logiciels d'analyse de données.

- Idéal pour une analyse et une visualisation rapides.

- Bases de données :

- Plus adapté aux grands ensembles de données et aux requêtes plus complexes.

- Les options comprennent SQLite pour le stockage local et MySQL ou PostgreSQL pour des solutions plus robustes et évolutives.

- Assure une meilleure intégrité des données et facilite l'accès à l'analyse.

- Stockage dans le nuage :

- Pour les projets de scraping à grande échelle qui nécessitent des solutions de stockage distribuées.

- Les options comprennent AWS S3, Google Cloud Storage ou Azure Blob Storage.

- Offre une grande disponibilité et une grande évolutivité.

Écriture de données dans des fichiers

Voici comment écrire vos données dans un fichier CSV ou une base de données :

Écriture dans un fichier CSV :

import csv

data = [

{'title': 'Deal 1', 'price': '$10'},

{'title': 'Deal 2', 'price': '$15'},

# Add more data as needed

]

with open('deals.csv', mode='w', newline='') as file:

writer = csv.DictWriter(file, fieldnames=['title', 'price'])

writer.writeheader()

for item in data:

writer.writerow(item)Écrire dans une base de données SQLite :

import sqlite3

# Connect to the SQLite database (or create it if it doesn't exist)

conn = sqlite3.connect('deals.db')

cursor = conn.cursor()

# Create a table

cursor.execute('''

CREATE TABLE IF NOT EXISTS deals (

id INTEGER PRIMARY KEY,

title TEXT,

price TEXT

)

''')

# Insert data into the table

data = [

('Deal 1', '$10'),

('Deal 2', '$15'),

# Add more data as needed

]

cursor.executemany('INSERT INTO deals (title, price) VALUES (?, ?)', data)

conn.commit()

# Close the connection

conn.close()Nettoyage et formatage des données

Les données brutes extraites de sites web doivent souvent être nettoyées et formatées avant d'être analysées. Voici quelques techniques de base pour préparer vos données.

Techniques de base de nettoyage des données

Suppression des doublons :

- Veillez à ce que chaque entrée de votre ensemble de données soit unique.

import pandas as pd

df = pd.read_csv('deals.csv')

df.drop_duplicates(inplace=True)

df.to_csv('deals_cleaned.csv', index=False)Traitement des valeurs manquantes :

- Complétez les valeurs manquantes ou supprimez les entrées comportant des données manquantes.

df = pd.read_csv('deals.csv')

df.dropna(inplace=True) # Remove rows with missing values

df.fillna('N/A', inplace=True) # Fill missing values with 'N/A'

df.to_csv('deals_cleaned.csv', index=False)Normalisation des formats de données :

- Assurer la cohérence des formats de données (par exemple, formats de prix, formats de dates).

df['price'] = df['price'].str.replace('$', '').astype(float)

df.to_csv('deals_cleaned.csv', index=False)Structurer les données pour l'analyse

Organiser les données en tableaux :

- Structurez vos données dans des tableaux avec des en-têtes clairs et des types de données cohérents.

- Pour les bases de données relationnelles, veiller à la normalisation et aux relations entre les tables.

Utilisation de cadres de données :

- Les DataFrames, comme celles fournies par Pandas en Python, offrent de puissants outils de manipulation et d'analyse des données.

import pandas as pd

df = pd.read_csv('deals_cleaned.csv')

# Perform analysis and manipulationsEn gérant et en stockant efficacement vos données récupérées, vous pouvez vous assurer qu'elles sont prêtes à être analysées et utilisées ultérieurement. Des pratiques appropriées de traitement des données vous feront gagner du temps et de l'énergie, rendant votre processus d'analyse des données plus fluide et plus efficace.

Section 7 : Analyse et utilisation des données

Une fois que vous avez réussi à récupérer et à stocker vos données à partir de BrickSeek, l'étape suivante consiste à les analyser pour en extraire des informations précieuses. Cette section vous guidera à travers les techniques d'analyse de données de base et avancées pour vous aider à tirer le meilleur parti de vos données collectées.

Analyse des données de base

Outils et techniques d'analyse des données scrapées

Excel/Google Sheets :

- Utilisation : Idéal pour une analyse rapide et simple des données.

- Techniques :

- Trier et filtrer les données.

- Utilisation de tableaux croisés dynamiques pour résumer et explorer les données.

- Appliquer des formules et des fonctions pour les calculs et les transformations.

Pandas (bibliothèque Python) :

- Utilisation : Outil puissant pour la manipulation et l'analyse des données.

- Techniques :

- Lecture de données dans des DataFrames pour une analyse structurée.

- Réalisation de statistiques descriptives (moyenne, médiane, écart-type).

- Regrouper et agréger des données pour trouver des modèles.

import pandas as pd

# Load data into a DataFrame

df = pd.read_csv('deals_cleaned.csv')

# Basic statistics

print(df.describe())

# Group by a specific column and aggregate

grouped = df.groupby('category').mean()

print(grouped)Outils de visualisation (Matplotlib, Seaborn, Tableau) :

- Utilisation : Visualiser les données pour identifier les tendances et les modèles.

- Techniques :

- Créer des graphiques linéaires, des diagrammes à barres, des histogrammes et des diagrammes de dispersion.

- Utilisation de cartes thermiques pour l'analyse des corrélations.

import matplotlib.pyplot as plt

import seaborn as sns

# Plot a histogram of prices

sns.histplot(df['price'], bins=20, kde=True)

plt.show()

# Create a bar chart

df['category'].value_counts().plot(kind='bar')

plt.show()Trouver des modèles et des idées

- Analyse des tendances :

- Recherchez les tendances dans le temps, telles que les fluctuations de prix, les remises saisonnières ou les changements dans les niveaux de stocks.

- Exemple : Identifier les périodes où les remises sont les plus élevées sur des catégories de produits spécifiques.

- Analyse comparative :

- Comparez les prix de différents détaillants pour trouver les meilleures offres.

- Exemple : Comparaison du prix moyen d'un produit sur différentes plateformes.

- Analyse de corrélation :

- Déterminer les relations entre différentes variables.

- Exemple : Corrélation entre les prix des produits et les niveaux de stocks pour comprendre la dynamique de l'offre et de la demande.

Analyse avancée

Utiliser l'apprentissage automatique pour obtenir des informations prédictives

Modélisation prédictive :

- Appliquer des algorithmes d'apprentissage automatique pour prédire les tendances futures sur la base de données historiques.

- Exemple : Prévoir les prix futurs des produits sur la base des données passées en utilisant des modèles de régression.

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

# Prepare data for modeling

X = df[['feature1', 'feature2']] # Replace with relevant features

y = df['price']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Train a regression model

model = LinearRegression()

model.fit(X_train, y_train)

# Make predictions

predictions = model.predict(X_test)Regroupement :

- Utiliser des algorithmes de regroupement pour segmenter les produits en catégories sur la base de similitudes.

- Exemple : Regroupement de produits par gamme de prix, catégorie et popularité afin d'identifier des groupes distincts.

from sklearn.cluster import KMeans

# Prepare data for clustering

features = df[['feature1', 'feature2']] # Replace with relevant features

# Perform K-means clustering

kmeans = KMeans(n_clusters=3, random_state=42)

df['cluster'] = kmeans.fit_predict(features)Intégration avec d'autres sources de données pour une analyse plus riche

- Combinaison d'ensembles de données :

- Intégrez les données de BrickSeek à d'autres sources de données telles que les données de vente, les commentaires des clients ou les prix des concurrents pour une analyse complète.

- Exemple : Combinaison des données de prix BrickSeek avec les données de performance des ventes pour analyser l'impact des stratégies de prix sur les ventes.

- API et bases de données :

- Utilisez les API pour obtenir des données supplémentaires ou vous connecter à des bases de données externes pour une analyse plus approfondie.

- Exemple : Utilisation d'API de commerce électronique pour obtenir des données en temps réel sur la disponibilité des produits et les commentaires.

- Visualisation des données Tableaux de bord :

- Créez des tableaux de bord interactifs à l'aide d'outils tels que Tableau, Power BI ou Plotly Dash pour visualiser les données intégrées et surveiller les indicateurs clés.

- Exemple : Création d'un tableau de bord en temps réel pour suivre l'évolution des prix, les variations de stocks et les prix pratiqués par les concurrents.

Ces techniques d'analyse de données de base et avancées peuvent révéler des informations précieuses à partir de vos données BrickSeek, vous permettant de prendre des décisions éclairées, d'optimiser vos stratégies et de garder une longueur d'avance sur le marché concurrentiel.

Section 8 : Dépannage et optimisation

La construction d'un scraper BrickSeek peut être gratifiante, mais comme toute tâche complexe, elle s'accompagne de ses propres défis. Cette section vous aidera à résoudre les problèmes courants et à optimiser votre scraper pour obtenir les meilleures performances, en vous assurant que vous tirez le meilleur parti de vos efforts d'extraction de données.

Problèmes courants et solutions

Traitement des erreurs et des problèmes courants

- Erreurs HTTP (404, 500, etc.) :

- Problème : Il se peut que vous rencontriez des erreurs HTTP pendant le scraping, telles que 404 (Not Found) ou 500 (Internal Server Error).

- Solution : Mettez en œuvre une gestion des erreurs dans votre scraper afin de gérer ces erreurs avec élégance. Utilisez des blocs "essayer-excepter" pour attraper les exceptions et réessayer la requête après un court délai.

import requests

from time import sleep

url = 'http://example.com'

for attempt in range(5):

try:

response = requests.get(url)

response.raise_for_status() # Raises an HTTPError for bad responses

break # Exit loop if request is successful

except requests.exceptions.RequestException as e:

print(f'Error: {e}, retrying...')

sleep(5)- CAPTCHA et mesures anti-bots :

- Problème : les sites web utilisent souvent des CAPTCHA et d'autres mécanismes anti-bots pour empêcher le scraping.

- Solution: Use IP rotation with proxies, and consider integrating CAPTCHA-solving services if necessary. Implement delays and random intervals between requests to mimic human behavior.

import random

from time import sleep

delay = random.uniform(2, 5) # Random delay between 2 and 5 seconds

sleep(delay)- Contenu rendu par JavaScript :

- Problème : Certains contenus de BrickSeek peuvent être rendus à l'aide de JavaScript, ce que les scrapers statiques comme BeautifulSoup ne peuvent pas gérer.

- Solution : Utilisez Selenium pour gérer le contenu rendu par JavaScript.

from selenium import webdriver

driver = webdriver.Chrome()

driver.get('http://example.com')

content = driver.page_source- Adresses IP bloquées :

- Problème : Votre adresse IP peut être bloquée en raison de demandes fréquentes.

- Solution: Use IPBurger proxies to rotate IP addresses and avoid detection.

proxy = "http://proxyserver:port"

proxies = {

"http": proxy,

"https": proxy,

}

response = requests.get(url, proxies=proxies)Optimiser la performance de votre scraper

- Extraction efficace des données :

- Minimisez les données que vous demandez en ciblant des éléments et attributs HTML spécifiques.

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

price = soup.find('span', {'class': 'price'}).text- Demandes simultanées :

- Utilisez des bibliothèques asynchrones comme aiohttp ou le multithreading pour effectuer des requêtes simultanées et accélérer l'extraction des données.

import asyncio

import aiohttp

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main(urls):

async with aiohttp.ClientSession() as session:

tasks = [fetch(session, url) for url in urls]

return await asyncio.gather(*tasks)

urls = ['http://example.com/page1', 'http://example.com/page2']

loop = asyncio.get_event_loop()

pages = loop.run_until_complete(main(urls))- Mise en cache et étranglement :

- Mettez en place un système de cache pour éviter les demandes redondantes pour les mêmes données et limitez les demandes pour éviter la surcharge du serveur.

from cachetools import TTLCache

cache = TTLCache(maxsize=100, ttl=300)

def get_page(url):

if url in cache:

return cache[url]

response = requests.get(url)

cache[url] = response.text

return response.textTrucs et astuces avancés

Conseils d'experts pour tirer le meilleur parti de votre grattoir BrickSeek

- Agents utilisateurs dynamiques :

- Faites tourner les agents utilisateurs pour simuler différents navigateurs et réduire la probabilité d'être bloqué.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_11_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36',

# Add more user agents

]

headers = {'User-Agent': random.choice(user_agents)}

response = requests.get(url, headers=headers)- Persistance de la session :

- Utilisez des objets de session pour conserver les cookies et les en-têtes sur plusieurs requêtes, ce qui peut aider à maintenir les sessions de connexion et à réduire la détection.

session = requests.Session()

session.headers.update({'User-Agent': random.choice(user_agents)})

response = session.get(url)Stratégies d'amélioration continue

- Entretien régulier :

- Mettez régulièrement à jour votre scraper pour l'adapter aux modifications de la structure du site Web de BrickSeek. Une surveillance automatisée peut vous avertir des mises à jour nécessaires.

import requests

def monitor_changes(url, current_structure):

response = requests.get(url)

new_structure = response.text

if new_structure != current_structure:

print("Website structure has changed!")

# Update scraper logic here- Boucle de rétroaction :

- Mettez en place une boucle de rétroaction pour tirer des leçons des erreurs et des mesures de performance, en améliorant continuellement votre scraper pour plus d'efficacité et de précision.

import logging

logging.basicConfig(filename='scraper.log', level=logging.INFO)

def log_error(error):

logging.error(f"Error occurred: {error}")

try:

response = requests.get(url)

response.raise_for_status()

except requests.exceptions.RequestException as e:

log_error(e)Le respect de ces techniques de dépannage et d'optimisation garantit le bon fonctionnement, l'efficacité et l'efficience de votre scraper BrickSeek, qui fournit des données précieuses pour vos différents besoins.

Conclusion

Récapitulation des points clés

Construire un scraper BrickSeek peut ouvrir un monde d'opportunités pour le suivi des prix, la recherche de bonnes affaires et la gestion de l'inventaire. Tout au long de ce guide, nous avons couvert :

- Comprendre BrickSeek : De son histoire et de son développement à ses principales caractéristiques et à ses cas d'utilisation.

- Les bases du Web Scraping : Définition du web scraping, ses avantages et ses défis, et l'importance des considérations éthiques.

- Pour commencer : Outils, technologies et mise en place de votre environnement pour le web scraping.

- Construire votre scraper : Guide étape par étape pour écrire un scraper de base, gérer le contenu dynamique et extraire des données pertinentes.

- Améliorer votre scraper : Mettre en place desproxys, éviter les interdictions et imiter le comportement humain pour garantir un fonctionnement sans heurts.

- Gestion des données : Stockage, nettoyage et formatage des données récupérées en vue de leur analyse.

- Analyse et utilisation des données : Outils et techniques permettant d'intégrer des analyses de données de base et avancées à d'autres sources de données.

- Dépannage et optimisation : Gestion des problèmes courants, optimisation des performances et conseils avancés pour améliorer votre scraper.

Tendances futures

La technologie évolue, tout comme le paysage du web scraping et de l'analyse de données. Voici quelques tendances à surveiller :

- Technologies émergentes dans le domaine du décryptage de sites web : L'utilisation de l'IA et de l'apprentissage automatique pour créer des scrapeurs plus sophistiqués et plus efficaces, capables de s'adapter à l'évolution des structures des sites web et d'extraire des données plus riches.

- L'avenir du suivi des prix et de la gestion des stocks : Des outils et des plateformes plus avancés verront le jour, fournissant des données et des informations en temps réel pour des stratégies de prix dynamiques, une meilleure gestion des stocks et une expérience client améliorée.

Améliorer votre Web Scraping avec IPBurger

La mise en œuvre de proxys est cruciale dans la construction d'un scraper web efficace et fiable. Les proxys vous aident à éviter les interdictions d'IP, à distribuer les requêtes et à maintenir l'anonymat lors de la collecte de données. IPBurger propose une gamme de services de proxy de haute qualité, y compris des proxys résidentiels, mobiles et de centre de données, conçus pour répondre aux besoins des web scrapers.

- Sécurité et anonymat : les proxies d'IPBurger garantissent que vos activités de scraping restent anonymes et sécurisées, protégeant ainsi vos données contre le suivi ou l'interception.

- Avoiding Bans: By rotating IP addresses and mimicking human behavior, IPBurger’s proxies help you avoid detection and bans, ensuring uninterrupted scraping.

- Portée mondiale : Accédez à des données provenant de différents lieux géographiques grâce au réseau mondial de proxy d'IPBurger, ce qui vous permet d'améliorer votre capacité à effectuer des recherches et des analyses localisées.

Maintenant que vous avez compris la construction d'un scraper BrickSeek, il est temps de mettre en œuvre vos connaissances. Commencez votre projet de scraping dès aujourd'hui et explorez les avantages de l'automatisation du suivi des prix et de la gestion des stocks. N'oubliez pas d'utiliser les services proxy d'IPBurger pour améliorer vos efforts de scraping et garantir une collecte de données fiable et sécurisée.

Nous vous encourageons à partager vos expériences, vos défis et vos conseils dans la section des commentaires. Vos idées peuvent aider les autres membres de la communauté et contribuer à l'amélioration continue des techniques de web scraping.

Bon scraping !