Hãy nói về BrickSeek Scraper.

Bạn có thể đã tình cờ bắt gặp viên ngọc này nếu bạn đã từng săn lùng một giao dịch trực tuyến. BrickSeek giống như thám tử thỏa thuận cá nhân của bạn, lùng sục trên web để tìm giá sản phẩm tốt nhất trên các nhà bán lẻ khác nhau. Ban đầu được thiết kế để giúp người mua sắm tìm thấy giá tốt nhất cho các mặt hàng tại các cửa hàng địa phương, nó đã phát triển thành một công cụ mạnh mẽ cho bất kỳ ai muốn tiết kiệm một hoặc hai đô la — hoặc nhiều hơn.

Điều kỳ diệu của BrickSeek nằm ở khả năng theo dõi giá cả và hàng tồn kho theo thời gian thực. Cho dù bạn là một thợ săn giá hời, một đại lý bán lẻ đang tìm cách tối ưu hóa khoảng không quảng cáo hay một người yêu thích một thỏa thuận tốt, BrickSeek có một cái gì đó để cung cấp. Hãy tưởng tượng bạn biết chính xác nơi chiếc TV giảm giá khó nắm bắt đó có trong kho hoặc phát hiện ra rằng đồ chơi mà con bạn đã xin giảm một nửa tại một cửa hàng chỉ cách đó vài dặm. Đó là sức mạnh của việc theo dõi giá và quản lý hàng tồn kho.

Giới thiệu về Web Scraping

Bây giờ, hãy xoay quanh việc quét web. Nghe có vẻ công nghệ và đại loại là như vậy, nhưng đừng để điều đó làm bạn sợ. Về cốt lõi, web scraping là tự động hóa quá trình thu thập dữ liệu từ các trang web. Thay vì kiểm tra thủ công hàng tá trang web để giảm giá hoặc cập nhật chứng khoán, một trình quét web thực hiện công việc nặng nhọc cho bạn, kéo dữ liệu vào một định dạng gọn gàng, có thể sử dụng được.

Hãy nghĩ về nó như có một trợ lý siêu siêng năng, người không bao giờ ngủ, liên tục kiểm tra các bản cập nhật và trả lại thông tin bạn cần. Web scraping nhằm mục đích thu thập dữ liệu nhanh hơn, hiệu quả hơn và ít tẻ nhạt hơn.

Nhưng với sức mạnh lớn đi kèm với trách nhiệm lớn. Có những cân nhắc về đạo đức cần ghi nhớ. Không phải mọi trang web đều muốn dữ liệu của mình bị thu thập và một số trang web có điều khoản dịch vụ cấm rõ ràng. Ngoài ra còn có khía cạnh pháp lý - cạo sai cách có thể khiến bạn rơi vào nước nóng. Vì vậy, điều cần thiết là phải biết các quy tắc và chơi công bằng. Ethical scraping có nghĩa là tôn trọng các chính sách của trang web, không làm quá tải các máy chủ với quá nhiều yêu cầu và quan trọng nhất là không sử dụng dữ liệu cho các mục đích bất chính.

Vì vậy, cho dù bạn là một mọt sách dữ liệu, một người mua sắm hiểu biết hay chỉ là một người thích đi trước đường cong, hiểu được thông tin chi tiết về BrickSeek và quét web có thể mở ra một thế giới khả năng. Và, như chúng ta sẽ thấy, nó không chỉ là về việc tiết kiệm tiền — đó là về việc thông minh hơn với thời gian và nguồn lực của bạn.

Phần 1: Hiểu về BrickSeek

BrickSeek là gì?

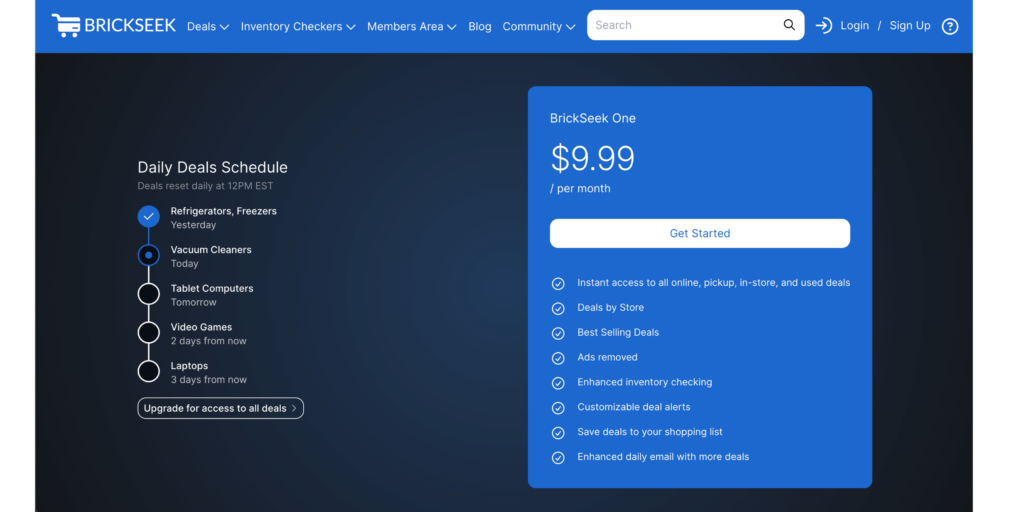

BrickSeek là một công cụ theo dõi giá và kiểm tra hàng tồn kho đã tạo nên tên tuổi trong số những người săn hàng giá rẻ và những người mua sắm hiểu biết. Ra mắt với ý tưởng giúp mọi người tìm thấy các giao dịch tốt nhất trong các cửa hàng địa phương, nó đã phát triển thành một nền tảng mạnh mẽ cung cấp nhiều tính năng phục vụ cho nhiều đối tượng.

Lịch sử hình thành và phát triển:

BrickSeek bắt đầu như một công cụ theo dõi hàng tồn kho đơn giản cho Walmart và kể từ đó đã mở rộng để bao gồm các nhà bán lẻ lớn như Target, Lowe's, Office Depot, v.v. Sự phát triển của nó đã được thúc đẩy bởi nhu cầu ngày càng tăng của người tiêu dùng để đưa ra quyết định mua hàng sáng suốt mà không gặp rắc rối khi truy cập nhiều cửa hàng hoặc trang web. Ngày nay, BrickSeek tự hào có giao diện thân thiện với người dùng và phụ trợ mạnh mẽ thu thập và cập nhật dữ liệu trong thời gian thực.

Các tính năng và lợi ích chính:

- Thông báo giá: Người dùng có thể đặt cảnh báo cho các sản phẩm cụ thể, đảm bảo họ không bao giờ bỏ lỡ việc giảm giá hoặc thông báo trở lại trong kho.

- Theo dõi hàng tồn kho: Cập nhật theo thời gian thực về tình trạng sẵn có của sản phẩm trên nhiều nhà bán lẻ.

- Công cụ tìm giao dịch: Danh sách tuyển chọn các giao dịch thịnh hành và các mặt hàng giải phóng mặt bằng.

- Nguồn cấp dữ liệu Markdown địa phương: Thông tin về giảm giá cửa hàng địa phương và các mặt hàng thông quan.

- Giao dịch trực tuyến: Một phần dành riêng cho các giao dịch và giảm giá độc quyền trực tuyến.

Các tính năng này giúp người dùng tiết kiệm tiền bạc và thời gian bằng cách hợp nhất thông tin mà nếu không sẽ yêu cầu hàng giờ tìm kiếm thủ công.

Trường hợp sử dụng cho BrickSeek

Tìm kiếm các ưu đãi và giảm giá: Một trong những ứng dụng chính của BrickSeek là tìm các giao dịch và giảm giá tốt nhất hiện có. Cho dù đó là một thiết bị công nghệ mới nóng, nhu yếu phẩm gia đình hay đồ chơi cho trẻ em, BrickSeek có thể giúp bạn xác định giá trực tuyến và tại cửa hàng tốt nhất. Với cảnh báo giá và các tính năng tìm kiếm giao dịch, bạn có thể dẫn đầu các chương trình giảm giá và khuyến mãi mà không cần liên tục kiểm tra nhiều trang web.

Theo dõi hàng tồn kho cho các đại lý: Giữ hàng tồn kho trên các cửa hàng khác nhau có thể là một cơn ác mộng hậu cần cho các đại lý. BrickSeek đơn giản hóa quá trình này bằng cách cung cấp dữ liệu hàng tồn kho theo thời gian thực. Điều này đặc biệt hữu ích cho những người mua sản phẩm với số lượng lớn để bán lại với lợi nhuận. Biết ở đâu và khi nào sản phẩm có sẵn cho phép các đại lý lập kế hoạch mua hàng hiệu quả hơn và tránh hết hàng.

So sánh giá cho những người mua sắm hiểu biết: Đối với những người muốn đảm bảo rằng họ đang nhận được lợi nhuận tốt nhất cho đồng tiền của họ, tính năng so sánh giá của BrickSeek là vô giá. Bằng cách so sánh giá giữa nhiều nhà bán lẻ, người mua sắm có thể đảm bảo họ không trả quá nhiều. Điều này đặc biệt hữu ích trong các sự kiện mua sắm lớn như Thứ Sáu Đen, Thứ Hai Điện Tử hoặc bán hàng tựu trường khi giá cả biến động nhanh chóng.

BrickSeek là một công cụ đa năng phục vụ cho các nhu cầu khác nhau — từ thợ săn giao dịch thông thường đến các đại lý chuyên nghiệp. Khả năng cung cấp dữ liệu chính xác, thời gian thực làm cho nó trở thành một nguồn tài nguyên thiết yếu cho bất kỳ ai muốn tiết kiệm tiền bạc và thời gian.

Phần 2: Khái niệm cơ bản về Web Scraping

Web Scraping là gì?

Web scraping là quá trình tự động trích xuất dữ liệu từ các trang web. Kỹ thuật này thường được sử dụng để thu thập một lượng lớn dữ liệu sẽ tốn thời gian hoặc khó thu thập thủ công. Sử dụng phần mềm hoặc tập lệnh, quét web có thể tự động truy xuất thông tin, giúp thu thập và phân tích dữ liệu ở quy mô lớn.

Định nghĩa và các ứng dụng phổ biến

Web scraping liên quan đến việc sử dụng các bot tự động để truy cập các trang web, phân tích cú pháp HTML và trích xuất thông tin hữu ích. Điều này có thể bao gồm giá sản phẩm, tình trạng còn hàng, đánh giá của khách hàng và hơn thế nữa. Dữ liệu được trích xuất sau đó có thể được lưu trữ và phân tích cho các mục đích khác nhau.

Các ứng dụng phổ biến của web scraping bao gồm

- Giám sát giá: Theo dõi giá trên nhiều trang web để tìm các giao dịch tốt nhất.

- Nghiên cứu thị trường: Thu thập dữ liệu về sản phẩm, giá cả và phản hồi của khách hàng của đối thủ cạnh tranh.

- Tổng hợp nội dung: Thu thập các bài báo, blog hoặc tin tức từ nhiều nguồn khác nhau để có cái nhìn tổng quan toàn diện.

- Khai thác dữ liệu: Trích xuất các bộ dữ liệu lớn để phân tích trong lĩnh vực tài chính, y tế và thương mại điện tử.

Lợi ích và thách thức

- Lợi ích: Web scraping có thể tiết kiệm thời gian và tài nguyên bằng cách tự động thu thập dữ liệu. Nó cung cấp các bộ dữ liệu cập nhật và toàn diện, cho phép ra quyết định và lập kế hoạch chiến lược tốt hơn. Đối với các doanh nghiệp, điều này có nghĩa là duy trì tính cạnh tranh bằng cách theo kịp xu hướng thị trường và hành vi của người tiêu dùng.

- Thách thức: Mặc dù có những ưu điểm của nó, web scraping có những thách thức về kỹ thuật và đạo đức. Các trang web thường thay đổi cấu trúc của chúng, điều này có thể phá vỡ các tập lệnh cạo. Ngoài ra, việc xử lý một lượng lớn dữ liệu đòi hỏi cơ sở hạ tầng và quản lý mạnh mẽ. Hơn nữa, đảm bảo rằng các hoạt động cạo không vi phạm các điều khoản dịch vụ hoặc tiêu chuẩn đạo đức là rất quan trọng.

Cân nhắc pháp lý và đạo đức

Khi nói đến web scraping, hiểu được bối cảnh pháp lý và đạo đức là điều cần thiết. Mặc dù việc tự cạo không phải là bất hợp pháp, nhưng cách nó được thực hiện có thể gây ra các vấn đề pháp lý.

Hiểu Điều khoản Dịch vụ

Hầu hết các trang web đều có điều khoản dịch vụ (ToS) phác thảo các chính sách sử dụng được chấp nhận. Việc cạo một trang web vi phạm ToS của nó có thể dẫn đến hành động pháp lý, đặc biệt nếu hoạt động cạo được phát hiện và gây hại cho hoạt động của trang web. Do đó, việc xem xét và tuân thủ ToS của bất kỳ trang web nào bạn định cạo là rất quan trọng.

Thực hành cạo có đạo đức

Cạo đạo đức bao gồm một số thực tiễn tốt nhất để đảm bảo rằng quy trình này được tôn trọng và hợp pháp:

- Tôn trọng Robots.txt: Tệp này trên các trang web cho biết phần nào của trang web có thể và không thể được cạo. Tuân thủ các hướng dẫn này là một thực hành đạo đức cơ bản.

- Tránh quá tải: Việc cạo có thể làm căng thẳng máy chủ của trang web. Giới hạn tần suất và khối lượng yêu cầu giúp tránh quá tải trang web.

- Ghi công và sử dụng: Nếu dữ liệu được thu thập để xuất bản hoặc phân tích, việc cung cấp tín dụng thích hợp cho nguồn là điều cần thiết. Ngoài ra, điều quan trọng là sử dụng dữ liệu để không gây hại cho trang web gốc hoặc người dùng của nó.

- Bảo vệ dữ liệu cá nhân: Việc thu thập dữ liệu cá nhân nên tránh thu thập dữ liệu cá nhân trừ khi được cấp phép rõ ràng và tuân thủ các quy định về quyền riêng tư dữ liệu.

Tóm lại, trong khi quét web cung cấp khả năng thu thập và phân tích dữ liệu mạnh mẽ, nó phải được tiến hành có trách nhiệm. Hiểu được ý nghĩa pháp lý và tuân thủ các tiêu chuẩn đạo đức là chìa khóa để tận dụng công nghệ này một cách hiệu quả và bền vững.

Phần 3: Bắt đầu với BrickSeek Scraping

Công cụ và công nghệ

Bắt tay vào hành trình cạo BrickSeek đòi hỏi các công cụ và công nghệ phù hợp. Dưới đây là tóm tắt các ngôn ngữ lập trình và thư viện thiết yếu sẽ giúp bạn thành công.

Ngôn ngữ lập trình được đề xuất

- Trăn: Được coi là ngôn ngữ đi đến để quét web do tính đơn giản của nó và một loạt các thư viện có sẵn. Khả năng đọc và hỗ trợ cộng đồng của Python làm cho nó trở nên lý tưởng cho người mới bắt đầu và các nhà phát triển có kinh nghiệm.

Thư viện thiết yếu

- Súp đẹp: Một thư viện Python để phân tích cú pháp các tài liệu HTML và XML. Nó tạo ra một cây phân tích cú pháp cho các trang được phân tích cú pháp có thể được sử dụng để trích xuất dữ liệu dễ dàng.

- Phế vật: Một khung thu thập dữ liệu web mã nguồn mở và cộng tác cho Python. Scrapy mạnh mẽ và linh hoạt, cho phép bạn cạo và trích xuất dữ liệu một cách hiệu quả.

- Selen: Một thư viện kiểm tra web tự động hóa các trình duyệt. Nó đặc biệt hữu ích để quét nội dung động được hiển thị bởi JavaScript, điều mà các thư viện cạo truyền thống có thể bỏ lỡ.

Thiết lập môi trường của bạn

Trước khi bắt đầu cạo, bạn phải thiết lập môi trường của mình. Dưới đây là hướng dẫn từng bước để giúp bạn bắt đầu.

Cài đặt phần mềm và thư viện cần thiết

- Install Python: Ensure Python is installed on your system. You can download it from python.org.

- Thiết lập môi trường ảo: Đó là thực hành tốt để tạo ra một môi trường ảo cho dự án của bạn để quản lý các phụ thuộc. Bạn có thể làm điều này bằng cách sử dụng venv.

python -m venv brickseek_scraper

source brickseek_scraper/bin/activate # On Windows, use `brickseek_scraper\Scripts\activate`- Cài đặt thư viện: Với môi trường ảo của bạn được kích hoạt, hãy cài đặt các thư viện cần thiết bằng pip.

pip install beautifulsoup4 scrapy selenium requestsThiết lập cơ bản cho dự án BrickSeek Scraper

- Tạo thư mục dự án:

mkdir brickseek_scraper

cd brickseek_scraper- Khởi tạo một dự án scrapy: Nếu bạn đang sử dụng Scrapy, hãy khởi tạo một dự án mới.

scrapy startproject brickseek

cd brickseek- Thiết lập Selenium: Đối với Selenium, bạn sẽ cần tải xuống WebDriver thích hợp cho trình duyệt của mình (ví dụ: ChromeDriver cho Google Chrome).

# Example for installing ChromeDriver

wget https://chromedriver.storage.googleapis.com/91.0.4472.101/chromedriver_linux64.zip

unzip chromedriver_linux64.zip

mv chromedriver /usr/local/bin/- Nhện cạp cơ bản: Tạo một con nhện Scrapy đơn giản để bắt đầu cạo BrickSeek.

# brickseek/brickseek/spiders/brickseek_spider.py

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ["https://brickseek.com/"]

def parse(self, response):

self.log('Visited %s' % response.url)- Chạy spider của bạn: Thực hiện con nhện để xem mọi thứ đã được thiết lập chính xác chưa.

scrapy crawl brickseekBằng cách thiết lập môi trường của bạn với các công cụ và công nghệ này, bạn đã sẵn sàng để bắt đầu thu thập dữ liệu từ BrickSeek. Việc chuẩn bị này đảm bảo bạn có một nền tảng vững chắc để xây dựng các nhiệm vụ cạo phức tạp hơn và xử lý dữ liệu hiệu quả.

Phần 4: Xây dựng BrickSeek Scraper của bạn

Hướng dẫn từng bước về BrickSeek Scraper

Xây dựng một scraper BrickSeek bao gồm một số bước, từ xác định dữ liệu mục tiêu đến viết mã trích xuất thông tin này. Hãy chia nhỏ nó.

Xác định dữ liệu đích (URL, phần tử HTML):

- Bắt đầu bằng cách khám phá BrickSeek: Truy cập BrickSeek và điều hướng đến các trang bạn muốn cạo. Nhìn vào các mẫu URL, trang sản phẩm và cấu trúc của HTML.

- Sử dụng Công cụ dành cho nhà phát triển: Mở các công cụ dành cho nhà phát triển của trình duyệt (thường là với F12 hoặc nhấp chuột phải và chọn "Kiểm tra"). Kiểm tra các phần tử HTML chứa dữ liệu bạn quan tâm (như giá, trạng thái hàng tồn kho và chi tiết sản phẩm).

Viết một Scraper cơ bản với BeautifulSoup / Scrapy

- Sử dụng BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Define the URL of the page to scrape

url = 'https://brickseek.com/deal/'

# Send a GET request to the URL

response = requests.get(url)

# Parse the HTML content using BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

# Extract data (e.g., prices, inventory, product details)

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- Sử dụng Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Xử lý nội dung động

Đôi khi, nội dung bạn cần được tải động bằng JavaScript. Đây là cách xử lý nó.

Sử dụng Selenium cho nội dung được hiển thị bằng JavaScript:

- Thiết lập Selenium:

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from selenium.webdriver.chrome.options import Options

chrome_options = Options()

chrome_options.add_argument("--headless")

service = Service('path/to/chromedriver')

driver = webdriver.Chrome(service=service, options=chrome_options)

driver.get('https://brickseek.com/deal/')

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')

driver.quit()Kỹ thuật xử lý AJAX và các yếu tố động khác

Đợi các phần tử tải: Sử dụng chờ rõ ràng để đảm bảo rằng các phần tử đã được tải trước khi cố gắng trích xuất dữ liệu.

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

driver.get('https://brickseek.com/deal/')

WebDriverWait(driver, 10).until(

EC.presence_of_element_located((By.CLASS_NAME, 'item'))

)

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')Xử lý cuộn vô hạn: Đối với các trang có khả năng cuộn vô hạn, bạn có thể cần phải cuộn xuống để tải thêm nội dung.

import time

driver.get('https://brickseek.com/deal/')

last_height = driver.execute_script("return document.body.scrollHeight")

while True:

driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(2)

new_height = driver.execute_script("return document.body.scrollHeight")

if new_height == last_height:

break

last_height = new_height

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')Bằng cách làm theo các bước này, bạn có thể xây dựng một trình quét BrickSeek mạnh mẽ xử lý hiệu quả nội dung tĩnh và động và trích xuất dữ liệu có giá trị một cách liền mạch.

Phần 5: Tăng cường Scraper của bạn

Để cải thiện máy cạo BrickSeek của bạn, bạn phải kết hợp các kỹ thuật tiên tiến để đảm bảo hiệu quả và tuổi thọ của nó. Phần này bao gồm các proxy để che giấu danh tính của bạn và tránh các lệnh cấm và phương pháp bắt chước hành vi của con người để ở dưới radar.

Triển khai proxy

Tại sao nên sử dụng proxy?

Proxy rất cần thiết cho việc quét web, đặc biệt là khi nhắm mục tiêu các trang web với các biện pháp chống cạo nghiêm ngặt. Đây là lý do tại sao bạn nên cân nhắc sử dụng proxy:

- Anonymity: Proxies hide your IP address, making your requests appear from different locations.

- Tránh các lệnh cấm: Sử dụng nhiều proxy có thể phân phối các yêu cầu của bạn, giảm khả năng bị chặn vì lưu lượng truy cập quá mức.

- Truy cập nội dung bị giới hạn địa lý: Proxy có thể làm cho các yêu cầu của bạn xuất hiện như thể chúng đến từ một quốc gia cụ thể, cho phép bạn truy cập dữ liệu bị khóa theo khu vực.

Thiết lập proxy IPBurger cho trình cạp của bạn

Using IPBurger proxies is straightforward. Here’s how to integrate them into your BrickSeek scraper:

- Đăng ký IPBurger:

- Visit IPBurger’s website and sign up for a proxy plan that fits your needs.

- Lấy chi tiết proxy của bạn, bao gồm địa chỉ IP, cổng, tên người dùng và mật khẩu.

- Định cấu hình proxy trong mã của bạn:

Với các yêu cầu và BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Proxy details

proxies = {

'http': 'http://username:password@proxy_ip:proxy_port',

'https': 'https://username:password@proxy_ip:proxy_port'

}

url = 'https://brickseek.com/deal/'

response = requests.get(url, proxies=proxies)

soup = BeautifulSoup(response.text, 'html.parser')

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- Với Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def start_requests(self):

for url in self.start_urls:

yield scrapy.Request(url=url, callback=self.parse, meta={

'proxy': 'http://username:password@proxy_ip:proxy_port'

})

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Tránh các lệnh cấm và giới hạn tỷ lệ

Bạn phải thực hiện các kỹ thuật bắt chước hành vi duyệt web của con người để ngăn chặn trình cạp của bạn bị phát hiện và cấm.

Kỹ thuật bắt chước hành vi của con người

- Ngẫu nhiên hóa tác nhân người dùng:

- Xoay chuỗi tác nhân người dùng để làm cho các yêu cầu dường như đến từ các trình duyệt khác nhau.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (X11; Ubuntu; Linux x86_64; rv:89.0) Gecko/20100101 Firefox/89.0',

# Add more user agents as needed

]

headers = {

'User-Agent': random.choice(user_agents)

}response = requests.get(URL, headers=headers, proxy=proxy)

- Thực hiện sự chậm trễ và khoảng thời gian ngẫu nhiên:

- Giới thiệu độ trễ giữa các yêu cầu để bắt chước các mẫu duyệt web tự nhiên.

- Sử dụng các khoảng thời gian ngẫu nhiên để tránh tạo ra một mô hình có thể dự đoán được.

import time

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')

# Random delay between requests

time.sleep(random.uniform(1, 3))Bằng cách tích hợp proxy và mô phỏng hành vi của con người, bạn có thể nâng cao đáng kể hiệu quả và tuổi thọ của máy cạo BrickSeek của mình, đảm bảo nó chạy trơn tru và không bị phát hiện trong thời gian dài.

Phần 6: Quản lý và lưu trữ dữ liệu

Khi bạn đã thu thập thành công dữ liệu từ BrickSeek, bước quan trọng tiếp theo là quản lý và lưu trữ dữ liệu này một cách hiệu quả. Phần này sẽ hướng dẫn bạn qua các phương pháp khác nhau để lưu trữ dữ liệu cóp nhặt của bạn và cách làm sạch và định dạng dữ liệu đó để phân tích thêm.

Lưu trữ dữ liệu cóp nhặt

Tùy chọn lưu trữ dữ liệu

Tùy thuộc vào khối lượng và độ phức tạp của dữ liệu, bạn có một số tùy chọn để lưu trữ dữ liệu được thu thập của mình:

- Tệp CSV:

- Đơn giản và dễ sử dụng cho các bộ dữ liệu nhỏ hơn.

- Tương thích với hầu hết các công cụ và phần mềm phân tích dữ liệu.

- Lý tưởng để phân tích và trực quan hóa nhanh chóng.

- Cơ sở dữ liệu:

- Phù hợp hơn cho các bộ dữ liệu lớn hơn và các truy vấn phức tạp hơn.

- Các tùy chọn bao gồm SQLite để lưu trữ cục bộ và MySQL hoặc PostgreSQL cho các giải pháp mạnh mẽ, có thể mở rộng hơn.

- Cung cấp tính toàn vẹn dữ liệu tốt hơn và truy cập dễ dàng hơn để phân tích.

- Lưu trữ đám mây:

- Đối với các dự án cạo quy mô lớn yêu cầu các giải pháp lưu trữ phân tán.

- Các tùy chọn bao gồm AWS S3, Google Cloud Storage hoặc Azure Blob Storage.

- Cung cấp tính sẵn sàng và khả năng mở rộng cao.

Ghi dữ liệu vào tệp

Dưới đây là cách bạn có thể ghi dữ liệu đã thu thập vào tệp CSV hoặc cơ sở dữ liệu:

Ghi vào tệp CSV:

import csv

data = [

{'title': 'Deal 1', 'price': '$10'},

{'title': 'Deal 2', 'price': '$15'},

# Add more data as needed

]

with open('deals.csv', mode='w', newline='') as file:

writer = csv.DictWriter(file, fieldnames=['title', 'price'])

writer.writeheader()

for item in data:

writer.writerow(item)Ghi vào cơ sở dữ liệu SQLite:

import sqlite3

# Connect to the SQLite database (or create it if it doesn't exist)

conn = sqlite3.connect('deals.db')

cursor = conn.cursor()

# Create a table

cursor.execute('''

CREATE TABLE IF NOT EXISTS deals (

id INTEGER PRIMARY KEY,

title TEXT,

price TEXT

)

''')

# Insert data into the table

data = [

('Deal 1', '$10'),

('Deal 2', '$15'),

# Add more data as needed

]

cursor.executemany('INSERT INTO deals (title, price) VALUES (?, ?)', data)

conn.commit()

# Close the connection

conn.close()Làm sạch và định dạng dữ liệu

Dữ liệu thô được thu thập từ các trang web thường cần được làm sạch và định dạng trước khi được phân tích. Dưới đây là một số kỹ thuật cơ bản để chuẩn bị dữ liệu của bạn.

Kỹ thuật làm sạch dữ liệu cơ bản

Loại bỏ trùng lặp:

- Đảm bảo mỗi mục nhập trong tập dữ liệu của bạn là duy nhất.

import pandas as pd

df = pd.read_csv('deals.csv')

df.drop_duplicates(inplace=True)

df.to_csv('deals_cleaned.csv', index=False)Xử lý các giá trị bị thiếu:

- Điền các giá trị bị thiếu hoặc xóa các mục nhập có dữ liệu bị thiếu.

df = pd.read_csv('deals.csv')

df.dropna(inplace=True) # Remove rows with missing values

df.fillna('N/A', inplace=True) # Fill missing values with 'N/A'

df.to_csv('deals_cleaned.csv', index=False)Chuẩn hóa định dạng dữ liệu:

- Đảm bảo tính nhất quán trong các định dạng dữ liệu (ví dụ: định dạng giá, định dạng ngày).

df['price'] = df['price'].str.replace('$', '').astype(float)

df.to_csv('deals_cleaned.csv', index=False)Cấu trúc dữ liệu để phân tích

Tổ chức dữ liệu thành bảng:

- Cấu trúc dữ liệu của bạn thành các bảng với tiêu đề rõ ràng và kiểu dữ liệu nhất quán.

- Đối với cơ sở dữ liệu quan hệ, đảm bảo chuẩn hóa thích hợp và mối quan hệ giữa các bảng.

Sử dụng Khung dữ liệu:

- DataFrames, giống như những DataFrame được cung cấp bởi Pandas trong Python, cung cấp các công cụ phân tích và thao tác dữ liệu mạnh mẽ.

import pandas as pd

df = pd.read_csv('deals_cleaned.csv')

# Perform analysis and manipulationsBằng cách quản lý và lưu trữ hiệu quả dữ liệu được thu thập của bạn, bạn có thể đảm bảo rằng nó đã sẵn sàng để phân tích và sử dụng thêm. Thực hành xử lý dữ liệu phù hợp sẽ giúp bạn tiết kiệm thời gian và công sức, giúp quá trình phân tích dữ liệu của bạn mượt mà và hiệu quả hơn.

Phần 7: Phân tích và sử dụng dữ liệu của bạn

Khi bạn đã thu thập và lưu trữ thành công dữ liệu của mình từ BrickSeek, bước tiếp theo là phân tích nó để trích xuất những hiểu biết có giá trị. Phần này sẽ hướng dẫn bạn các kỹ thuật phân tích dữ liệu cơ bản và nâng cao để giúp bạn tận dụng tối đa dữ liệu thu thập được của mình.

Phân tích dữ liệu cơ bản

Các công cụ và kỹ thuật để phân tích dữ liệu cóp nhặt

Excel / Google Trang tính:

- Cách sử dụng: Lý tưởng để phân tích dữ liệu nhanh chóng và đơn giản.

- Kỹ thuật:

- Sắp xếp và lọc dữ liệu.

- Sử dụng bảng tổng hợp để tóm tắt và khám phá dữ liệu.

- Áp dụng các công thức và hàm để tính toán và biến đổi.

Pandas (Thư viện Python):

- Cách sử dụng: Công cụ mạnh mẽ để thao tác và phân tích dữ liệu.

- Kỹ thuật:

- Đọc dữ liệu vào DataFrames để phân tích có cấu trúc.

- Thực hiện thống kê mô tả (trung bình, trung vị, độ lệch chuẩn).

- Nhóm và tổng hợp dữ liệu để tìm mẫu.

import pandas as pd

# Load data into a DataFrame

df = pd.read_csv('deals_cleaned.csv')

# Basic statistics

print(df.describe())

# Group by a specific column and aggregate

grouped = df.groupby('category').mean()

print(grouped)Công cụ trực quan hóa (Matplotlib, Seaborn, Tableau):

- Cách sử dụng: Trực quan hóa dữ liệu để xác định xu hướng và mẫu.

- Kỹ thuật:

- Tạo biểu đồ đường, biểu đồ thanh, biểu đồ tần suất và biểu đồ phân tán.

- Sử dụng bản đồ nhiệt để phân tích tương quan.

import matplotlib.pyplot as plt

import seaborn as sns

# Plot a histogram of prices

sns.histplot(df['price'], bins=20, kde=True)

plt.show()

# Create a bar chart

df['category'].value_counts().plot(kind='bar')

plt.show()Tìm mẫu và thông tin chi tiết

- Phân tích xu hướng:

- Tìm kiếm xu hướng theo thời gian, chẳng hạn như biến động giá, chiết khấu theo mùa hoặc thay đổi mức tồn kho.

- Ví dụ: Xác định khoảng thời gian có mức chiết khấu cao nhất đối với các danh mục sản phẩm cụ thể.

- Phân tích so sánh:

- So sánh giá giữa các nhà bán lẻ khác nhau để tìm ra các giao dịch tốt nhất.

- Ví dụ: So sánh giá trung bình của một sản phẩm trên các nền tảng khác nhau.

- Phân tích tương quan:

- Xác định mối quan hệ giữa các biến khác nhau.

- Ví dụ: Tương quan giá sản phẩm với mức tồn kho để hiểu động lực cung-cầu.

Phân tích nâng cao

Sử dụng máy học để có thông tin chi tiết dự đoán

Mô hình dự đoán:

- Áp dụng các thuật toán học máy để dự đoán xu hướng trong tương lai dựa trên dữ liệu lịch sử.

- Ví dụ: Dự đoán giá tương lai của sản phẩm dựa trên dữ liệu trong quá khứ bằng cách sử dụng các mô hình hồi quy.

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

# Prepare data for modeling

X = df[['feature1', 'feature2']] # Replace with relevant features

y = df['price']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Train a regression model

model = LinearRegression()

model.fit(X_train, y_train)

# Make predictions

predictions = model.predict(X_test)Clustering:

- Sử dụng thuật toán phân cụm để phân đoạn sản phẩm thành các danh mục dựa trên sự tương đồng.

- Ví dụ: Nhóm các sản phẩm theo phạm vi giá, danh mục và mức độ phổ biến để xác định các cụm riêng biệt.

from sklearn.cluster import KMeans

# Prepare data for clustering

features = df[['feature1', 'feature2']] # Replace with relevant features

# Perform K-means clustering

kmeans = KMeans(n_clusters=3, random_state=42)

df['cluster'] = kmeans.fit_predict(features)Tích hợp với các nguồn dữ liệu khác để phân tích phong phú hơn

- Kết hợp các tập dữ liệu:

- Tích hợp dữ liệu BrickSeek với các nguồn dữ liệu khác như dữ liệu bán hàng, đánh giá của khách hàng hoặc giá của đối thủ cạnh tranh để phân tích toàn diện.

- Ví dụ: Kết hợp dữ liệu giá BrickSeek với dữ liệu hiệu suất bán hàng để phân tích tác động của chiến lược giá đối với doanh số bán hàng.

- API và cơ sở dữ liệu:

- Sử dụng API để tìm nạp dữ liệu bổ sung hoặc kết nối với cơ sở dữ liệu bên ngoài để phân tích sâu rộng hơn.

- Ví dụ: Sử dụng API thương mại điện tử để tìm nạp dữ liệu theo thời gian thực về tình trạng còn hàng và đánh giá của sản phẩm.

- Bảng thông tin trực quan hóa dữ liệu:

- Tạo bảng thông tin tương tác bằng các công cụ như Tableau, Power BI hoặc Plotly Dash để trực quan hóa dữ liệu tích hợp và giám sát các chỉ số chính.

- Ví dụ: Xây dựng bảng điều khiển thời gian thực để theo dõi xu hướng giá, thay đổi khoảng không quảng cáo và giá của đối thủ cạnh tranh.

Các kỹ thuật phân tích dữ liệu cơ bản và nâng cao này có thể khám phá những hiểu biết có giá trị từ dữ liệu BrickSeek của bạn, cho phép bạn đưa ra quyết định sáng suốt, tối ưu hóa chiến lược của mình và dẫn đầu trong thị trường cạnh tranh.

Phần 8: Khắc phục sự cố và tối ưu hóa

Xây dựng một scraper BrickSeek có thể là phần thưởng, nhưng giống như bất kỳ nhiệm vụ phức tạp nào, nó đi kèm với những thách thức riêng. Phần này sẽ giúp bạn khắc phục các sự cố thường gặp và tối ưu hóa trình cạp của bạn để có hiệu suất tốt nhất, đảm bảo rằng bạn tận dụng tối đa các nỗ lực trích xuất dữ liệu của mình.

Các vấn đề thường gặp và giải pháp

Xử lý các lỗi và sự cố thường gặp

- Lỗi HTTP (404, 500, v.v.):

- Vấn đề: Bạn có thể gặp lỗi HTTP trong quá trình cạo, chẳng hạn như 404 (Không tìm thấy) hoặc 500 (Lỗi máy chủ nội bộ).

- Giải pháp: Thực hiện xử lý lỗi trong trình cạp của bạn để quản lý các lỗi này một cách duyên dáng. Sử dụng các khối thử ngoại trừ để bắt các ngoại lệ và thử lại yêu cầu sau một thời gian trì hoãn ngắn.

import requests

from time import sleep

url = 'http://example.com'

for attempt in range(5):

try:

response = requests.get(url)

response.raise_for_status() # Raises an HTTPError for bad responses

break # Exit loop if request is successful

except requests.exceptions.RequestException as e:

print(f'Error: {e}, retrying...')

sleep(5)- Các biện pháp CAPTCHA và Anti-Bot:

- Vấn đề: Các trang web thường sử dụng CAPTCHA và các cơ chế chống bot khác để ngăn chặn việc cạo.

- Solution: Use IP rotation with proxies, and consider integrating CAPTCHA-solving services if necessary. Implement delays and random intervals between requests to mimic human behavior.

import random

from time import sleep

delay = random.uniform(2, 5) # Random delay between 2 and 5 seconds

sleep(delay)- Nội dung được hiển thị bằng JavaScript:

- Vấn đề: Một số nội dung trên BrickSeek có thể được hiển thị bằng JavaScript, mà các trình quét tĩnh như BeautifulSoup không thể xử lý.

- Giải pháp: Sử dụng Selenium để xử lý nội dung được hiển thị bằng JavaScript.

from selenium import webdriver

driver = webdriver.Chrome()

driver.get('http://example.com')

content = driver.page_source- Địa chỉ IP bị chặn:

- Vấn đề: Địa chỉ IP của bạn có thể bị chặn do yêu cầu thường xuyên.

- Solution: Use IPBurger proxies to rotate IP addresses and avoid detection.

proxy = "http://proxyserver:port"

proxies = {

"http": proxy,

"https": proxy,

}

response = requests.get(url, proxies=proxies)Tối ưu hóa Scraper của bạn cho hiệu suất

- Trích xuất dữ liệu hiệu quả:

- Giảm thiểu dữ liệu bạn yêu cầu bằng cách nhắm mục tiêu các phần tử và thuộc tính HTML cụ thể.

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

price = soup.find('span', {'class': 'price'}).text- Yêu cầu đồng thời:

- Sử dụng các thư viện không đồng bộ như aiohttp hoặc đa luồng để thực hiện các yêu cầu đồng thời và tăng tốc độ trích xuất dữ liệu.

import asyncio

import aiohttp

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main(urls):

async with aiohttp.ClientSession() as session:

tasks = [fetch(session, url) for url in urls]

return await asyncio.gather(*tasks)

urls = ['http://example.com/page1', 'http://example.com/page2']

loop = asyncio.get_event_loop()

pages = loop.run_until_complete(main(urls))- Bộ nhớ đệm và điều tiết:

- Triển khai bộ nhớ đệm để tránh các yêu cầu dư thừa cho cùng một dữ liệu và điều tiết các yêu cầu để ngăn chặn quá tải máy chủ.

from cachetools import TTLCache

cache = TTLCache(maxsize=100, ttl=300)

def get_page(url):

if url in cache:

return cache[url]

response = requests.get(url)

cache[url] = response.text

return response.textMẹo và thủ thuật nâng cao

Lời khuyên của chuyên gia để tận dụng tối đa BrickSeek Scraper của bạn

- Tác nhân người dùng động:

- Xoay tác nhân người dùng để mô phỏng các trình duyệt khác nhau và giảm khả năng bị chặn.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_11_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36',

# Add more user agents

]

headers = {'User-Agent': random.choice(user_agents)}

response = requests.get(url, headers=headers)- Kiên trì phiên:

- Sử dụng các đối tượng phiên để duy trì cookie và tiêu đề trên nhiều yêu cầu, điều này có thể giúp duy trì phiên đăng nhập và giảm phát hiện.

session = requests.Session()

session.headers.update({'User-Agent': random.choice(user_agents)})

response = session.get(url)Chiến lược cải tiến liên tục

- Bảo trì thường xuyên:

- Thường xuyên cập nhật scraper của bạn để thích ứng với những thay đổi trong cấu trúc trang web của BrickSeek. Giám sát tự động có thể cảnh báo bạn về các cập nhật cần thiết.

import requests

def monitor_changes(url, current_structure):

response = requests.get(url)

new_structure = response.text

if new_structure != current_structure:

print("Website structure has changed!")

# Update scraper logic here- Vòng phản hồi:

- Triển khai vòng phản hồi để học hỏi từ các lỗi và số liệu hiệu suất, liên tục tinh chỉnh trình cạp của bạn để có hiệu quả và độ chính xác tốt hơn.

import logging

logging.basicConfig(filename='scraper.log', level=logging.INFO)

def log_error(error):

logging.error(f"Error occurred: {error}")

try:

response = requests.get(url)

response.raise_for_status()

except requests.exceptions.RequestException as e:

log_error(e)Thực hiện theo các kỹ thuật khắc phục sự cố và tối ưu hóa này đảm bảo rằng máy cạo BrickSeek của bạn hoạt động trơn tru, hiệu quả và hiệu quả, cung cấp dữ liệu có giá trị cho các nhu cầu khác nhau của bạn.

Kết thúc

Tóm tắt các điểm chính

Xây dựng một công cụ cạo BrickSeek có thể mở ra một thế giới cơ hội để theo dõi giá, săn giao dịch và quản lý hàng tồn kho. Trong suốt hướng dẫn này, chúng tôi đã đề cập đến:

- Hiểu về BrickSeek: Từ lịch sử và sự phát triển của nó đến các tính năng chính và trường hợp sử dụng của nó.

- Khái niệm cơ bản về Web Scraping: Xác định web scraping, lợi ích và thách thức của nó, và tầm quan trọng của các cân nhắc đạo đức.

- Bắt đầu: Các công cụ, công nghệ và thiết lập môi trường của bạn để quét web.

- Xây dựng Scraper của bạn: Hướng dẫn từng bước để viết một scraper cơ bản, xử lý nội dung động và trích xuất dữ liệu có liên quan.

- Tăng cường Scraper của bạn: Tôihoàn thiện proxy, tránh lệnh cấm và bắt chước hành vi của con người để đảm bảo hoạt động trơn tru.

- Quản lý dữ liệu: Lưu trữ, làm sạch và định dạng dữ liệu cóp nhặt của bạn để phân tích.

- Phân tích và sử dụng dữ liệu: Các công cụ và kỹ thuật để tích hợp phân tích dữ liệu cơ bản và nâng cao với các nguồn dữ liệu khác.

- Khắc phục sự cố và tối ưu hóa: Xử lý các sự cố thường gặp, tối ưu hóa hiệu suất và các mẹo nâng cao để cải thiện trình cạp của bạn.

Xu hướng tương lai

Khi công nghệ phát triển, bối cảnh của việc quét web và phân tích dữ liệu cũng vậy. Dưới đây là một số xu hướng cần chú ý:

- Các công nghệ mới nổi trong Web Scraping: Việc sử dụng AI và học máy để tạo ra các scraper tinh vi và hiệu quả hơn, có khả năng thích ứng với việc thay đổi cấu trúc trang web và trích xuất dữ liệu phong phú hơn.

- Tương lai của theo dõi giá và quản lý hàng tồn kho: Các công cụ và nền tảng tiên tiến hơn sẽ xuất hiện, cung cấp dữ liệu và thông tin chi tiết theo thời gian thực cho các chiến lược định giá động, quản lý hàng tồn kho tốt hơn và nâng cao trải nghiệm khách hàng.

Tăng cường quét web của bạn với IPBurger

Triển khai proxy là rất quan trọng trong việc xây dựng một trình quét web hiệu quả và đáng tin cậy. Proxy giúp bạn tránh bị cấm IP, phân phối yêu cầu và duy trì ẩn danh trong khi thu thập dữ liệu. IPBurger cung cấp một loạt các dịch vụ proxy chất lượng cao, bao gồm proxy dân cư, di động và trung tâm dữ liệu, được thiết kế để đáp ứng nhu cầu của các trình quét web.

- Bảo mật và ẩn danh: Các proxy của IPBurger đảm bảo rằng các hoạt động cạo của bạn vẫn ẩn danh và an toàn, bảo vệ dữ liệu của bạn khỏi bị theo dõi hoặc bị chặn.

- Avoiding Bans: By rotating IP addresses and mimicking human behavior, IPBurger’s proxies help you avoid detection and bans, ensuring uninterrupted scraping.

- Tiếp cận toàn cầu: Truy cập dữ liệu từ các vị trí địa lý khác nhau bằng cách sử dụng mạng proxy toàn cầu của IPBurger, nâng cao khả năng thực hiện thu thập và phân tích cục bộ của bạn.

Bây giờ bạn đã hiểu việc xây dựng một công cụ cạo BrickSeek một cách toàn diện, đã đến lúc triển khai kiến thức của bạn. Bắt đầu dự án cạo của bạn ngay hôm nay và khám phá những lợi ích của việc tự động hóa theo dõi giá và quản lý hàng tồn kho của bạn. Đừng quên tận dụng các dịch vụ proxy của IPBurger để tăng cường nỗ lực cạo của bạn và đảm bảo thu thập dữ liệu đáng tin cậy và an toàn.

Chúng tôi khuyến khích bạn chia sẻ kinh nghiệm, thách thức và mẹo của mình trong phần bình luận. Thông tin chi tiết của bạn có thể giúp những người khác trong cộng đồng và góp phần cải tiến liên tục các kỹ thuật quét web.

Chúc bạn cạo vui vẻ!