让我们来谈谈 BrickSeek Scraper。

如果你曾经在网上寻找过优惠,你可能会偶然发现这个宝贝。BrickSeek 就像你的私人交易侦探,它可以在网上搜索各种零售商的最佳产品价格。BrickSeek 最初是为了帮助购物者在本地商店找到最优惠的商品价格而设计的,现在已经发展成为一个强大的工具,可以帮助任何人节省一两块钱,甚至更多。

BrickSeek的神奇之处在于其实时跟踪价格和库存的能力。无论你是讨价还价的猎人,还是希望优化库存的经销商,抑或是喜欢实惠的人,BrickSeek都能为你提供帮助。想象一下,你可以准确地知道难以捉摸的打折电视机在哪里有货,或者发现你孩子一直想要的玩具在几英里外的商店半价出售。这就是价格跟踪和库存管理的威力。

网络抓取简介

现在,我们来谈谈网络搜索。它听起来很专业,也确实很专业,但不要被它吓到。网络搜索的核心是将从网站收集数据的过程自动化。无需手动查看十几个网站的价格下降或股票更新,网络搜刮工具就能为你完成繁重的工作,将数据提取为整洁、可用的格式。

把它想象成一个超级勤奋的助手,不眠不休地检查更新并返回您需要的信息。网络搜刮旨在使数据收集更快、更高效、更省力。

但权力越大,责任也越大。有一些道德方面的考虑需要牢记。并不是每个网站都希望自己的数据被搜刮,有些网站的服务条款明确禁止搜刮。此外还有法律方面的问题--错误的数据采集方式会让你惹上麻烦。因此,了解规则和公平竞争至关重要。合乎道德的抓取意味着尊重网站政策,不向服务器发出过多请求,最重要的是不将数据用于邪恶目的。

因此,无论你是一个数据狂人,还是一个精明的购物者,或者只是一个喜欢走在曲线前面的人,了解 BrickSeek 和网络搜索的来龙去脉都能为你带来无限可能。而且,正如我们将看到的,这不仅仅是为了省钱,而是为了更聪明地利用时间和资源。

第 1 部分:了解 BrickSeek

什么是 BrickSeek?

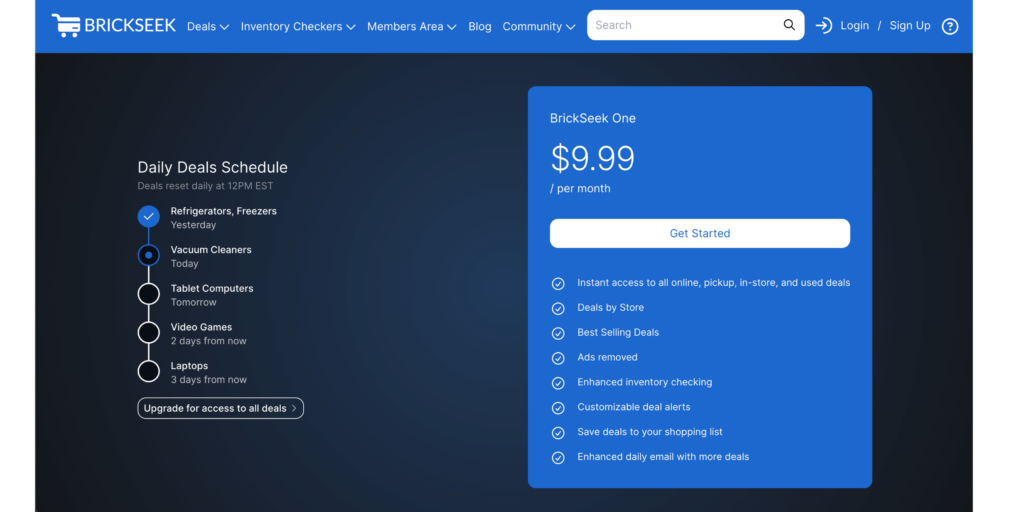

BrickSeek 是一款价格跟踪和库存检查工具,在讨价还价者和精明购物者中声名鹊起。它的初衷是帮助人们在本地商店找到最优惠的商品,如今已发展成为一个强大的平台,提供各种功能,满足了广大受众的需求。

历史与发展:

BrickSeek 最初只是沃尔玛的一个简单库存跟踪器,后来扩展到 Target、Lowe's、Office Depot 等主要零售商。消费者日益增长的需求推动了BrickSeek的发展,使他们能够做出明智的购买决策,而无需费力地访问多家商店或网站。如今,BrickSeek 拥有友好的用户界面和强大的后台,可以实时收集和更新数据。

主要功能和优点

- 价格提醒: 用户可以为特定产品设置提醒,确保不会错过降价或缺货通知。

- 库存跟踪:实时更新多个零售商的产品供应情况。

- 优惠搜索器: 热门交易和清仓商品的精选列表。

- 本地降价信息:本地商店降价和清仓商品信息。

- 在线优惠: 网上独家优惠和折扣专栏。

这些功能通过整合信息,帮助用户节省金钱和时间,否则这些信息需要数小时的手动搜索。

BrickSeek 的使用案例

寻找优惠和折扣:BrickSeek的主要用途之一是寻找最佳优惠和折扣。无论是热门的新科技小工具、家庭必需品还是儿童玩具,BrickSeek 都能帮您找到最优惠的在线和店内价格。利用其价格提醒和交易搜索器功能,您无需经常查看多个网站,就能掌握销售和促销信息。

经销商库存跟踪:对分销商而言,在不同店铺保持库存可能是一场物流噩梦。BrickSeek通过提供实时库存数据简化了这一过程。这对那些大量购买产品转售获利的人尤其有用。了解产品在何时何地有货,可以让经销商更有效地计划采购,避免缺货。

精明购物者的价格比较:对于那些喜欢确保物有所值的人来说,BrickSeek 的价格比较功能非常有价值。通过比较多个零售商的价格,购物者可以确保他们没有多花钱。在 "黑色星期五"、"网络星期一 "或返校促销等大型购物活动期间,价格波动很快,这个功能尤其有用。

BrickSeek 是一款多功能工具,可满足从普通交易猎人到专业经销商的不同需求。它能够提供准确、实时的数据,是任何希望节省金钱和时间的人不可或缺的资源。

第 2 节:网络抓取基础知识

什么是网络抓取?

网络搜刮是从网站上自动提取数据的过程。这种技术通常用于收集大量耗时或难以手动收集的数据。使用软件或脚本,网络搜索可以自动检索信息,从而可以大规模地收集和分析数据。

定义和常见应用

网络搜刮包括使用自动机器人访问网站、解析 HTML 并提取有用信息。这些信息包括产品价格、库存情况、客户评价等。提取的数据可用于各种目的的存储和分析。

网络搜刮的常见应用包括

- 价格监控: 跟踪多个网站的价格,找到最优惠的价格。

- 市场调研: 收集有关竞争对手产品、价格和客户反馈的数据。

- 内容聚合: 从各种来源收集文章、博客或新闻,以获得全面概述。

- 数据挖掘: 提取大型数据集,用于金融、医疗保健和电子商务领域的分析。

优势与挑战

- 优点 网络扫描可通过自动收集数据来节省时间和资源。它能提供最新、全面的数据集,从而更好地进行决策和战略规划。对于企业来说,这意味着通过紧跟市场趋势和消费者行为来保持竞争力。

- 挑战: 尽管网络搜刮有其优势,但也存在技术和道德方面的挑战。网站经常会改变结构,这可能会破坏搜索脚本。此外,处理大量数据需要强大的基础设施和管理。此外,确保搜刮活动不违反服务条款或道德标准也至关重要。

法律和道德方面的考虑

说到网络搜索,了解法律和道德方面的情况至关重要。虽然网络搜索本身并不违法,但如何进行网络搜索可能会引发法律问题。

了解服务条款

大多数网站都有概述可接受使用政策的服务条款(ToS)。对违反网站服务条款的网站进行搜刮可能会导致法律诉讼,尤其是在搜刮活动被发现并损害网站运营的情况下。因此,查看并遵守您打算抓取的任何网站的 ToS 非常重要。

合乎道德的搜索实践

合乎道德的刮擦包括几种最佳做法,以确保刮擦过程是受尊重的、合法的:

- 尊重 Robots.txt: 网站上的这个文件说明了网站的哪些部分可以被抓取,哪些部分不能被抓取。遵守这些准则是一项基本的道德规范。

- 避免负载过重: 抓取会给网站服务器带来压力。限制请求的频率和数量有助于避免网站负荷过重。

- 署名和使用: 如果数据是为出版或分析而采集的,则必须适当注明数据来源。此外,使用数据时不得损害原始网站或其用户,这一点至关重要。

- 个人数据保护: 除非获得明确许可并遵守数据隐私法规,否则应避免收集个人数据。

总之,虽然网络刮擦提供了强大的数据收集和分析能力,但必须以负责任的方式进行。了解法律意义和遵守道德标准是有效和可持续利用这项技术的关键。

第 3 节:BrickSeek 搜索入门

工具和技术

开始 BrickSeek 搜刮之旅需要正确的工具和技术。以下是将为你的成功奠定基础的基本编程语言和库的概述。

推荐的编程语言

- Python 因其简单易用和大量可用库,被广泛认为是网络刮擦的首选语言。Python 的可读性和社区支持使其成为初学者和经验丰富的开发人员的理想选择。

基本图书馆

- BeautifulSoup:用于解析 HTML 和 XML 文档的 Python 库。它为解析后的页面创建解析树,可用于轻松提取数据。

- Scrapy: 适用于 Python 的开源协作式网络抓取框架。Scrapy 功能强大,使用灵活,可让您高效地抓取和提取数据。

- Selenium: 自动浏览器的网络测试库。它尤其适用于扫描 JavaScript 呈现的动态内容,而传统的扫描库可能会漏掉这些内容。

设置环境

在开始刮擦之前,您必须设置好您的环境。以下是一份分步指南,可帮助您开始工作。

安装必要的软件和程序库

- Install Python: Ensure Python is installed on your system. You can download it from python.org.

- 建立虚拟环境: 为你的项目创建一个虚拟环境来管理依赖关系是个不错的做法。您可以使用 venv.

python -m venv brickseek_scraper

source brickseek_scraper/bin/activate # On Windows, use `brickseek_scraper\Scripts\activate`- 安装库: 激活虚拟环境后,使用 pip 安装必要的库。

pip install beautifulsoup4 scrapy selenium requestsBrickSeek 刮板项目的基本设置

- 创建项目目录:

mkdir brickseek_scraper

cd brickseek_scraper- 初始化 Scrapy 项目: 如果使用 Scrapy,请初始化一个新项目。

scrapy startproject brickseek

cd brickseek- 设置 Selenium: 对于 Selenium,您需要为浏览器下载相应的 WebDriver(如用于 Google Chrome 浏览器的 ChromeDriver)。

# Example for installing ChromeDriver

wget https://chromedriver.storage.googleapis.com/91.0.4472.101/chromedriver_linux64.zip

unzip chromedriver_linux64.zip

mv chromedriver /usr/local/bin/- 基本 Scrapy 蜘蛛: 创建一个简单的 Scrapy 蜘蛛,开始搜索 BrickSeek。

# brickseek/brickseek/spiders/brickseek_spider.py

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ["https://brickseek.com/"]

def parse(self, response):

self.log('Visited %s' % response.url)- 运行蜘蛛 执行蜘蛛,查看一切设置是否正确。

scrapy crawl brickseek通过使用这些工具和技术设置你的环境,你就可以开始从 BrickSeek 搜刮数据了。这些准备工作可确保你打下坚实的基础,以便完成更复杂的数据挖掘任务,并高效地处理数据。

第 4 节:构建你的 BrickSeek 刮板

BrickSeek Scraper 分步指南

构建一个 BrickSeek scraper 需要几个步骤,从确定目标数据到编写提取这些信息的代码。让我们来分解一下。

识别目标数据(URL、HTML 元素):

- 从探索BrickSeek开始: 访问BrickSeek并导航到你想抓取的页面。查看 URL 模式、产品页面和 HTML 结构。

- 使用开发工具: 打开浏览器的开发工具(通常使用 F12 或右键单击并选择 "检查")。检查包含您感兴趣的数据(如价格、库存状态和产品详细信息)的 HTML 元素。

用 BeautifulSoup/Scrapy 编写基本刮刀

- 使用 BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Define the URL of the page to scrape

url = 'https://brickseek.com/deal/'

# Send a GET request to the URL

response = requests.get(url)

# Parse the HTML content using BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

# Extract data (e.g., prices, inventory, product details)

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- 使用 Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}处理动态内容

有时,您需要的内容是使用 JavaScript 动态加载的。以下是处理方法。

将 Selenium 用于 JavaScript 渲染的内容:

- 设置 Selenium:

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from selenium.webdriver.chrome.options import Options

chrome_options = Options()

chrome_options.add_argument("--headless")

service = Service('path/to/chromedriver')

driver = webdriver.Chrome(service=service, options=chrome_options)

driver.get('https://brickseek.com/deal/')

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')

driver.quit()处理 AJAX 和其他动态元素的技巧

等待元素加载: 在尝试提取数据前,使用显式等待确保元素已加载。

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

driver.get('https://brickseek.com/deal/')

WebDriverWait(driver, 10).until(

EC.presence_of_element_located((By.CLASS_NAME, 'item'))

)

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')处理无限滚动: 对于无限滚动的页面,您可能需要向下滚动以加载更多内容。

import time

driver.get('https://brickseek.com/deal/')

last_height = driver.execute_script("return document.body.scrollHeight")

while True:

driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(2)

new_height = driver.execute_script("return document.body.scrollHeight")

if new_height == last_height:

break

last_height = new_height

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')按照这些步骤,你就能构建一个强大的 BrickSeek 搜刮器,有效处理静态和动态内容,并无缝提取有价值的数据。

第 5 节:增强您的刮板

要改进你的BrickSeek scraper,你必须采用先进的技术,以确保其效率和使用寿命。本节将介绍掩盖身份、避免封禁的代理服务器,以及模仿人类行为以保持低调的方法。

实施代理

为什么使用代理?

代理对于网络搜刮来说至关重要,尤其是在针对有严格反搜刮措施的网站时。以下是您应该考虑使用代理的原因:

- 匿名性: 代理可以隐藏你的 IP 地址,使你的请求看起来来自不同的地方。

- 避免封禁: 使用多个代理可以分散你的请求,减少因流量过大而被屏蔽的机会。

- 访问受地理限制的内容: 代理可以使您的请求看起来像是来自特定国家,从而允许您访问受地区限制的数据。

为你的扫瞄器设置 IPBurger 代理

Using IPBurger proxies is straightforward. Here’s how to integrate them into your BrickSeek scraper:

- 注册 IPBurger:

- Visit IPBurger’s website and sign up for a proxy plan that fits your needs.

- 获取代理详细信息,包括 IP 地址、端口、用户名和密码。

- 在代码中配置代理:

With Requests and BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Proxy details

proxies = {

'http': 'http://username:password@proxy_ip:proxy_port',

'https': 'https://username:password@proxy_ip:proxy_port'

}

url = 'https://brickseek.com/deal/'

response = requests.get(url, proxies=proxies)

soup = BeautifulSoup(response.text, 'html.parser')

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- 使用 Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def start_requests(self):

for url in self.start_urls:

yield scrapy.Request(url=url, callback=self.parse, meta={

'proxy': 'http://username:password@proxy_ip:proxy_port'

})

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}避免禁令和费率限制

您必须采用模仿人类浏览行为的技术,以防止您的刮擦器被检测和禁止。

模仿人类行为的技术

- 随机化用户代理:

- 旋转用户代理字符串,使请求看起来来自不同的浏览器。

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (X11; Ubuntu; Linux x86_64; rv:89.0) Gecko/20100101 Firefox/89.0',

# Add more user agents as needed

]

headers = {

'User-Agent': random.choice(user_agents)

}response = requests.get(url, headers=headers, proxies=proxies)

- 实施延迟和随机间隔:

- 在请求之间引入延迟,以模拟自然浏览模式。

- 使用随机间隔,避免形成可预测的模式。

import time

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')

# Random delay between requests

time.sleep(random.uniform(1, 3))通过整合代理服务器和模拟人类行为,你可以显著提高BrickSeek搜刮引擎的效率和寿命,确保其长期平稳运行而不被发现。

第 6 节:数据管理和存储

从BrickSeek成功获取数据后,下一个关键步骤就是有效地管理和存储这些数据。本节将向你介绍不同的数据存储方法,以及如何清理和格式化数据以便进一步分析。

存储抓取的数据

存储数据的选项

根据数据的数量和复杂程度,您可以选择多种方式来存储刮擦数据:

- CSV 文件:

- 对于较小的数据集来说,简单易用。

- 与大多数数据分析工具和软件兼容。

- 是快速分析和可视化的理想选择。

- 数据库:

- 更适合大型数据集和更复杂的查询。

- 可选项包括用于本地存储的 SQLite 和用于更强大、可扩展解决方案的 MySQL 或 PostgreSQL。

- 提供更好的数据完整性和更便捷的分析访问。

- 云存储:

- 适用于需要分布式存储解决方案的大型刮擦项目。

- 选项包括 AWS S3、Google Cloud Storage 或 Azure Blob Storage。

- 提供高可用性和可扩展性。

将数据写入文件

下面介绍如何将搜刮到的数据写入 CSV 文件或数据库:

写入 CSV 文件

import csv

data = [

{'title': 'Deal 1', 'price': '$10'},

{'title': 'Deal 2', 'price': '$15'},

# Add more data as needed

]

with open('deals.csv', mode='w', newline='') as file:

writer = csv.DictWriter(file, fieldnames=['title', 'price'])

writer.writeheader()

for item in data:

writer.writerow(item)写入 SQLite 数据库

import sqlite3

# Connect to the SQLite database (or create it if it doesn't exist)

conn = sqlite3.connect('deals.db')

cursor = conn.cursor()

# Create a table

cursor.execute('''

CREATE TABLE IF NOT EXISTS deals (

id INTEGER PRIMARY KEY,

title TEXT,

price TEXT

)

''')

# Insert data into the table

data = [

('Deal 1', '$10'),

('Deal 2', '$15'),

# Add more data as needed

]

cursor.executemany('INSERT INTO deals (title, price) VALUES (?, ?)', data)

conn.commit()

# Close the connection

conn.close()数据清理和格式化

从网站上获取的原始数据在分析之前通常需要进行清理和格式化。以下是一些准备数据的基本技巧。

基本数据清理技术

删除重复:

- 确保数据集中的每个条目都是唯一的。

import pandas as pd

df = pd.read_csv('deals.csv')

df.drop_duplicates(inplace=True)

df.to_csv('deals_cleaned.csv', index=False)处理缺失值

- 填写缺失的数值或删除数据缺失的条目。

df = pd.read_csv('deals.csv')

df.dropna(inplace=True) # Remove rows with missing values

df.fillna('N/A', inplace=True) # Fill missing values with 'N/A'

df.to_csv('deals_cleaned.csv', index=False)数据格式规范化

- 确保数据格式(如价格格式、日期格式)的一致性。

df['price'] = df['price'].str.replace('$', '').astype(float)

df.to_csv('deals_cleaned.csv', index=False)为分析构建数据

将数据整理成表格:

- 将数据整理成表格,标题清晰,数据类型一致。

- 对于关系数据库,要确保表与表之间有适当的规范化和关系。

使用数据框架

- DataFrames 和 Python 中的 Pandas 所提供的一样,提供了强大的数据操作和分析工具。

import pandas as pd

df = pd.read_csv('deals_cleaned.csv')

# Perform analysis and manipulations通过有效管理和存储刮擦数据,您可以确保数据随时可供分析和进一步使用。正确的数据处理方法将节省您的时间和精力,使您的数据分析过程更加顺畅和高效。

第 7 节:分析和使用数据

从BrickSeek成功获取并存储数据后,下一步就是对数据进行分析,以提取有价值的见解。本节将介绍基本和高级数据分析技术,帮助你充分利用收集到的数据。

基本数据分析

分析扫描数据的工具和技术

Excel/Google Sheets:

- 使用方法适用于快速、直接的数据分析。

- 技术:

- 排序和过滤数据

- 使用数据透视表汇总和探索数据。

- 应用公式和函数进行计算和变换。

Pandas(Python 库):

- 使用方法数据处理和分析的强大工具。

- 技术:

- 将数据读入 DataFrames,进行结构化分析。

- 进行描述性统计(平均值、中位数、标准偏差)。

- 分组和汇总数据,找出模式。

import pandas as pd

# Load data into a DataFrame

df = pd.read_csv('deals_cleaned.csv')

# Basic statistics

print(df.describe())

# Group by a specific column and aggregate

grouped = df.groupby('category').mean()

print(grouped)可视化工具(Matplotlib、Seaborn、Tableau):

- 使用方法可视化数据,识别趋势和模式。

- 技术:

- 创建折线图、柱状图、直方图和散点图。

- 使用热图进行相关性分析。

import matplotlib.pyplot as plt

import seaborn as sns

# Plot a histogram of prices

sns.histplot(df['price'], bins=20, kde=True)

plt.show()

# Create a bar chart

df['category'].value_counts().plot(kind='bar')

plt.show()寻找模式和见解

- 趋势分析:

- 寻找长期趋势,如价格波动、季节性折扣或库存水平变化。

- 例如确定特定产品类别折扣最高的时期。

- 比较分析:

- 比较不同零售商的价格,找到最优惠的价格。

- 举例说明:比较产品在不同平台上的平均价格。

- 相关性分析:

- 确定不同变量之间的关系。

- 举例说明:将产品价格与库存水平联系起来,了解供需动态。

高级分析

利用机器学习获得预测性洞察力

预测建模:

- 应用机器学习算法,根据历史数据预测未来趋势。

- 举例说明:使用回归模型,根据过去的数据预测产品的未来价格。

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

# Prepare data for modeling

X = df[['feature1', 'feature2']] # Replace with relevant features

y = df['price']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Train a regression model

model = LinearRegression()

model.fit(X_train, y_train)

# Make predictions

predictions = model.predict(X_test)聚类:

- 使用聚类算法,根据相似性将产品划分为不同类别。

- 举例说明:按价格范围、类别和受欢迎程度对产品进行分组,以确定不同的群组。

from sklearn.cluster import KMeans

# Prepare data for clustering

features = df[['feature1', 'feature2']] # Replace with relevant features

# Perform K-means clustering

kmeans = KMeans(n_clusters=3, random_state=42)

df['cluster'] = kmeans.fit_predict(features)与其他数据源整合,进行更丰富的分析

- 组合数据集:

- 将 BrickSeek 数据与销售数据、客户评价或竞争对手价格等其他数据源整合,以进行全面分析。

- 实例:将 BrickSeek 价格数据与销售业绩数据相结合,分析定价策略对销售的影响。

- 应用程序接口和数据库

- 使用应用程序接口获取更多数据,或连接外部数据库进行更广泛的分析。

- 实例:使用电子商务 API 获取有关产品可用性和评论的实时数据。

- 数据可视化仪表板:

- 使用 Tableau、Power BI 或 Plotly Dash 等工具创建交互式仪表盘,将集成数据可视化并监控关键指标。

- 举例说明:建立实时仪表板,跟踪价格趋势、库存变化和竞争对手的定价。

这些基本和高级数据分析技术可以从BrickSeek数据中发现有价值的见解,让您做出明智的决策,优化您的战略,并在激烈的市场竞争中保持领先地位。

第 8 节:故障排除和优化

建立一个BrickSeek搜刮器是一件很有意义的事,但就像任何复杂的任务一样,它也有自己的挑战。本节将帮助你排除常见问题,并优化你的搜刮器以获得最佳性能,确保你从数据提取工作中获得最大收益。

常见问题和解决方案

处理常见错误和问题

- HTTP 错误(404、500 等):

- 问题:刮擦过程中可能会遇到 HTTP 错误,如 404(未找到)或 500(内部服务器错误)。

- 解决方案:在刮擦器中实施错误处理,从容应对这些错误。使用 try-except 块捕获异常,并在短暂延迟后重试请求。

import requests

from time import sleep

url = 'http://example.com'

for attempt in range(5):

try:

response = requests.get(url)

response.raise_for_status() # Raises an HTTPError for bad responses

break # Exit loop if request is successful

except requests.exceptions.RequestException as e:

print(f'Error: {e}, retrying...')

sleep(5)- 验证码和反僵尸措施:

- 问题:网站通常使用验证码和其他反机器人机制来防止刮擦。

- Solution: Use IP rotation with proxies, and consider integrating CAPTCHA-solving services if necessary. Implement delays and random intervals between requests to mimic human behavior.

import random

from time import sleep

delay = random.uniform(2, 5) # Random delay between 2 and 5 seconds

sleep(delay)- JavaScript 呈现的内容

- 问题:BrickSeek 上的某些内容可能是使用 JavaScript 呈现的,而 BeautifulSoup 等静态刮擦工具无法处理这些内容。

- 解决方案:使用 Selenium 处理 JavaScript 渲染的内容。

from selenium import webdriver

driver = webdriver.Chrome()

driver.get('http://example.com')

content = driver.page_source- 被屏蔽的 IP 地址:

- 问题:由于请求频繁,您的 IP 地址可能会被屏蔽。

- Solution: Use IPBurger proxies to rotate IP addresses and avoid detection.

proxy = "http://proxyserver:port"

proxies = {

"http": proxy,

"https": proxy,

}

response = requests.get(url, proxies=proxies)优化扫瞄器性能

- 高效数据提取:

- 针对特定的 HTML 元素和属性,尽量减少所请求的数据。

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

price = soup.find('span', {'class': 'price'}).text- 并发请求:

- 使用 aiohttp 或多线程等异步库,提出并发请求,加快数据提取速度。

import asyncio

import aiohttp

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main(urls):

async with aiohttp.ClientSession() as session:

tasks = [fetch(session, url) for url in urls]

return await asyncio.gather(*tasks)

urls = ['http://example.com/page1', 'http://example.com/page2']

loop = asyncio.get_event_loop()

pages = loop.run_until_complete(main(urls))- 缓存和节流

- 实施缓存以避免对相同数据的冗余请求,并对请求进行节流以防止服务器超载。

from cachetools import TTLCache

cache = TTLCache(maxsize=100, ttl=300)

def get_page(url):

if url in cache:

return cache[url]

response = requests.get(url)

cache[url] = response.text

return response.text高级技巧和窍门

充分利用 BrickSeek 刮板的专家提示

- 动态用户代理:

- 轮流使用用户代理来模拟不同的浏览器,降低被屏蔽的可能性。

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_11_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36',

# Add more user agents

]

headers = {'User-Agent': random.choice(user_agents)}

response = requests.get(url, headers=headers)- 会话持久性:

- 使用会话对象在多个请求中持久保存 cookie 和标头,这有助于维持登录会话和减少检测。

session = requests.Session()

session.headers.update({'User-Agent': random.choice(user_agents)})

response = session.get(url)持续改进战略

- 定期维护:

- 定期更新您的搜索器,以适应BrickSeek网站结构的变化。自动监测可以提醒你进行必要的更新。

import requests

def monitor_changes(url, current_structure):

response = requests.get(url)

new_structure = response.text

if new_structure != current_structure:

print("Website structure has changed!")

# Update scraper logic here- 反馈回路:

- 实施反馈回路,从错误和性能指标中吸取经验教训,不断改进刮板,提高效率和准确性。

import logging

logging.basicConfig(filename='scraper.log', level=logging.INFO)

def log_error(error):

logging.error(f"Error occurred: {error}")

try:

response = requests.get(url)

response.raise_for_status()

except requests.exceptions.RequestException as e:

log_error(e)遵循这些故障排除和优化技巧,可确保您的BrickSeek刮板顺利、高效、有效地运行,为您的各种需求提供有价值的数据。

结论

要点概述

建立一个BrickSeek scraper可以为价格跟踪、交易搜索和库存管理带来无限商机。在本指南中,我们将介绍以下内容:

- 了解 BrickSeek: 从其历史和发展到主要功能和使用案例。

- 网络搜索基础知识: 网络搜索的定义、好处和挑战,以及道德考量的重要性。

- 入门: 工具、技术和设置网络搜索环境。

- 构建你的搜索器 分步指南:编写基本搜索器、处理动态内容和提取相关数据。

- 增强您的 Scraper:实施代理、避免封禁、模仿人类行为以确保顺利运行。

- 数据管理: 存储、清理和格式化搜索到的数据,以便进行分析。

- 分析和使用数据: 将基础和高级数据分析与其他数据源相结合的工具和技术。

- 故障排除和优化: 处理常见问题、优化性能以及改进刮板的高级技巧。

未来趋势

随着技术的发展,网络搜索和数据分析的前景也在不断变化。以下是一些值得关注的趋势:

- 网络抓取的新兴技术: 利用人工智能和机器学习创建更复杂、更高效的抓取器,能够适应不断变化的网站结构并提取更丰富的数据。

- 价格跟踪和库存管理的未来: 将出现更先进的工具和平台,为动态定价策略、更好的库存管理和增强的客户体验提供实时数据和洞察力。

使用 IPBurger 增强网络抓取功能

实施代理对于构建高效可靠的网络搜刮程序至关重要。代理服务器可帮助您避免 IP 禁止、分发请求并在刮擦数据时保持匿名性。IPBurger 提供一系列高质量的代理服务,包括住宅、移动和数据中心代理,专为满足网络搜刮者的需求而定制。

- 安全性和匿名性:IPBurger 的代理服务器确保您的搜索活动保持匿名和安全,保护您的数据不被跟踪或拦截。

- Avoiding Bans: By rotating IP addresses and mimicking human behavior, IPBurger’s proxies help you avoid detection and bans, ensuring uninterrupted scraping.

- 全球覆盖: 使用 IPBurger 的全球代理网络访问不同地理位置的数据,提高您执行本地化搜索和分析的能力。

现在你已经全面了解了如何构建BrickSeek刮板,是时候实施你的知识了。今天就开始你的搜刮项目,探索价格跟踪和库存管理自动化的好处。不要忘了利用IPBurger的代理服务来加强你的搜刮工作,并确保可靠和安全的数据收集。

我们鼓励您在评论区分享您的经验、挑战和技巧。您的见解可以帮助社区中的其他人,并有助于不断改进网络刮擦技术。

刮得开心