Hablemos de BrickSeek Scraper.

Si alguna vez has buscado ofertas en Internet, es posible que te hayas topado con esta joya. BrickSeek es como tu detective personal de ofertas, que rastrea la web para encontrar los mejores precios de productos en varias tiendas. Originalmente diseñada para ayudar a los compradores a encontrar los mejores precios en tiendas locales, se ha convertido en una poderosa herramienta para cualquiera que quiera ahorrarse un dólar o dos, o más.

La magia de BrickSeek reside en su capacidad de seguimiento de precios e inventario en tiempo real. BrickSeek tiene algo que ofrecerle, ya sea un cazador de gangas, un revendedor que busca optimizar su inventario o alguien a quien le encantan las buenas ofertas. Imagínese saber exactamente dónde se encuentra en stock ese televisor rebajado tan difícil de encontrar o descubrir que el juguete que su hijo le ha estado pidiendo está a mitad de precio en una tienda a sólo unos kilómetros de distancia. Ese es el poder del seguimiento de precios y la gestión de inventario.

Introducción al Web Scraping

Pasemos ahora al web scraping. Suena técnico y en cierto modo lo es, pero no dejes que eso te asuste. En esencia, el web scraping consiste en automatizar el proceso de recopilación de datos de sitios web. En lugar de comprobar manualmente una docena de sitios web en busca de caídas de precios o actualizaciones de acciones, un raspador web hace el trabajo pesado por usted, extrayendo los datos en un formato ordenado y utilizable.

Es como tener un asistente muy diligente que nunca duerme, busca constantemente actualizaciones y te devuelve la información que necesitas. El scraping web pretende que la recopilación de datos sea más rápida, eficiente y menos tediosa.

Pero un gran poder conlleva una gran responsabilidad. Hay consideraciones éticas que hay que tener en cuenta. No todos los sitios web quieren que sus datos sean rastreados, y algunos tienen condiciones de servicio que lo prohíben explícitamente. También está el aspecto legal: el scraping incorrecto puede meterte en un buen lío. Por eso es esencial conocer las reglas y jugar limpio. El scraping ético significa respetar las políticas de los sitios web, no sobrecargar los servidores con demasiadas peticiones y, lo más importante, no utilizar los datos para fines nefastos.

Así que, tanto si eres un empollón de los datos, un comprador experto o simplemente alguien a quien le gusta ir por delante de los demás, comprender los entresijos de BrickSeek y el web scraping puede abrirte un mundo de posibilidades. Y, como veremos, no se trata sólo de ahorrar dinero, sino de ser más inteligente con tu tiempo y tus recursos.

Sección 1: Comprender BrickSeek

¿Qué es BrickSeek?

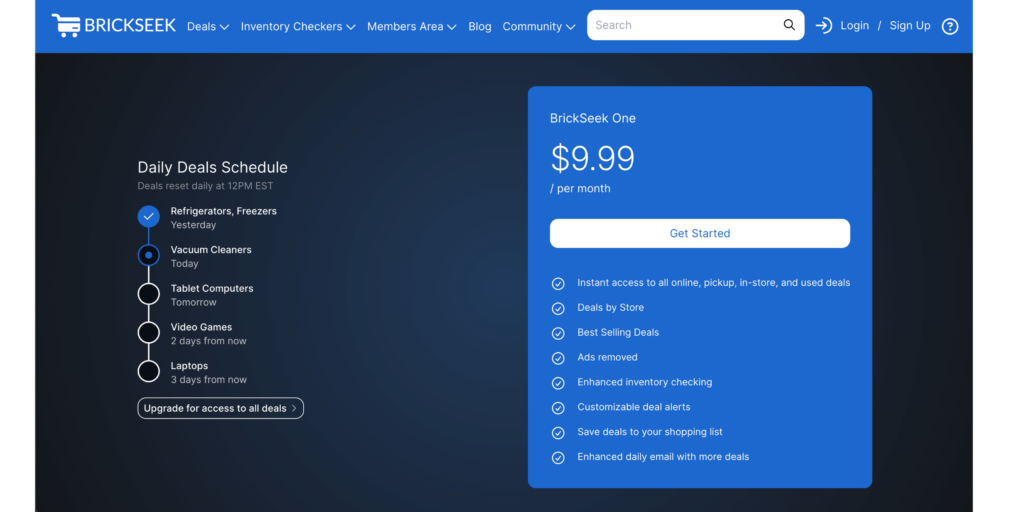

BrickSeek es una herramienta de seguimiento de precios y comprobación de inventarios que se ha hecho un nombre entre los cazadores de gangas y los compradores expertos. Lanzada con la idea de ayudar a la gente a encontrar las mejores ofertas en las tiendas locales, ha evolucionado hasta convertirse en una sólida plataforma que ofrece una gran variedad de funciones dirigidas a un amplio público.

Historia y desarrollo:

BrickSeek comenzó como un simple rastreador de inventario para Walmart y desde entonces se ha ampliado para incluir a grandes minoristas como Target, Lowe's, Office Depot y otros. Su desarrollo se ha visto impulsado por la creciente necesidad de los consumidores de tomar decisiones de compra informadas sin la molestia de visitar varias tiendas o sitios web. En la actualidad, BrickSeek cuenta con una interfaz fácil de usar y un potente backend que recopila y actualiza datos en tiempo real.

Principales características y ventajas:

- Alertas de precios: Los usuarios pueden establecer alertas para productos específicos, asegurándose de que nunca se pierden una bajada de precios o una notificación de reposición de existencias.

- Seguimiento del inventario: Actualizaciones en tiempo real sobre la disponibilidad de productos en múltiples minoristas.

- Buscador de ofertas: Una lista de ofertas y artículos en liquidación.

- Información sobre rebajas locales: Información sobre rebajas y artículos en liquidación en tiendas locales.

- Ofertas en línea: Una sección dedicada a ofertas y descuentos exclusivos online.

Estas funciones ayudan a los usuarios a ahorrar dinero y tiempo al consolidar información que, de otro modo, requeriría horas de búsqueda manual.

Casos prácticos de BrickSeek

Encontrar ofertas y descuentos: Uno de los principales usos de BrickSeek es encontrar las mejores ofertas y descuentos disponibles. BrickSeek puede ayudarle a encontrar los mejores precios tanto en Internet como en las tiendas, ya se trate de nuevos aparatos tecnológicos, artículos de primera necesidad para el hogar o juguetes para los niños. Gracias a las alertas de precios y al buscador de ofertas, podrá estar al tanto de las rebajas y promociones sin tener que consultar constantemente varios sitios Web.

Seguimiento de inventario para revendedores: Mantener el inventario en diferentes tiendas puede ser una pesadilla logística para los revendedores. BrickSeek simplifica este proceso proporcionando datos de inventario en tiempo real. Esto es especialmente útil para quienes compran productos al por mayor para revenderlos y obtener beneficios. Saber dónde y cuándo están disponibles los productos permite a los revendedores planificar sus compras de forma más eficaz y evitar las roturas de stock.

Comparación de precios para compradores expertos: La función de comparación de precios de BrickSeek tiene un valor incalculable para los que quieren asegurarse de que obtienen lo mejor por su dinero. Al comparar los precios de varios minoristas, los compradores pueden asegurarse de que no están pagando de más. Esto es especialmente útil durante los grandes eventos comerciales, como el Black Friday, el Cyber Monday o las rebajas de vuelta al colegio, cuando los precios fluctúan rápidamente.

BrickSeek es una herramienta versátil que satisface diferentes necesidades, desde cazadores de gangas ocasionales hasta revendedores profesionales. Su capacidad para proporcionar datos precisos en tiempo real la convierte en un recurso esencial para cualquiera que desee ahorrar dinero y tiempo.

Sección 2: Aspectos básicos del Web Scraping

¿Qué es el Web Scraping?

El web scraping es el proceso de extracción automática de datos de sitios web. Esta técnica se utiliza habitualmente para recopilar grandes cantidades de datos cuya recogida manual llevaría mucho tiempo o sería difícil. Mediante software o scripts, el web scraping puede automatizar la recuperación de información, lo que permite recopilar y analizar datos a gran escala.

Definición y aplicaciones comunes

El web scraping consiste en utilizar robots automatizados para visitar sitios web, analizar el código HTML y extraer información útil. Esto puede incluir precios de productos, disponibilidad de existencias, opiniones de clientes y mucho más. Los datos extraídos pueden almacenarse y analizarse con diversos fines.

Entre las aplicaciones más comunes del web scraping se incluyen

- Seguimiento de precios: Seguimiento de precios en múltiples sitios web para encontrar las mejores ofertas.

- Estudios de mercado: Recopilación de datos sobre los productos, precios y opiniones de los clientes de la competencia.

- Agregación de contenidos: Recopilación de artículos, blogs o noticias de varias fuentes para obtener una visión global.

- Minería de datos: Extracción de grandes conjuntos de datos para su análisis en los campos de las finanzas, la sanidad y el comercio electrónico.

Ventajas y retos

- Ventajas: El scraping web puede ahorrar tiempo y recursos al automatizar la recogida de datos. Proporciona conjuntos de datos actualizados y completos que permiten tomar mejores decisiones y planificar mejor las estrategias. Para las empresas, esto significa seguir siendo competitivas manteniéndose al día de las tendencias del mercado y el comportamiento de los consumidores.

- Desafíos: A pesar de sus ventajas, el web scraping plantea problemas técnicos y éticos. Los sitios web cambian a menudo su estructura, lo que puede romper los scripts de raspado. Además, el manejo de grandes cantidades de datos requiere una infraestructura y una gestión sólidas. Por otra parte, es crucial garantizar que las actividades de scraping no infrinjan las condiciones de servicio o las normas éticas.

Consideraciones jurídicas y éticas

Cuando se trata del web scraping, es esencial comprender el panorama legal y ético. Aunque el scraping en sí no es ilegal, la forma en que se realiza puede plantear problemas legales.

Entender las condiciones de servicio

La mayoría de los sitios web tienen condiciones de servicio que describen las políticas de uso aceptable. El "scraping" de un sitio web que infrinja sus condiciones de servicio puede dar lugar a acciones legales, especialmente si se detecta la actividad de "scraping" y perjudica el funcionamiento del sitio web. Por lo tanto, es importante revisar y cumplir las condiciones de servicio de cualquier sitio que se proponga raspar.

Prácticas éticas de scraping

El scraping ético implica varias buenas prácticas para garantizar que el proceso sea respetuoso y legal:

- Respetar Robots.txt: Este archivo de los sitios web indica qué partes del sitio pueden y no pueden ser rastreadas. Respetar estas directrices es una práctica ética básica.

- Evitar una carga excesiva: El scraping puede sobrecargar el servidor de un sitio web. Limitar la frecuencia y el volumen de las solicitudes ayuda a evitar la sobrecarga del sitio.

- Atribución y uso: si se extraen datos para su publicación o análisis, es esencial citar debidamente la fuente. Además, es crucial no utilizar los datos para perjudicar al sitio original o a sus usuarios.

- Protección de datos personales: El scraping debe evitar recopilar datos personales a menos que se conceda un permiso explícito y se respete la normativa sobre privacidad de datos.

En resumen, aunque el web scraping ofrece potentes capacidades de recopilación y análisis de datos, debe realizarse de forma responsable. Comprender las implicaciones jurídicas y respetar las normas éticas son fundamentales para aprovechar esta tecnología de forma eficaz y sostenible.

Sección 3: Primeros pasos con BrickSeek Scraping

Herramientas y tecnologías

Embarcarse en un viaje de scraping de BrickSeek requiere las herramientas y tecnologías adecuadas. He aquí un resumen de los lenguajes de programación y bibliotecas esenciales que le ayudarán a alcanzar el éxito.

Lenguajes de programación recomendados

- Python: Ampliamente considerado como el lenguaje de referencia para el web scraping debido a su simplicidad y a la amplia gama de bibliotecas disponibles. La legibilidad de Python y el apoyo de la comunidad lo hacen ideal tanto para principiantes como para desarrolladores experimentados.

Bibliotecas esenciales

- BeautifulSoup: Una biblioteca de Python para analizar documentos HTML y XML. Crea un árbol de análisis de las páginas analizadas que puede utilizarse para extraer datos fácilmente.

- Scrapy: Un framework de rastreo web colaborativo y de código abierto para Python. Scrapy es potente y flexible, lo que le permite raspar y extraer datos de manera eficiente.

- Selenium: Una biblioteca de pruebas web que automatiza los navegadores. Resulta especialmente útil para analizar contenidos dinámicos generados por JavaScript, que las bibliotecas de análisis tradicionales podrían pasar por alto.

Configuración del entorno

Antes de empezar el scraping, debes configurar tu entorno. Aquí tienes una guía paso a paso para ayudarte a empezar.

Instalación del software y las bibliotecas necesarias

- Install Python: Ensure Python is installed on your system. You can download it from python.org.

- Crear un entorno virtual: Es una buena práctica crear un entorno virtual para su proyecto para gestionar las dependencias. Puede hacerlo utilizando venv.

python -m venv brickseek_scraper

source brickseek_scraper/bin/activate # On Windows, use `brickseek_scraper\Scripts\activate`- Instale las bibliotecas: Con tu entorno virtual activado, instala las librerías necesarias usando pip.

pip install beautifulsoup4 scrapy selenium requestsConfiguración básica de un proyecto BrickSeek Scraper

- Crear un directorio de proyectos:

mkdir brickseek_scraper

cd brickseek_scraper- Inicializar un proyecto Scrapy: Si estás usando Scrapy, inicializa un nuevo proyecto.

scrapy startproject brickseek

cd brickseek- Configuración de Selenium: Para Selenium, necesitará descargar el WebDriver apropiado para su navegador (por ejemplo, ChromeDriver para Google Chrome).

# Example for installing ChromeDriver

wget https://chromedriver.storage.googleapis.com/91.0.4472.101/chromedriver_linux64.zip

unzip chromedriver_linux64.zip

mv chromedriver /usr/local/bin/- Araña Scrapy básica: Crear una araña Scrapy simple para empezar a raspar BrickSeek.

# brickseek/brickseek/spiders/brickseek_spider.py

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ["https://brickseek.com/"]

def parse(self, response):

self.log('Visited %s' % response.url)- Ejecute su araña: Ejecute la araña para ver si todo está configurado correctamente.

scrapy crawl brickseekAl configurar su entorno con estas herramientas y tecnologías, estará listo para empezar a extraer datos de BrickSeek. Esta preparación le garantiza una base sólida para crear tareas de scraping más complejas y gestionar los datos de forma eficiente.

Sección 4: Construyendo su BrickSeek Scraper

Guía paso a paso del rascador BrickSeek

Construir un scraper BrickSeek implica varios pasos, desde la identificación de los datos de destino hasta la escritura del código que extrae esta información. Desglosémoslo.

Identificación de los datos de destino (URL, elementos HTML):

- Comience explorando BrickSeek: Visite BrickSeek y navegue hasta las páginas que desea raspar. Observe los patrones de URL, las páginas de productos y la estructura del HTML.

- Utilice las herramientas para desarrolladores: Abra las herramientas de desarrollo de su navegador (normalmente con F12 o haciendo clic con el botón derecho y seleccionando "Inspeccionar"). Inspecciona los elementos HTML que contienen los datos que te interesan (como precios, estado del inventario y detalles del producto).

Escribir un Scraper básico con BeautifulSoup/Scrapy

- Utilizando BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Define the URL of the page to scrape

url = 'https://brickseek.com/deal/'

# Send a GET request to the URL

response = requests.get(url)

# Parse the HTML content using BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

# Extract data (e.g., prices, inventory, product details)

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- Uso de Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Gestión de contenidos dinámicos

A veces, el contenido que necesita se carga dinámicamente mediante JavaScript. He aquí cómo manejarlo.

Uso de Selenium para contenido renderizado en JavaScript:

- Configurar Selenium:

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from selenium.webdriver.chrome.options import Options

chrome_options = Options()

chrome_options.add_argument("--headless")

service = Service('path/to/chromedriver')

driver = webdriver.Chrome(service=service, options=chrome_options)

driver.get('https://brickseek.com/deal/')

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')

driver.quit()Técnicas para tratar con AJAX y otros elementos dinámicos

Esperar a que se carguen los elementos: Utiliza esperas explícitas para asegurarte de que los elementos se han cargado antes de intentar extraer datos.

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

driver.get('https://brickseek.com/deal/')

WebDriverWait(driver, 10).until(

EC.presence_of_element_located((By.CLASS_NAME, 'item'))

)

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')Manejo del desplazamiento infinito: En las páginas con desplazamiento infinito, es posible que tenga que desplazarse hacia abajo para cargar más contenido.

import time

driver.get('https://brickseek.com/deal/')

last_height = driver.execute_script("return document.body.scrollHeight")

while True:

driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(2)

new_height = driver.execute_script("return document.body.scrollHeight")

if new_height == last_height:

break

last_height = new_height

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')Siguiendo estos pasos, puede crear un raspador BrickSeek robusto que maneje eficazmente contenido estático y dinámico y extraiga datos valiosos sin problemas.

Sección 5: Mejorar su rascador

Para mejorar tu BrickSeek scraper, debes incorporar técnicas avanzadas que garanticen su eficacia y longevidad. En esta sección se tratan los proxies para enmascarar tu identidad y evitar prohibiciones y los métodos para imitar el comportamiento humano y pasar desapercibido.

Implantación de proxies

¿Por qué utilizar proxies?

Los proxies son esenciales para el web scraping, especialmente cuando se trata de sitios con estrictas medidas anti-scraping. A continuación te explicamos por qué deberías considerar el uso de proxies:

- Anonymity: Proxies hide your IP address, making your requests appear from different locations.

- Evitar bloqueos: El uso de múltiples proxies puede distribuir sus peticiones, reduciendo la posibilidad de ser bloqueado por tráfico excesivo.

- Acceso a contenidos con restricciones geográficas: Los proxies pueden hacer que tus peticiones parezcan proceder de un país concreto, lo que te permite acceder a datos bloqueados por regiones.

Configuración de IPBurger Proxies para su Scraper

Using IPBurger proxies is straightforward. Here’s how to integrate them into your BrickSeek scraper:

- Regístrate en IPBurger:

- Visit IPBurger’s website and sign up for a proxy plan that fits your needs.

- Obtenga los datos de su proxy, incluida la dirección IP, el puerto, el nombre de usuario y la contraseña.

- Configure proxies en su código:

With Requests and BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Proxy details

proxies = {

'http': 'http://username:password@proxy_ip:proxy_port',

'https': 'https://username:password@proxy_ip:proxy_port'

}

url = 'https://brickseek.com/deal/'

response = requests.get(url, proxies=proxies)

soup = BeautifulSoup(response.text, 'html.parser')

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- Con Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def start_requests(self):

for url in self.start_urls:

yield scrapy.Request(url=url, callback=self.parse, meta={

'proxy': 'http://username:password@proxy_ip:proxy_port'

})

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}Evitar prohibiciones y límites de tarifa

Debe aplicar técnicas que imiten el comportamiento de navegación humano para evitar que su scraper sea detectado y prohibido.

Técnicas para imitar el comportamiento humano

- Aleatorizar agentes de usuario:

- Rote las cadenas de agente de usuario para que las solicitudes parezcan proceder de distintos navegadores.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (X11; Ubuntu; Linux x86_64; rv:89.0) Gecko/20100101 Firefox/89.0',

# Add more user agents as needed

]

headers = {

'User-Agent': random.choice(user_agents)

}response = requests.get(url, headers=headers, proxies=proxies)

- Aplicación de retardos e intervalos aleatorios:

- Introducir retrasos entre las solicitudes para imitar los patrones naturales de navegación.

- Utilice intervalos aleatorios para evitar crear un patrón predecible.

import time

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')

# Random delay between requests

time.sleep(random.uniform(1, 3))Mediante la integración de proxies y la simulación del comportamiento humano, puede mejorar significativamente la eficacia y la longevidad de su raspador BrickSeek, garantizando que funcione sin problemas y sin ser detectado durante largos periodos.

Sección 6: Gestión y almacenamiento de datos

Una vez que haya obtenido con éxito los datos de BrickSeek, el siguiente paso crucial es gestionar y almacenar estos datos de manera eficiente. Esta sección le guiará a través de diferentes métodos de almacenamiento de sus datos raspados y cómo limpiarlos y formatearlos para su posterior análisis.

Almacenamiento de datos

Opciones de almacenamiento de datos

Dependiendo del volumen y la complejidad de los datos, tiene varias opciones para almacenar sus datos raspados:

- Archivos CSV:

- Sencillo y fácil de usar para conjuntos de datos pequeños.

- Compatible con la mayoría de herramientas y programas de análisis de datos.

- Ideal para análisis y visualización rápidos.

- Bases de datos:

- Más adecuado para grandes conjuntos de datos y consultas más complejas.

- Las opciones incluyen SQLite para almacenamiento local y MySQL o PostgreSQL para soluciones más robustas y escalables.

- Proporciona una mayor integridad de los datos y facilita el acceso para su análisis.

- Almacenamiento en la nube:

- Para proyectos de scraping a gran escala que requieren soluciones de almacenamiento distribuido.

- Las opciones incluyen AWS S3, Google Cloud Storage o Azure Blob Storage.

- Ofrece alta disponibilidad y escalabilidad.

Escritura de datos en archivos

A continuación te explicamos cómo puedes escribir tus datos raspados en un archivo CSV o en una base de datos:

Escribir en un archivo CSV:

import csv

data = [

{'title': 'Deal 1', 'price': '$10'},

{'title': 'Deal 2', 'price': '$15'},

# Add more data as needed

]

with open('deals.csv', mode='w', newline='') as file:

writer = csv.DictWriter(file, fieldnames=['title', 'price'])

writer.writeheader()

for item in data:

writer.writerow(item)Escribir en una base de datos SQLite:

import sqlite3

# Connect to the SQLite database (or create it if it doesn't exist)

conn = sqlite3.connect('deals.db')

cursor = conn.cursor()

# Create a table

cursor.execute('''

CREATE TABLE IF NOT EXISTS deals (

id INTEGER PRIMARY KEY,

title TEXT,

price TEXT

)

''')

# Insert data into the table

data = [

('Deal 1', '$10'),

('Deal 2', '$15'),

# Add more data as needed

]

cursor.executemany('INSERT INTO deals (title, price) VALUES (?, ?)', data)

conn.commit()

# Close the connection

conn.close()Limpieza y formateo de datos

Los datos en bruto extraídos de sitios web a menudo necesitan limpieza y formateo antes de ser analizados. He aquí algunas técnicas básicas para preparar los datos.

Técnicas básicas de limpieza de datos

Eliminar duplicados:

- Asegúrese de que cada entrada de su conjunto de datos es única.

import pandas as pd

df = pd.read_csv('deals.csv')

df.drop_duplicates(inplace=True)

df.to_csv('deals_cleaned.csv', index=False)Tratamiento de valores perdidos:

- Rellene los valores que faltan o elimine las entradas con datos ausentes.

df = pd.read_csv('deals.csv')

df.dropna(inplace=True) # Remove rows with missing values

df.fillna('N/A', inplace=True) # Fill missing values with 'N/A'

df.to_csv('deals_cleaned.csv', index=False)Normalización de formatos de datos:

- Garantizar la coherencia de los formatos de los datos (por ejemplo, formatos de precios, formatos de fechas).

df['price'] = df['price'].str.replace('$', '').astype(float)

df.to_csv('deals_cleaned.csv', index=False)Estructurar los datos para el análisis

Organización de datos en tablas:

- Estructure sus datos en tablas con encabezados claros y tipos de datos coherentes.

- En el caso de las bases de datos relacionales, asegúrese de que la normalización y las relaciones entre tablas son correctas.

Utilización de marcos de datos:

- Los DataFrames, como los que proporciona Pandas en Python, ofrecen potentes herramientas de manipulación y análisis de datos.

import pandas as pd

df = pd.read_csv('deals_cleaned.csv')

# Perform analysis and manipulationsSi gestiona y almacena eficazmente los datos obtenidos, se asegurará de que estén listos para su análisis y uso posterior. Unas prácticas adecuadas de gestión de datos le ahorrarán tiempo y esfuerzo, y harán que su proceso de análisis de datos sea más fluido y eficiente.

Sección 7: Análisis y uso de los datos

Una vez que haya obtenido y almacenado sus datos de BrickSeek, el siguiente paso es analizarlos para extraer información valiosa. Esta sección le guiará a través de técnicas básicas y avanzadas de análisis de datos para ayudarle a sacar el máximo provecho de los datos recogidos.

Análisis básico de datos

Herramientas y técnicas para analizar datos raspados

Excel/Hojas de cálculo de Google:

- Utilización: Ideal para el análisis rápido y directo de datos.

- Técnicas:

- Clasificación y filtrado de datos.

- Utilización de tablas dinámicas para resumir y explorar datos.

- Aplicación de fórmulas y funciones para cálculos y transformaciones.

Pandas (Biblioteca Python):

- Utilización: Potente herramienta de manipulación y análisis de datos.

- Técnicas:

- Lectura de datos en DataFrames para análisis estructurados.

- Realización de estadísticas descriptivas (media, mediana, desviación típica).

- Agrupar y agregar datos para encontrar patrones.

import pandas as pd

# Load data into a DataFrame

df = pd.read_csv('deals_cleaned.csv')

# Basic statistics

print(df.describe())

# Group by a specific column and aggregate

grouped = df.groupby('category').mean()

print(grouped)Herramientas de visualización (Matplotlib, Seaborn, Tableau):

- Utilización: Visualizar datos para identificar tendencias y patrones.

- Técnicas:

- Creación de gráficos de líneas, diagramas de barras, histogramas y diagramas de dispersión.

- Utilización de mapas térmicos para el análisis de correlaciones.

import matplotlib.pyplot as plt

import seaborn as sns

# Plot a histogram of prices

sns.histplot(df['price'], bins=20, kde=True)

plt.show()

# Create a bar chart

df['category'].value_counts().plot(kind='bar')

plt.show()Patrones y perspectivas

- Análisis de tendencias:

- Busque tendencias a lo largo del tiempo, como fluctuaciones de precios, descuentos estacionales o cambios en los niveles de existencias.

- Ejemplo: Identificar los periodos con mayores descuentos en determinadas categorías de productos.

- Análisis comparativo:

- Compara precios entre distintos minoristas para encontrar las mejores ofertas.

- Ejemplo: Comparar el precio medio de un producto en diferentes plataformas.

- Análisis de correlación:

- Determinar las relaciones entre distintas variables.

- Ejemplo: Correlacionar los precios de los productos con los niveles de inventario para comprender la dinámica de la oferta y la demanda.

Análisis avanzado

Uso del aprendizaje automático para obtener información predictiva

Modelización predictiva:

- Aplicar algoritmos de aprendizaje automático para predecir tendencias futuras a partir de datos históricos.

- Ejemplo: Predecir los precios futuros de los productos a partir de datos pasados utilizando modelos de regresión.

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

# Prepare data for modeling

X = df[['feature1', 'feature2']] # Replace with relevant features

y = df['price']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Train a regression model

model = LinearRegression()

model.fit(X_train, y_train)

# Make predictions

predictions = model.predict(X_test)Agrupación:

- Utilice algoritmos de agrupación para segmentar los productos en categorías basadas en similitudes.

- Ejemplo: Agrupar productos por rango de precios, categoría y popularidad para identificar clusters diferenciados.

from sklearn.cluster import KMeans

# Prepare data for clustering

features = df[['feature1', 'feature2']] # Replace with relevant features

# Perform K-means clustering

kmeans = KMeans(n_clusters=3, random_state=42)

df['cluster'] = kmeans.fit_predict(features)Integración con otras fuentes de datos para un análisis más rico

- Combinación de conjuntos de datos:

- Integre los datos de BrickSeek con otras fuentes de datos como datos de ventas, opiniones de clientes o precios de la competencia para obtener un análisis completo.

- Ejemplo: Combinar los datos de precios de BrickSeek con los datos de rendimiento de ventas para analizar el impacto de las estrategias de precios en las ventas.

- API y bases de datos:

- Utilice las API para obtener datos adicionales o conectarse a bases de datos externas para realizar análisis más exhaustivos.

- Ejemplo: Utilización de API de comercio electrónico para obtener datos en tiempo real sobre la disponibilidad y las opiniones de los productos.

- Cuadros de mando de visualización de datos:

- Cree cuadros de mando interactivos utilizando herramientas como Tableau, Power BI o Plotly Dash para visualizar los datos integrados y supervisar las métricas clave.

- Ejemplo: Creación de un panel de control en tiempo real para seguir las tendencias de precios, los cambios en el inventario y los precios de la competencia.

Estas técnicas básicas y avanzadas de análisis de datos pueden revelar información valiosa a partir de sus datos de BrickSeek, lo que le permitirá tomar decisiones informadas, optimizar sus estrategias y mantenerse a la cabeza del mercado competitivo.

Sección 8: Solución de problemas y optimización

Construir un raspador BrickSeek puede ser gratificante, pero como cualquier tarea compleja, viene con sus propios desafíos. Esta sección le ayudará a solucionar problemas comunes y a optimizar su raspador para obtener el mejor rendimiento, asegurándose de que obtiene el máximo provecho de sus esfuerzos de extracción de datos.

Problemas comunes y soluciones

Errores y problemas comunes

- Errores HTTP (404, 500, etc.):

- Problema: es posible que encuentre errores HTTP durante el scraping, como 404 (Not Found) o 500 (Internal Server Error).

- Solución: Implementar el manejo de errores en su scraper para gestionar estos errores con gracia. Utiliza bloques try-except para capturar excepciones y reintentar la solicitud tras un breve retardo.

import requests

from time import sleep

url = 'http://example.com'

for attempt in range(5):

try:

response = requests.get(url)

response.raise_for_status() # Raises an HTTPError for bad responses

break # Exit loop if request is successful

except requests.exceptions.RequestException as e:

print(f'Error: {e}, retrying...')

sleep(5)- CAPTCHA y medidas anti-bot:

- Problema: los sitios web suelen utilizar CAPTCHAs y otros mecanismos anti-bot para evitar el scraping.

- Solution: Use IP rotation with proxies, and consider integrating CAPTCHA-solving services if necessary. Implement delays and random intervals between requests to mimic human behavior.

import random

from time import sleep

delay = random.uniform(2, 5) # Random delay between 2 and 5 seconds

sleep(delay)- Contenido renderizado en JavaScript:

- Problema: parte del contenido de BrickSeek puede generarse mediante JavaScript, que los raspadores estáticos como BeautifulSoup no pueden manejar.

- Solución: Utilizar Selenium para manejar contenido renderizado en JavaScript.

from selenium import webdriver

driver = webdriver.Chrome()

driver.get('http://example.com')

content = driver.page_source- Direcciones IP bloqueadas:

- Problema: Su dirección IP puede quedar bloqueada debido a las frecuentes solicitudes.

- Solution: Use IPBurger proxies to rotate IP addresses and avoid detection.

proxy = "http://proxyserver:port"

proxies = {

"http": proxy,

"https": proxy,

}

response = requests.get(url, proxies=proxies)Optimizar el rendimiento de su rascador

- Extracción eficaz de datos:

- Minimice los datos que solicita dirigiéndose a elementos y atributos HTML específicos.

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

price = soup.find('span', {'class': 'price'}).text- Solicitudes concurrentes:

- Utilice bibliotecas asíncronas como aiohttp o multithreading para realizar peticiones concurrentes y acelerar la extracción de datos.

import asyncio

import aiohttp

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main(urls):

async with aiohttp.ClientSession() as session:

tasks = [fetch(session, url) for url in urls]

return await asyncio.gather(*tasks)

urls = ['http://example.com/page1', 'http://example.com/page2']

loop = asyncio.get_event_loop()

pages = loop.run_until_complete(main(urls))- Almacenamiento en caché y estrangulamiento:

- Aplique el almacenamiento en caché para evitar solicitudes redundantes de los mismos datos, y regule las solicitudes para evitar la sobrecarga del servidor.

from cachetools import TTLCache

cache = TTLCache(maxsize=100, ttl=300)

def get_page(url):

if url in cache:

return cache[url]

response = requests.get(url)

cache[url] = response.text

return response.textTrucos y consejos avanzados

Consejos de expertos para aprovechar al máximo su rascador BrickSeek

- Agentes de usuario dinámicos:

- Rote los agentes de usuario para simular distintos navegadores y reducir la probabilidad de ser bloqueado.

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_11_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36',

# Add more user agents

]

headers = {'User-Agent': random.choice(user_agents)}

response = requests.get(url, headers=headers)- Persistencia de la sesión:

- Utilice objetos de sesión para persistir cookies y cabeceras a través de múltiples solicitudes, lo que puede ayudar a mantener las sesiones de inicio de sesión y reducir la detección.

session = requests.Session()

session.headers.update({'User-Agent': random.choice(user_agents)})

response = session.get(url)Estrategias de mejora continua

- Mantenimiento periódico:

- Actualice regularmente su raspador para adaptarse a los cambios en la estructura del sitio web de BrickSeek. La supervisión automatizada puede avisarle de las actualizaciones necesarias.

import requests

def monitor_changes(url, current_structure):

response = requests.get(url)

new_structure = response.text

if new_structure != current_structure:

print("Website structure has changed!")

# Update scraper logic here- Bucle de retroalimentación:

- Implemente un bucle de retroalimentación para aprender de los errores y las métricas de rendimiento, perfeccionando continuamente su rascador para mejorar la eficacia y la precisión.

import logging

logging.basicConfig(filename='scraper.log', level=logging.INFO)

def log_error(error):

logging.error(f"Error occurred: {error}")

try:

response = requests.get(url)

response.raise_for_status()

except requests.exceptions.RequestException as e:

log_error(e)Siguiendo estas técnicas de solución de problemas y optimización se asegura de que su raspador BrickSeek funciona sin problemas, eficiente y eficazmente, proporcionando datos valiosos para sus diversas necesidades.

Conclusión

Recapitulación de los puntos clave

Construir un raspador BrickSeek puede abrir un mundo de oportunidades para el seguimiento de precios, la búsqueda de ofertas y la gestión de inventario. A lo largo de esta guía, hemos cubierto:

- Conozca BrickSeek: Desde su historia y desarrollo hasta sus características clave y casos de uso.

- Fundamentos del Web Scraping: Definición del web scraping, sus ventajas y dificultades, y la importancia de las consideraciones éticas.

- Primeros pasos: Herramientas, tecnologías y configuración del entorno para el web scraping.

- Construyendo tu Scraper: Guía paso a paso para escribir un scraper básico, manejar contenido dinámico y extraer datos relevantes.

- Mejora de tu Scraper: Implementarproxies, evitar prohibiciones e imitar el comportamiento humano para garantizar un funcionamiento sin problemas.

- Gestión de datos: Almacenamiento, limpieza y formateo de los datos para su análisis.

- Análisis y uso de datos: Herramientas y técnicas para integrar el análisis básico y avanzado de datos con otras fuentes de datos.

- Solución de problemas y optimización: Manejo de problemas comunes, optimización del rendimiento y consejos avanzados para mejorar su scraper.

Tendencias futuras

A medida que evoluciona la tecnología, también lo hace el panorama del web scraping y el análisis de datos. He aquí algunas tendencias a tener en cuenta:

- Tecnologías emergentes en el raspado web: El uso de la IA y el aprendizaje automático para crear scrapers más sofisticados y eficientes, capaces de adaptarse a las estructuras cambiantes de los sitios web y extraer datos más ricos.

- El futuro del seguimiento de precios y la gestión de inventarios: Surgirán herramientas y plataformas más avanzadas, que proporcionarán datos y perspectivas en tiempo real para estrategias de precios dinámicas, una mejor gestión del inventario y mejores experiencias para los clientes.

Mejora de tu Web Scraping con IPBurger

Implementar proxies es crucial para construir un raspador web eficiente y fiable. Los proxies le ayudan a evitar las prohibiciones de IP, distribuir las solicitudes y mantener el anonimato durante el raspado de datos. IPBurger ofrece una gama de servicios de proxy de alta calidad, incluyendo proxies residenciales, móviles y de centros de datos, adaptados para satisfacer las necesidades de los raspadores web.

- Seguridad y anonimato: Los proxies de IPBurger garantizan que sus actividades de scraping permanezcan anónimas y seguras, protegiendo sus datos de ser rastreados o interceptados.

- Avoiding Bans: By rotating IP addresses and mimicking human behavior, IPBurger’s proxies help you avoid detection and bans, ensuring uninterrupted scraping.

- Alcance global: Acceda a datos de diferentes ubicaciones geográficas utilizando la red global de proxies de IPBurger, mejorando su capacidad para realizar raspados y análisis localizados.

Ahora que usted entiende la construcción de un raspador BrickSeek exhaustivamente, es el momento de poner en práctica sus conocimientos. Comience su proyecto de scraping hoy y explore los beneficios de automatizar su seguimiento de precios y gestión de inventario. No olvide aprovechar los servicios proxy de IPBurger para mejorar sus esfuerzos de scraping y garantizar una recopilación de datos fiable y segura.

Te animamos a compartir tus experiencias, retos y consejos en la sección de comentarios. Tus ideas pueden ayudar a otros miembros de la comunidad y contribuir a la mejora continua de las técnicas de web scraping.

¡Feliz raspado!