讓我們談談 BrickSeek Scraper。

如果您曾經在網上尋找過交易,您可能會偶然發現這顆寶石。BrickSeek 就像您的個人交易偵探,在網上搜索以找到各種零售商的最佳產品價格。它最初旨在幫助購物者在當地商店找到最優惠的商品價格,現已發展成為任何希望節省一兩美元或更多錢的人的強大工具。

BrickSeek的魔力在於其實時跟蹤價格和庫存的能力。無論您是討價還價的獵人、希望優化庫存的轉銷商,還是喜歡划算的人,BrickSeek 都能提供一些東西。想像一下,確切地知道那台難以捉摸的打折電視在哪裡有貨,或者發現你的孩子一直在乞求的玩具在幾英里外的一家商店裡打了一半的折扣。這就是價格跟蹤和庫存管理的力量。

網頁抓取簡介

現在,讓我們轉向網路抓取。這聽起來很有技術含量,但不要讓它嚇跑你。從本質上講,網路抓取是關於自動化從網站收集數據的過程。網路爬蟲無需手動檢查十幾個網站的價格下跌或庫存更新,而是為您完成繁重的工作,將數據提取為整潔、可用的格式。

把它想像成有一個超級勤奮的助手,他從不睡覺,不斷檢查更新並返回你需要的資訊。網頁抓取旨在使數據收集更快、更高效、更乏味。

但是,權力越大,責任越大。有一些道德考慮需要牢記。並非每個網站都希望其數據被抓取,有些網站的服務條款明確禁止它。還有法律方面——以錯誤的方式刮擦會讓你陷入困境。因此,了解規則和公平競爭至關重要。道德抓取意味著尊重網站政策,不要讓伺服器有過多的請求,最重要的是,不要將數據用於惡意目的。

因此,無論您是數據書、精明的購物者,還是只是喜歡保持領先地位的人,瞭解 BrickSeek 和網路抓取的來龍去脈都可以打開一個充滿可能性的世界。而且,正如我們將看到的,這不僅僅是為了省錢,而是為了更聰明地利用你的時間和資源。

第 1 部分:瞭解 BrickSeek

什麼是 BrickSeek?

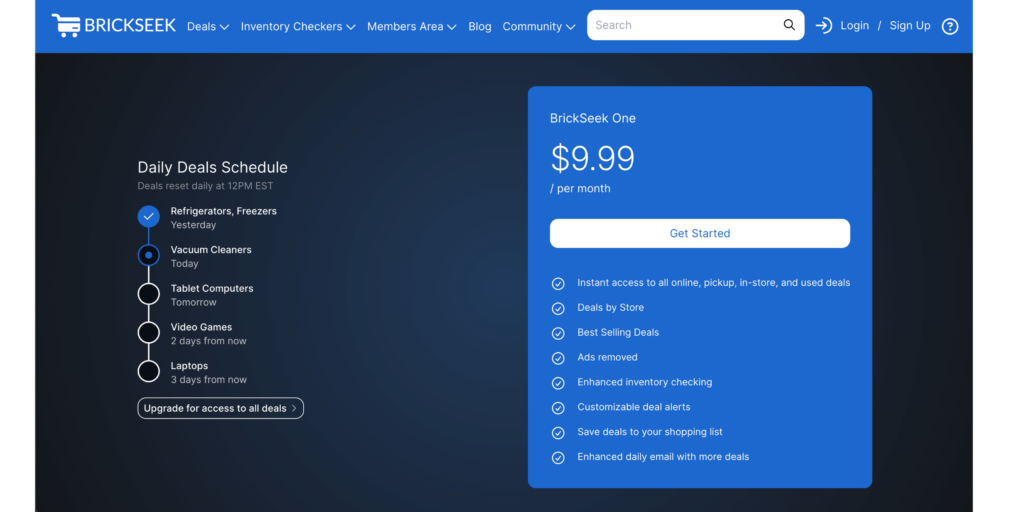

BrickSeek 是一種價格跟蹤和庫存檢查工具,在討價還價者和精明的購物者中聲名鵲起。它的推出旨在幫助人們在當地商店找到最優惠的價格,現已發展成為一個強大的平臺,提供各種功能,以滿足廣泛的受眾需求。

歷史與發展:

BrickSeek 最初是沃爾瑪的簡單庫存跟蹤器,後來擴展到包括 Target、Lowe's、Office Depot 等主要零售商。它的發展是由消費者日益增長的需求推動的,他們需要做出明智的購買決定,而無需訪問多家商店或網站。如今,BrickSeek擁有使用者友好的介面和強大的後端,可以即時收集和更新數據。

主要特點和優勢:

- 價格提醒: 使用者可以為特定產品設置警報,確保他們不會錯過降價或缺貨通知。

- 庫存跟蹤:即時更新多個零售商的產品可用性。

- 交易尋找器: 熱門交易和清倉商品的精選清單。

- 本地降價源:有關本地商店降價和清倉商品的資訊。

- 線上交易: 專門用於在線獨家優惠和折扣的部分。

這些功能通過整合原本需要數小時手動搜索的資訊來説明用戶節省金錢和時間。

BrickSeek 的用例

尋找優惠和折扣: BrickSeek 的主要用途之一是找到最優惠的價格和折扣。無論是熱門的新技術產品、家庭必需品還是兒童玩具,BrickSeek 都可以説明您找到最優惠的在線和店內價格。憑藉其價格提醒和交易查找器功能,您可以領先於銷售和促銷活動,而無需經常查看多個網站。

轉銷商的庫存跟蹤: 對於經銷商來說,在不同商店之間保持庫存可能是一場物流噩夢。BrickSeek 透過提供即時庫存數據來簡化這一過程。這對於那些批量購買產品以轉售獲利的人來說特別有用。了解產品的可用位置和時間使轉銷商能夠更有效地計劃他們的購買並避免缺貨。

精明購物者的價格比較: 對於那些希望確保物有所值的人來說,BrickSeek 的價格比較功能非常寶貴。通過比較多個零售商的價格,購物者可以確保他們不會多付錢。這在黑色星期五、網路星期一等重大購物活動或價格快速波動的返校銷售期間特別有用。

BrickSeek 是一種多功能工具,可滿足從休閒交易獵人到專業轉銷商的不同需求。它能夠提供準確、實時的數據,使其成為任何希望節省金錢和時間的人的重要資源。

第2部分:網頁抓取的基礎知識

什麼是網頁抓取?

網路抓取是從網站自動提取數據的過程。此技術通常用於收集大量數據,這些數據非常耗時或難以手動收集。使用軟體或腳本,網路抓取可以自動檢索信息,從而可以大規模收集和分析數據。

定義和常見應用

網路抓取涉及使用自動機器人訪問網站、解析 HTML 並提取有用的資訊。這可能包括產品價格、庫存可用性、客戶評論等。然後可以出於各種目的存儲和分析提取的數據。

網頁抓取的常見應用包括

- 價格監控: 跟蹤多個網站的價格以找到最優惠的價格。

- 市場調查: 收集有關競爭對手的產品、價格和客戶反饋的數據。

- 內容聚合: 從各種來源收集文章、博客或新聞,以進行全面概述。

- 資料挖掘: 提取大型數據集,用於金融、醫療保健和電子商務領域的分析。

優勢和挑戰

- 好處: 網頁抓取可以通過自動收集數據來節省時間和資源。它提供最新和全面的數據集,從而實現更好的決策和戰略規劃。對於企業來說,這意味著通過跟上市場趨勢和消費者行為來保持競爭力。

- 挑戰: 儘管有其優勢,但網路抓取仍存在技術和道德挑戰。網站經常更改其結構,這可能會破壞抓取腳本。此外,處理大量數據需要強大的基礎架構和管理。此外,確保抓取活動不違反服務條款或道德標準至關重要。

法律和道德考量

在網路抓取方面,瞭解法律和道德環境至關重要。雖然抓取本身並不違法,但如何進行可能會引發法律問題。

瞭解服務條款

大多數網站都有服務條款 (ToS),其中概述了可接受的使用政策。抓取違反其服務條款的網站可能會導致法律訴訟,尤其是在檢測到抓取活動並損害網站運營的情況下。因此,查看並遵守您打算抓取的任何網站的服務條款非常重要。

合乎道德的抓取實踐

道德抓取涉及幾個最佳實踐,以確保該過程是尊重和合法的:

- 尊重Robots.txt: 網站上的此檔指示網站的哪些部分可以抓取,哪些部分不能抓取。遵守這些準則是一種基本的道德實踐。

- 避免過載: 抓取會給網站的伺服器帶來壓力。限制請求的頻率和數量有助於避免網站過載。

- 歸屬和使用: 如果數據被抓取用於發佈或分析,則必須對來源給予適當的信用。此外,使用數據不傷害原始網站或其使用者也至關重要。

- 個人資料保護: 抓取應避免收集個人數據,除非獲得明確許可並遵守數據隱私法規。

總之,雖然網路抓取提供了強大的數據收集和分析功能,但必須負責任地進行。瞭解法律影響並遵守道德標準是有效和可持續地利用這項技術的關鍵。

第 3 部分:BrickSeek 抓取入門

工具和技術

踏上 BrickSeek 抓取之旅需要正確的工具和技術。以下是基本程式設計語言和庫的概要,它們將為您取得成功奠定基礎。

推薦的程式設計語言

- 蟒: 由於其簡單性和大量可用的庫,被廣泛認為是網路抓取的首選語言。Python 的可讀性和社區支援使其成為初學者和有經驗的開發人員的理想選擇。

基本庫

- 美麗的湯: 用於解析 HTML 和 XML 文件的 Python 庫。它為解析的頁面創建解析樹,可用於輕鬆提取數據。

- 刮擦: Python 的開源協作式 Web 爬蟲框架。Scrapy 功能強大且靈活,可讓您有效地抓取和提取數據。

- 硒: 一個自動化瀏覽器的 Web 測試庫。它對於抓取由 JavaScript 呈現的動態內容特別有用,而傳統的抓取庫可能會錯過這些內容。

設置環境

在開始抓取之前,您必須設置您的環境。以下是説明您入門的分步指南。

安裝必要的軟體和庫

- Install Python: Ensure Python is installed on your system. You can download it from python.org.

- 設定虛擬環境: 最好為專案創建一個虛擬環境來管理依賴項。您可以使用 venv 執行此操作。

python -m venv brickseek_scraper

source brickseek_scraper/bin/activate # On Windows, use `brickseek_scraper\Scripts\activate`- 安裝庫: 激活虛擬環境后,使用 pip 安裝必要的庫。

pip install beautifulsoup4 scrapy selenium requestsBrickSeek Scraper 專案的基本設置

- 建立項目目錄:

mkdir brickseek_scraper

cd brickseek_scraper- 初始化 Scrapy 專案: 如果您使用的是 Scrapy,請初始化一個新專案。

scrapy startproject brickseek

cd brickseek- 設定 Selenium: 對於 Selenium,您需要為您的瀏覽器下載相應的 WebDriver(例如,適用於 Google Chrome 的 ChromeDriver)。

# Example for installing ChromeDriver

wget https://chromedriver.storage.googleapis.com/91.0.4472.101/chromedriver_linux64.zip

unzip chromedriver_linux64.zip

mv chromedriver /usr/local/bin/- 基本 Scrapy Spider: 創建一個簡單的 Scrapy 蜘蛛來開始抓取 BrickSeek。

# brickseek/brickseek/spiders/brickseek_spider.py

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ["https://brickseek.com/"]

def parse(self, response):

self.log('Visited %s' % response.url)- 執行你的蜘蛛: 執行爬蟲以查看所有設置是否正確。

scrapy crawl brickseek通過使用這些工具和技術設置您的環境,您就可以開始從 BrickSeek 抓取數據了。這種準備工作可確保您為構建更複雜的抓取任務和高效處理數據奠定堅實的基礎。

第 4 部分:構建您的 BrickSeek 刮刀

BrickSeek Scraper 分步指南

構建 BrickSeek 抓取工具涉及幾個步驟,從識別目標數據到編寫提取此資訊的代碼。讓我們來分解一下。

識別目標資料(URL、HTML 元素):

- 從探索 BrickSeek 開始: 訪問 BrickSeek 並導航到要抓取的頁面。查看 URL 模式、產品頁面和 HTML 的結構。

- 使用開發人員工具: 打開瀏覽器的開發人員工具(通常使用 F12 或右鍵按兩下並選擇“檢查”)。檢查包含您感興趣的數據(如價格、庫存狀態和產品詳細資訊)的 HTML 元素。

使用 BeautifulSoup/Scrapy 編寫基本刮板

- 使用 BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Define the URL of the page to scrape

url = 'https://brickseek.com/deal/'

# Send a GET request to the URL

response = requests.get(url)

# Parse the HTML content using BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

# Extract data (e.g., prices, inventory, product details)

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- 使用 Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}處理動態內容

有時,您需要的內容是使用 JavaScript 動態載入的。這是如何處理它。

將 Selenium 用於 JavaScript 渲染的內容:

- 設置 Selenium:

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from selenium.webdriver.chrome.options import Options

chrome_options = Options()

chrome_options.add_argument("--headless")

service = Service('path/to/chromedriver')

driver = webdriver.Chrome(service=service, options=chrome_options)

driver.get('https://brickseek.com/deal/')

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')

driver.quit()處理 AJAX 和其他動態元素的技術

等待元素載入: 使用顯式等待來確保在嘗試提取數據之前已載入元素。

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

driver.get('https://brickseek.com/deal/')

WebDriverWait(driver, 10).until(

EC.presence_of_element_located((By.CLASS_NAME, 'item'))

)

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')處理無限捲動: 對於無限滾動的頁面,您可能需要向下滾動以載入更多內容。

import time

driver.get('https://brickseek.com/deal/')

last_height = driver.execute_script("return document.body.scrollHeight")

while True:

driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(2)

new_height = driver.execute_script("return document.body.scrollHeight")

if new_height == last_height:

break

last_height = new_height

deals = driver.find_elements(By.CLASS_NAME, 'item')

for deal in deals:

title = deal.find_element(By.TAG_NAME, 'h2').text.strip()

price = deal.find_element(By.CLASS_NAME, 'price').text.strip()

print(f'Title: {title}, Price: {price}')通過執行這些步驟,您可以構建一個強大的 BrickSeek 抓取工具,該抓取工具可以有效處理靜態和動態內容並無縫提取有價值的數據。

第5節:增強您的刮刀

要改進您的 BrickSeek 刮刀,您必須採用先進的技術來確保其效率和使用壽命。本節介紹用於掩蓋您的身份並避免模仿人類行為的禁令和方法以保持低調的代理。

實現代理

為什麼要使用代理?

代理對於網路抓取至關重要,尤其是在針對具有嚴格反抓取措施的網站時。以下是您應該考慮使用代理的原因:

- Anonymity: Proxies hide your IP address, making your requests appear from different locations.

- 避免禁令: 使用多個代理可以分發您的請求,從而減少因流量過多而被阻止的機會。

- 存取受地理限制的內容: 代理可以使您的請求看起來好像來自特定國家/地區,從而允許您訪問區域鎖定的數據。

為您的抓取工具設置IPBurger代理

Using IPBurger proxies is straightforward. Here’s how to integrate them into your BrickSeek scraper:

- 註冊IPBurger:

- Visit IPBurger’s website and sign up for a proxy plan that fits your needs.

- 獲取您的代理詳細資訊,包括IP位址、埠、使用者名和密碼。

- 在代碼設定代理:

有要求和 BeautifulSoup:

import requests

from bs4 import BeautifulSoup

# Proxy details

proxies = {

'http': 'http://username:password@proxy_ip:proxy_port',

'https': 'https://username:password@proxy_ip:proxy_port'

}

url = 'https://brickseek.com/deal/'

response = requests.get(url, proxies=proxies)

soup = BeautifulSoup(response.text, 'html.parser')

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')- 使用 Scrapy:

import scrapy

class BrickseekSpider(scrapy.Spider):

name = "brickseek"

start_urls = ['https://brickseek.com/deal/']

def start_requests(self):

for url in self.start_urls:

yield scrapy.Request(url=url, callback=self.parse, meta={

'proxy': 'http://username:password@proxy_ip:proxy_port'

})

def parse(self, response):

deals = response.css('div.item')

for deal in deals:

title = deal.css('h2::text').get().strip()

price = deal.css('span.price::text').get().strip()

yield {

'title': title,

'price': price

}避免禁令和速率限制

您必須實施模仿人類瀏覽行為的技術,以防止您的抓取工具被檢測和禁止。

模仿人類行為的技術

- 隨機化使用者代理:

- 輪換使用者代理字串,使請求看起來來自不同的瀏覽器。

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Mozilla/5.0 (X11; Ubuntu; Linux x86_64; rv:89.0) Gecko/20100101 Firefox/89.0',

# Add more user agents as needed

]

headers = {

'User-Agent': random.choice(user_agents)

}response = requests.get(url, headers=headers, proxies=proxies)

- 實現延遲和隨機間隔:

- 在請求之間引入延遲以模仿自然流覽模式。

- 使用隨機間隔以避免創建可預測的模式。

import time

deals = soup.find_all('div', class_='item')

for deal in deals:

title = deal.find('h2').text.strip()

price = deal.find('span', class_='price').text.strip()

print(f'Title: {title}, Price: {price}')

# Random delay between requests

time.sleep(random.uniform(1, 3))通過集成代理和類比人類行為,您可以顯著提高 BrickSeek 抓取工具的有效性和使用壽命,確保其平穩運行且長時間不被發現。

第 6 部分:數據管理和存儲

成功從 BrickSeek 抓取數據後,下一個關鍵步驟就是有效地管理和存儲這些數據。本節將指導您了解存儲抓取數據的不同方法,以及如何清理和格式化數據以進行進一步分析。

存儲抓取的數據

存儲數據的選項

根據數據的數量和複雜性,您可以使用多種方式來存儲抓取的數據:

- CSV 檔:

- 簡單易用,適用於較小的數據集。

- 與大多數數據分析工具和軟體相容。

- 是快速分析和可視化的理想選擇。

- 資料庫:

- 更適合更大的數據集和更複雜的查詢。

- 選項包括用於本地存儲的 SQLite,以及用於更強大、可擴展的解決方案的 MySQL 或 PostgreSQL。

- 提供更好的數據完整性和更易於分析的訪問。

- 雲存儲:

- 適用於需要分散式存儲解決方案的大型抓取專案。

- 選項包括 AWS S3、Google Cloud Storage 或 Azure Blob Storage。

- 提供高可用性和可伸縮性。

將數據寫入檔

以下是將抓取的數據寫入 CSV 檔或資料庫的方法:

寫入 CSV 檔案:

import csv

data = [

{'title': 'Deal 1', 'price': '$10'},

{'title': 'Deal 2', 'price': '$15'},

# Add more data as needed

]

with open('deals.csv', mode='w', newline='') as file:

writer = csv.DictWriter(file, fieldnames=['title', 'price'])

writer.writeheader()

for item in data:

writer.writerow(item)寫入 SQLite 資料庫:

import sqlite3

# Connect to the SQLite database (or create it if it doesn't exist)

conn = sqlite3.connect('deals.db')

cursor = conn.cursor()

# Create a table

cursor.execute('''

CREATE TABLE IF NOT EXISTS deals (

id INTEGER PRIMARY KEY,

title TEXT,

price TEXT

)

''')

# Insert data into the table

data = [

('Deal 1', '$10'),

('Deal 2', '$15'),

# Add more data as needed

]

cursor.executemany('INSERT INTO deals (title, price) VALUES (?, ?)', data)

conn.commit()

# Close the connection

conn.close()數據清理和格式化

從網站抓取的原始數據在分析之前通常需要清理和格式化。以下是準備數據的一些基本技術。

基本數據清理技術

刪除重複項目:

- 確保數據集中的每個條目都是唯一的。

import pandas as pd

df = pd.read_csv('deals.csv')

df.drop_duplicates(inplace=True)

df.to_csv('deals_cleaned.csv', index=False)處理缺失值:

- 填寫缺失值或刪除缺失數據的條目。

df = pd.read_csv('deals.csv')

df.dropna(inplace=True) # Remove rows with missing values

df.fillna('N/A', inplace=True) # Fill missing values with 'N/A'

df.to_csv('deals_cleaned.csv', index=False)規範化資料格式:

- 確保數據格式(例如價格格式、日期格式)的一致性。

df['price'] = df['price'].str.replace('$', '').astype(float)

df.to_csv('deals_cleaned.csv', index=False)構建用於分析的數據

將資料組織到表格中:

- 將數據結構化為具有清晰標題和一致數據類型的表。

- 對於關係資料庫,請確保表之間的規範化和關係正確。

使用資料盒:

- DataFrames,就像 Pandas 在 Python 中提供的那些一樣,提供了強大的數據操作和分析工具。

import pandas as pd

df = pd.read_csv('deals_cleaned.csv')

# Perform analysis and manipulations通過有效地管理和存儲抓取的數據,您可以確保它已準備好進行分析和進一步使用。正確的數據處理實踐將節省您的時間和精力,使您的數據分析過程更順暢、更高效。

第 7 部分:分析和使用您的數據

從 BrickSeek 成功抓取並存儲數據後,下一步就是對其進行分析以提取有價值的見解。本部分將指導您瞭解基本和高級數據分析技術,以説明您充分利用收集的數據。

基礎數據分析

用於分析抓取數據的工具和技術

Excel/Google 表格:

- 用法:適用於快速直接的數據分析。

- 技術:

- 對數據進行排序和篩選。

- 使用數據透視表匯總和瀏覽數據。

- 應用公式和函數進行計算和轉換。

Pandas(Python 庫):

- 用法:用於數據操作和分析的強大工具。

- 技術:

- 將數據讀入 DataFrame 以進行結構化分析。

- 執行描述性統計(平均值、中位數、標準差)。

- 對數據進行分組和聚合以查找模式。

import pandas as pd

# Load data into a DataFrame

df = pd.read_csv('deals_cleaned.csv')

# Basic statistics

print(df.describe())

# Group by a specific column and aggregate

grouped = df.groupby('category').mean()

print(grouped)可視化工具(Matplotlib、Seaborn、Tableau):

- 用法:可視化數據以識別趨勢和模式。

- 技術:

- 創建折線圖、條形圖、直方圖和散點圖。

- 使用熱圖進行相關性分析。

import matplotlib.pyplot as plt

import seaborn as sns

# Plot a histogram of prices

sns.histplot(df['price'], bins=20, kde=True)

plt.show()

# Create a bar chart

df['category'].value_counts().plot(kind='bar')

plt.show()查找模式和見解

- 趨勢分析:

- 查找隨時間推移的趨勢,例如價格波動、季節性折扣或庫存水平的變化。

- 示例:確定特定商品分類折扣最高的時期。

- 對比分析:

- 比較不同零售商的價格,找到最優惠的價格。

- 示例:比較不同平臺上產品的平均價格。

- 相關分析:

- 確定不同變數之間的關係。

- 示例:將產品價格與庫存水平相關聯,以瞭解供需動態。

高級分析

使用機器學習獲取預測性見解

預測建模:

- 應用機器學習演算法,根據歷史數據預測未來趨勢。

- 範例:使用回歸模型根據過去的數據預測產品的未來價格。

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

# Prepare data for modeling

X = df[['feature1', 'feature2']] # Replace with relevant features

y = df['price']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Train a regression model

model = LinearRegression()

model.fit(X_train, y_train)

# Make predictions

predictions = model.predict(X_test)聚類:

- 使用聚類演算法根據相似性將產品細分為類別。

- 示例:按價格範圍、類別和受歡迎程度對商品進行分組,以識別不同的集群。

from sklearn.cluster import KMeans

# Prepare data for clustering

features = df[['feature1', 'feature2']] # Replace with relevant features

# Perform K-means clustering

kmeans = KMeans(n_clusters=3, random_state=42)

df['cluster'] = kmeans.fit_predict(features)與其他數據源集成,實現更豐富的分析

- 合併資料集:

- 將 BrickSeek 數據與其他數據源(如銷售數據、客戶評論或競爭對手價格)集成,以進行全面分析。

- 示例:將 BrickSeek 價格數據與銷售績效數據相結合,以分析定價策略對銷售的影響。

- API 和資料庫:

- 使用 API 獲取其他資料或連接到外部資料庫以進行更廣泛的分析。

- 範例:使用電子商務 API 獲取有關產品可用性和評論的實時數據。

- 資料可視化儀錶板:

- 使用Tableau、Power BI或 Plotly Dash 等工具創建互動式儀錶板,以可視化整合數據並監控關鍵指標。

- 示例:構建即時儀錶板以跟蹤價格趨勢、庫存變化和競爭對手定價。

這些基本和高級的數據分析技術可以從您的 BrickSeek 數據中發現有價值的見解,使您能夠做出明智的決策、優化您的策略並在競爭激烈的市場中保持領先地位。

第8部分:故障排除和優化

構建 BrickSeek 刮板可能是有益的,但與任何複雜的任務一樣,它也有其自身的挑戰。本節將幫助您解決常見問題並優化您的抓取工具以獲得最佳性能,確保您從數據提取工作中獲得最大收益。

常見問題和解決方案

處理常見錯誤和問題

- HTTP 錯誤(404、500 等):

- 問題:在抓取過程中可能會遇到 HTTP 錯誤,例如 404(未找到)或 500(內部伺服器錯誤)。

- 解決方案:在抓取工具中實施錯誤處理,以優雅地管理這些錯誤。使用 try-except 塊捕獲異常,並在短暫延遲後重試請求。

import requests

from time import sleep

url = 'http://example.com'

for attempt in range(5):

try:

response = requests.get(url)

response.raise_for_status() # Raises an HTTPError for bad responses

break # Exit loop if request is successful

except requests.exceptions.RequestException as e:

print(f'Error: {e}, retrying...')

sleep(5)- 驗證碼和反機器人措施:

- 問題:網站經常使用驗證碼和其他反機器人機制來防止抓取。

- Solution: Use IP rotation with proxies, and consider integrating CAPTCHA-solving services if necessary. Implement delays and random intervals between requests to mimic human behavior.

import random

from time import sleep

delay = random.uniform(2, 5) # Random delay between 2 and 5 seconds

sleep(delay)- JavaScript 渲染的內容:

- 問題:BrickSeek 上的某些內容可能使用 JavaScript 呈現,而 BeautifulSoup 等靜態抓取工具無法處理。

- 解決方案:使用 Selenium 處理 JavaScript 呈現的內容。

from selenium import webdriver

driver = webdriver.Chrome()

driver.get('http://example.com')

content = driver.page_source- 封鎖的 IP 位址:

- 問題:由於頻繁的請求,您的IP位址可能會被阻止。

- Solution: Use IPBurger proxies to rotate IP addresses and avoid detection.

proxy = "http://proxyserver:port"

proxies = {

"http": proxy,

"https": proxy,

}

response = requests.get(url, proxies=proxies)優化刮板的性能

- 高效的數據提取:

- 通過定位特定的 HTML 元素和屬性來最大程度地減少您請求的數據。

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

price = soup.find('span', {'class': 'price'}).text- 併發請求:

- 使用 aioHTTP 或多線程等異步庫發出併發請求並加快數據提取速度。

import asyncio

import aiohttp

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main(urls):

async with aiohttp.ClientSession() as session:

tasks = [fetch(session, url) for url in urls]

return await asyncio.gather(*tasks)

urls = ['http://example.com/page1', 'http://example.com/page2']

loop = asyncio.get_event_loop()

pages = loop.run_until_complete(main(urls))- 快取和限制:

- 實現緩存以避免對相同數據的冗餘請求,並限制請求以防止伺服器過載。

from cachetools import TTLCache

cache = TTLCache(maxsize=100, ttl=300)

def get_page(url):

if url in cache:

return cache[url]

response = requests.get(url)

cache[url] = response.text

return response.text高級提示和技巧

充分利用 BrickSeek 刮刀的專家提示

- 動態使用者代理:

- 輪換使用者代理以類比不同的瀏覽器並降低被阻止的可能性。

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_11_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36',

# Add more user agents

]

headers = {'User-Agent': random.choice(user_agents)}

response = requests.get(url, headers=headers)- 工作階段持久性:

- 使用會話物件在多個請求中保留 Cookie 和標頭,這有助於維護登錄工作階段並減少檢測。

session = requests.Session()

session.headers.update({'User-Agent': random.choice(user_agents)})

response = session.get(url)持續改進策略

- 定期維護:

- 定期更新您的抓取工具以適應 BrickSeek 網站結構的變化。自動監控可以提醒您必要的更新。

import requests

def monitor_changes(url, current_structure):

response = requests.get(url)

new_structure = response.text

if new_structure != current_structure:

print("Website structure has changed!")

# Update scraper logic here- 回饋循環:

- 實施反饋迴圈,從錯誤和性能指標中學習,不斷改進您的刮板,以提高效率和準確性。

import logging

logging.basicConfig(filename='scraper.log', level=logging.INFO)

def log_error(error):

logging.error(f"Error occurred: {error}")

try:

response = requests.get(url)

response.raise_for_status()

except requests.exceptions.RequestException as e:

log_error(e)遵循這些故障排除和優化技術可確保您的 BrickSeek 抓取工具平穩、高效、有效地運行,為您的各種需求提供有價值的數據。

結論

關鍵點回顧

構建 BrickSeek 刮板可以為價格跟蹤、交易狩獵和庫存管理開闢一個充滿機會的世界。在本指南中,我們介紹了:

- 瞭解 BrickSeek: 從其歷史和發展到其主要功能和用例。

- 網頁擷取的基礎知識: 定義網路抓取、其好處和挑戰,以及道德考慮的重要性。

- 開始: 工具、技術和設置您的網路抓取環境。

- 編譯您的刮刀: 編寫基本抓取工具、處理動態內容和提取相關數據的分步指南。

- 增強您的刮板:我完善代理,避免禁令,並模仿人類行為以確保平穩運行。

- 資料管理: 存儲、清理和格式化抓取的數據以進行分析。

- 分析與使用資料: 用於將基本和高級數據分析與其他數據源集成的工具和技術。

- 故障排除和優化: 處理常見問題、優化性能以及改進刮板的高級技巧。

未來趨勢

隨著技術的發展,網路抓取和數據分析的格局也在不斷發展。以下是一些需要注意的趨勢:

- 網頁抓取中的新興技術: 使用人工智慧和機器學習來創建更複雜、更高效的抓取工具,能夠適應不斷變化的網站結構並提取更豐富的數據。

- 價格追蹤和庫存管理的未來: 將出現更先進的工具和平臺,為動態定價策略、更好的庫存管理和增強的客戶體驗提供即時數據和見解。

使用IPBurger增強您的網路抓取

實施代理對於構建高效可靠的網路爬蟲至關重要。代理可説明您避免IP禁令、分發請求並在抓取數據時保持匿名。IPBurger 提供一系列高品質的代理服務,包括住宅、移動和數據中心代理,專為滿足網路爬蟲的需求而量身定製。

- 安全性和匿名性: IPBurger 的代理可確保您的抓取活動保持匿名和安全,從而保護您的數據不被跟蹤或攔截。

- Avoiding Bans: By rotating IP addresses and mimicking human behavior, IPBurger’s proxies help you avoid detection and bans, ensuring uninterrupted scraping.

- 全球覆寫: 使用IPBurger的全球代理網路訪問來自不同地理位置的數據,增強您執行當地語系化抓取和分析的能力。

現在您已經全面了解了構建 BrickSeek 抓取工具,是時候實施您的知識了。立即開始您的抓取專案,探索自動化價格跟蹤和庫存管理的好處。不要忘記利用IPBurger的代理服務來增強您的抓取工作並確保可靠和安全的數據收集。

我們鼓勵您在評論部分分享您的經驗、挑戰和技巧。您的見解可以幫助社區中的其他人,並有助於不斷改進網路抓取技術。

祝您刮痧愉快!