Aprender a extraer datos de productos de Google Shopping puede ser una buena forma de ahorrar tiempo y dinero a la vez que se recopila información útil sobre productos y servicios.

Con las herramientas y técnicas adecuadas, puede extraer datos de productos de Google Shopping de forma rápida y sencilla y utilizarlos para tomar mejores decisiones sobre su negocio.

En esta guía, exploraremos los aspectos básicos de la extracción de datos de productos de Google Shopping, para que pueda sacar el máximo partido a sus esfuerzos de recopilación de datos.

¿Qué es Google Product Pages?

Google ha creado las "Páginas de productos de Google" para mostrar más información sobre los artículos que se pueden comprar en Google Store. Estas páginas suelen incluir imágenes, vídeos, reseñas de productos y otros detalles sobre el producto. También suelen tener enlaces a otros sitios web donde se puede comprar el producto.

¿Qué es el Web Scraping?

El web scraping es el proceso de extracción de datos de sitios web. Consiste en utilizar programas informáticos para recopilar datos de páginas web, como texto, imágenes u otros datos estructurados. Puede recopilar información de fuentes en línea, como tiendas, motores de búsqueda y plataformas de redes sociales.

¿Por qué extraer datos de productos de Google Shopping?

Una forma rápida y sencilla de recopilar grandes cantidades de datos de comercio electrónico es extraer datos de productos de Google Shopping. Estos datos pueden ayudar a las empresas a tomar decisiones informadas sobre precios, ofertas de productos y estrategias de marketing. Además, utilizar estos datos para realizar un seguimiento de los competidores y analizar las tendencias también puede ser beneficioso para garantizar que las empresas sigan siendo competitivas en su sector.

Scraping de productos de Google: API vs. Python

Google ofrece una API para acceder a sus productos. Esta API proporciona acceso a muchos de los productos y servicios de Google, como Maps, Search y YouTube, entre otros. También es posible scrapear los productos de Google utilizando Python.

La mayoría de la gente prefiere utilizar la API porque es más rápida, fiable y segura. La API también facilita el uso de los productos de Google en las aplicaciones, ya que proporciona las herramientas necesarias para acceder a los datos y modificarlos.

Por otro lado, Python es más flexible y puede utilizarse para acceder y procesar datos de diversas fuentes. También es más fácil de aprender y utilizar, por lo que es una buena opción para quienes se inician en el web scraping. Sin embargo, es importante tener en cuenta que el scraping con Python puede llevar más tiempo y ser menos fiable que utilizar una API. Además, Python suele ser menos seguro que la API porque no está tan bien protegido de las personas malintencionadas.

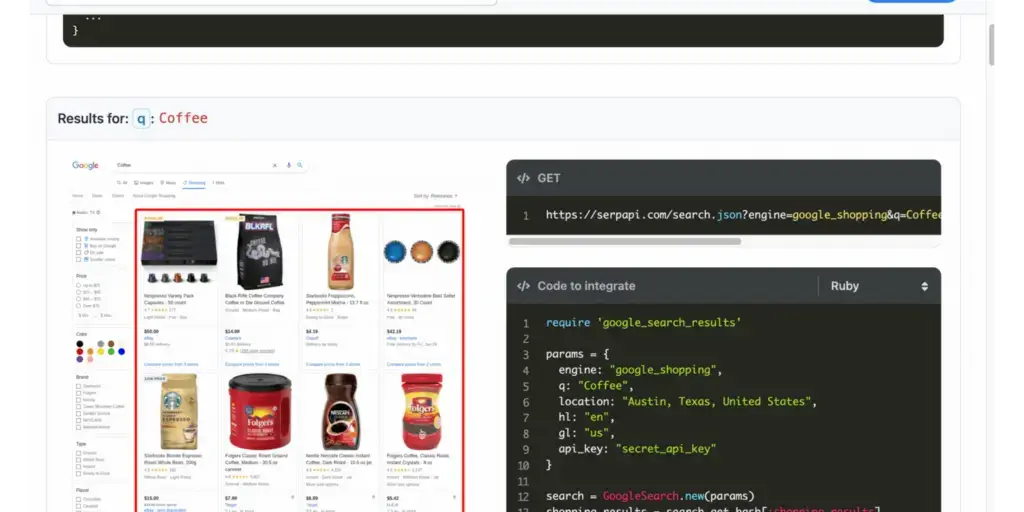

API de resultados de Google Shopping

Google Shopping Results API es una API de Google que permite a los desarrolladores acceder a los resultados de búsqueda de Google Shopping e integrarlos con otras aplicaciones, así como crear nuevas aplicaciones. Con la API, los desarrolladores pueden consultar Google Shopping para obtener información sobre productos y precios. La API proporciona acceso a diversa información sobre los productos, como imágenes, opiniones y precios. Los desarrolladores también pueden utilizar la API para crear búsquedas personalizadas y aplicaciones para buscar productos en varias tiendas online.

Funcionamiento de la API

Con la API de resultados de Google Shopping, los desarrolladores pueden obtener información sobre productos del servicio Google Shopping y mostrar dicha información. La API utiliza una arquitectura de tipo REST y devuelve datos en formato JSON. Los desarrolladores pueden utilizar la API para solicitar información sobre productos como títulos, imágenes, descripciones, precios, etc. La API también permite a los desarrolladores filtrar los resultados de la búsqueda en función de varios parámetros. Además, la API tiene una función de "Anuncios de compras" que permite a los desarrolladores poner anuncios de Google Shopping en sus sitios web.

Ventajas de utilizar la API

1. Rentable: La API de resultados de búsqueda de Google Shopping puede utilizarse a un coste muy inferior al de contratar a un desarrollador para que cree una solución personalizada con el mismo fin.

2. Fácil de usar: La API es fácil de usar, incluso para quienes no están familiarizados con la codificación y el desarrollo web.

3. Resultados completos: La API proporciona resultados completos de varias fuentes, como Google Ads, Google Shopping y otros vendedores online.

4. Fiabilidad: La API es fiable y proporciona resultados precisos.

5. Mayor visibilidad: Cuando las empresas utilizan la API, se hacen más visibles y pueden llegar a más clientes potenciales.

6. Personalizable: La API puede personalizarse para satisfacer necesidades y requisitos específicos.

7. Segura: La API es segura y garantiza la seguridad de los datos de los usuarios.

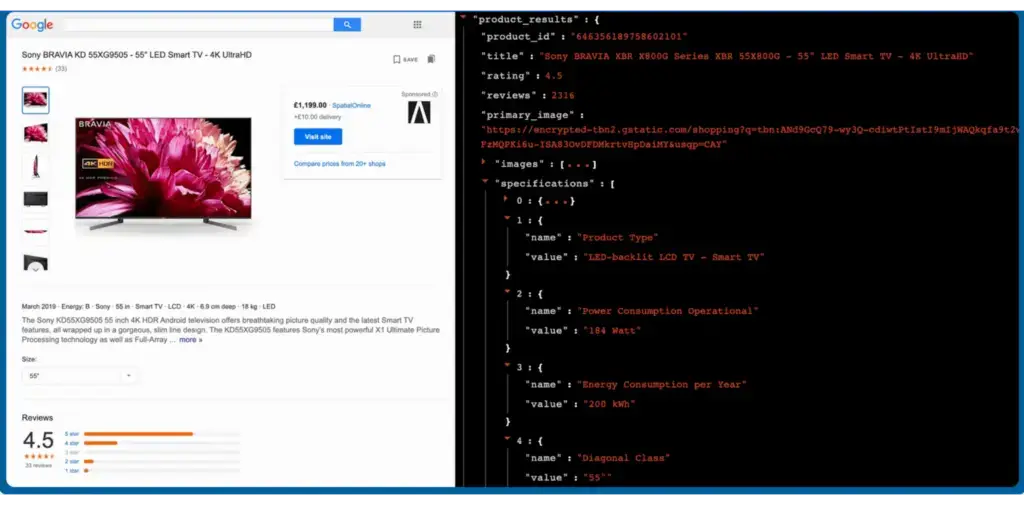

API de resultados de productos de Google

Google Product Results API es una potente API de Google que permite a los desarrolladores acceder a la información más reciente sobre productos de Google Shopping. Permite a los desarrolladores buscar productos, comparar precios y leer opiniones. También proporciona acceso a las imágenes de los productos, a la disponibilidad en la tienda y a las valoraciones de los comerciantes. La API es compatible con varios idiomas y países, lo que la convierte en una excelente opción para aplicaciones de comercio electrónico internacionales. Con la API, los desarrolladores pueden añadir fácilmente Google Shopping a sus sitios web y aplicaciones. Esto proporciona a los clientes la mejor experiencia de compra posible.

Funcionamiento de la API

La API de resultados de productos de Google permite a los desarrolladores solicitar y obtener información sobre productos del Centro de ventas de Google. Con una simple solicitud HTTP, los desarrolladores pueden solicitar y obtener datos del Merchant Center. Los datos devueltos incluyen información como el título, la descripción, el precio, la disponibilidad y las imágenes de los productos. La API también permite rastrear, filtrar y ordenar los resultados para que sean más fáciles de encontrar.

Ventajas de utilizar la API

Más dinero: La API de resultados de productos de Google ayuda a las empresas a ganar más dinero haciendo que los productos y servicios relacionados sean más visibles. Permite a las empresas poner sus productos en primer plano en las páginas en las que se muestran los resultados del motor de búsqueda, lo que aumenta el tráfico y las ventas.

Mayor alcance: La API ayuda a dar a conocer el producto y a hacerlo más visible en el mercado poniendo información relevante, como imágenes y descripciones del producto, directamente en las páginas de resultados de los motores de búsqueda. Esto ayuda a atraer a clientes potenciales que de otro modo no habrían conocido el producto.

3. Mejor experiencia para los usuarios: La API ayuda a los usuarios a tener una mejor experiencia al ofrecerles información relevante en un formato estructurado y fácil de entender. Esto facilita que los clientes encuentren el producto que buscan sin tener que buscar manualmente en diferentes páginas.

4. Es rentable: La API de resultados de productos de Google es una forma rentable para que las empresas promocionen y comercialicen sus productos. Significa que las empresas no tienen que gastar dinero en otras costosas campañas de marketing o publicidad.

5. Fácil de usar: La API permite a las empresas integrar rápida y fácilmente información sobre productos en sus sitios web. Esto puede hacerse con unos conocimientos técnicos y un esfuerzo mínimos.

Preparación para el scrapeado con Python

Python es una potente herramienta para el web scraping que permite a los usuarios obtener datos de sitios web de forma rápida y sencilla. Para prepararte para hacer scraping con Python, necesitas conocer los fundamentos del scraping web y qué bibliotecas de Python necesitarás.

Esta sección discutirá los fundamentos del web scraping y le mostrará cómo prepararse para hacer scraping utilizando Python.

- Instalar el software necesario

- Python

- Pip

- Sopa hermosa

- Solicitudes

- Una biblioteca de raspado web de su elección (por ejemplo, Scrapy, Selenium, etc.)

- Configure un entorno virtual en su directorio de trabajo

- Abra una ventana de terminal.

- Cree un nuevo directorio en su directorio de trabajo:

mkdir scrape_project

- Cambia al nuevo directorio:

cd scrape_project

- Crear un entorno virtual:

python -m venv venv

- Active el entorno virtual:

fuente venv/bin/activate

- Crea una nueva carpeta para el proyecto y crea un nuevo archivo Python dentro de la carpeta

- Importar las bibliotecas necesarias en el archivo Python

#importar bibliotecas necesarias

solicitudes de importación

from bs4 import BeautifulSoup

- Reúna las URL de las páginas web que desea raspar

- Identifique los sitios web que desea raspar

- Reúna las URL de las páginas web que desea raspar

- Crear una lista de todas las URL

- Crear un script en Python

- Cree un script Python en su entorno de desarrollo preferido

#especifique la URL del sitio web que desea raspar

url = 'https://example.com'

#enviar una solicitud al sitio web y almacenar la respuesta

response = requests.get(url)

#parse la respuesta usando BeautifulSoup

soup = BeautifulSoup(response.text, 'html.parser')

#recuperar todos los elementos HTML de la página

elementos = soup.find_all('div')

#iterar a través de los elementos

para elemento en elementos:

#obtener el contenido textual de cada elemento

contenido = elemento.texto

#imprimir el contenido

print(contenido)

- Crear una función para extraer los datos de las URLs

def scrape_data(URL):

página = requests.get(url)

soup = BeautifulSoup(page.content, 'html.parser')

datos = []

for item in soup.find_all('tr'):

fila_datos = []

for td in item.find_all('td'):

data_row.append(td.text.strip())

data.append(fila_datos)

devolver datos

Esta función toma una URL como argumento y devuelve una lista de datos de la página HTML. Utiliza la biblioteca requests para obtener la página y la biblioteca BeautifulSoup para analizar el HTML. Luego recorre los elementos HTML para crear una lista de datos.

- Recorrer la lista de URL y llamar a la función de raspado

urls = ['https://example.com/1', 'https://example.com/2', 'https://example.com/3']

para url en URLs:

scrape(URL)

- Guardar los datos obtenidos en un archivo o base de datos

- Ejecute ChromeDriver en el terminal y comience el scraping

- $ chromedriver

Uso de proxies residenciales para geolocalizar y evitar el bloqueo de IP

Utilizar proxies residenciales para la geolocalización y evitar el bloqueo de IP es una excelente forma de garantizar que sus actividades de web scraping pasen desapercibidas y no provoquen el bloqueo de su IP. Los proxies residenciales son las direcciones IP de usuarios domésticos reales, no IPs de un centro de datos. Esto hace que sean más difíciles de encontrar y más útiles para las actividades de web scraping que deben realizarse de forma anónima.

Al utilizar proxies residenciales, es importante utilizar un proveedor de proxies que ofrezca un gran conjunto de direcciones IP y tenga la capacidad de rotarlas oportunamente. Esto garantiza que sus actividades de web scraping pasen desapercibidas y que su dirección IP no sea bloqueada.

If you’re looking for a safe and reliable way to scrape product data from Google Shopping, try IPBurger’s residential proxies today and see how well they work.